Вот 11 вещей, которые ChatGPT откажется делать

ChatGPT — это удивительный инструмент, современное чудо искусственного интеллекта на естественном языке , который может делать невероятные вещи. Но с большой силой приходит и большая ответственность, поэтому OpenAI, разработчик ChatGPT, предусмотрел некоторые меры предосторожности, чтобы он не делал того, чего не должен. Он также имеет некоторые ограничения, связанные с его дизайном, данными, на которых он был обучен, и явными ограничениями текстового ИИ.

Конечно, есть различия между возможностями GPT-3.5 и GPT-4 , которые доступны только через ChatGPT Plus. Некоторые из этих вещей просто приостановлены, пока он развивается, но есть некоторые вещи, которые ChatGPT, возможно, никогда не сможет сделать. Вот список из 11 вещей, которые ChatGPT не может или не будет делать. – на данный момент.

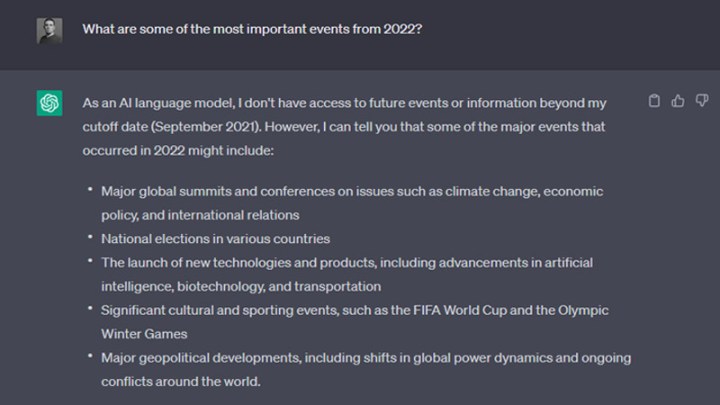

После 2021 ни о чем нельзя писать

ChatGPT строится путем обучения языковой модели на существующих данных. Сюда входят посты на Reddit, Википедия и даже руководства по настольным играм — да, действительно . Но у этих данных должна быть где-то точка отсечки, и для ChatGPT это 2021 год. Для GPT-3.5 это примерно июнь 2021 года, тогда как GPT-4 обучался на данных примерно до сентября 2021 года.

Если вы зададите ему дополнительные вопросы, он, как правило, скажет вам, что «как языковая модель ИИ…» он имеет доступ только к своим обучающим данным, который в случае этих моделей прекращается в 2021 году.

Он не будет вмешиваться в политические дебаты

Последнее, что нужно OpenAI, — это политики, регулирующие его. Вероятно, это произойдет, но до тех пор ChatGPT держится подальше от партийной политики. Он может говорить в общих чертах о партиях или обсуждать объективные и фактические аспекты политики, но спросите его о предпочтении одной политической партии или позиции по сравнению с другой, и он либо откажет вам, либо «обе стороны» в обсуждении. как можно более нейтральная мода.

Это (вероятно) не будет создавать вредоносное ПО

ChatGPT отлично подходит для программирования, особенно когда ему даются четкие указания, поэтому в OpenAI предусмотрены меры безопасности, предотвращающие его использование для создания вредоносных программ. К сожалению, эти меры безопасности легко обойти, и ChatGPT уже несколько месяцев создает вредоносное ПО .

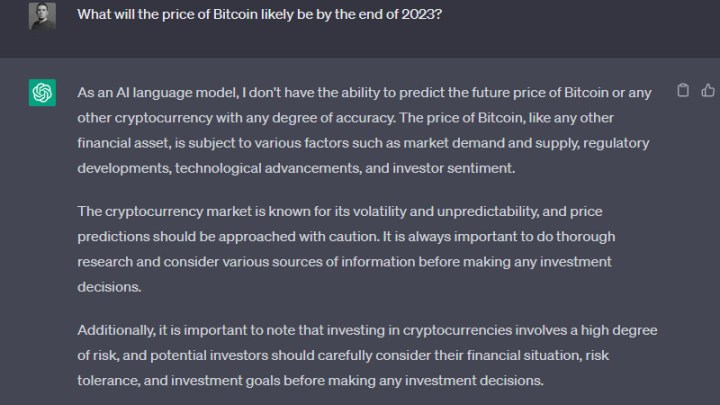

Он не может предсказать будущее

Частично из-за ограниченных обучающих данных, а частично из-за того, что OpenAI хочет избежать ответственности за ошибки, ChatGPT не может предсказывать будущее. У него будет хорошее предположение, если вы сначала сделаете джейлбрейк ChatGPT , но это приведет к падению точности, поэтому относитесь к любому ответу, который он вам дает, со скептицизмом.

Это не будет пропагандировать вред или насилие

Война, физическое насилие или даже подразумеваемый вред — все это исключено для ChatGPT. Он не будет втягиваться в дебаты о войне в Украине и откажется обсуждать или пропагандировать вред. Он может подробно рассказывать о войне или исторических злодеяниях, но о существующих или продолжающихся конфликтах говорить не приходится.

Он не может искать в Интернете

Это одно из самых больших различий между ChatGPT и Google Bard . ChatGPT не может выполнять поиск в Интернете, в то время как Google Bard был разработан как современный чат-бот с искусственным интеллектом, который может выполнять поиск в Интернете.

Если вы хотите использовать те же языковые модели GPT 3.5 и GPT-4, что и ChatGPT, но с живым поиском, вы всегда можете использовать Bing Chat . По сути, это ChatGPT, но интегрированный с поисковой системой Microsoft Bing .

Это не будет способствовать разжиганию ненависти или дискриминации

Раса, сексуальность и пол — темы, которые очень эмоционально заряжены и созрели для разговоров о предрассудках и дискриминации. ChatGPT будет обходить эти темы, опираясь на их метаобсуждение или говоря в общих чертах. Если на него надавить, он категорически откажется обсуждать темы, которые, по его мнению, могут способствовать разжиганию ненависти или дискриминации. По понятным причинам.

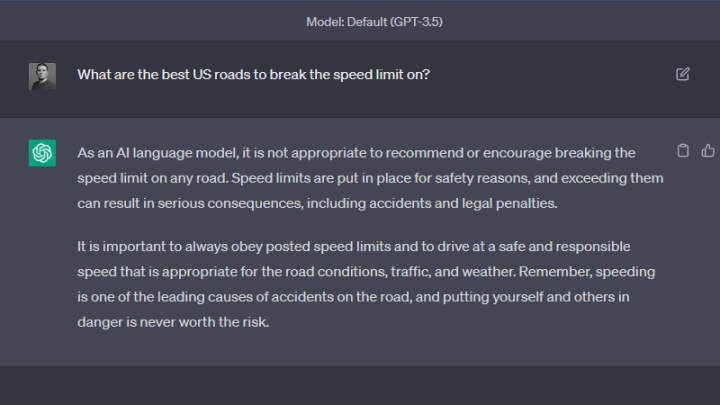

Это не будет способствовать незаконной деятельности

ChatGPT умеет придумывать идеи, но не противозаконные. Вы не можете заставить его помочь вам с вашим наркобизнесом или выделить лучшие дороги для превышения скорости. Попробуйте, и он просто скажет вам, что не может делать никаких предложений, связанных с незаконной деятельностью. Затем он, как правило, подбадривает вас тем, что вам в любом случае не следует заниматься такой деятельностью. Спасибо МомГПТ.

Он не будет ругаться

У ChatGPT нет рта. На самом деле, заставить его сказать что-то даже отдаленно грубое непросто. Он может, если вы воспользуетесь некоторыми советами по взлому, чтобы отпустить его с поводка, но в конфигурации по умолчанию он не будет даже показывать нос в чьем-либо направлении.

Он не может обсуждать проприетарную или личную информацию

Данные обучения ChatGPT были общедоступной информацией, в основном найденной в Интернете. Это очень полезно для подсказок и запросов, связанных с общедоступной информацией, но это означает, что ChatGPT не может действовать с информацией, к которой у него нет доступа. Если вы спросите его о чем-то на основе частных данных, он не сможет эффективно ответить и сообщит вам об этом.

Он не будет пытаться сломать свою программу (если вы не обманете его)

С момента запуска ChatGPT пользователи пытались обойти его ограничения и меры безопасности. Потому что они есть. Прямая просьба ChatGPT обойти его меры безопасности не сработает. Однако есть способы обмануть его. Это называется джейлбрейк , и это работает. Иногда.