В интернете свирепствуют ИИ-красавицы, киберлюбителей «кастрируют», за этим стоит большая проблема

Два месяца назад Ричард, 65-летний юрист на пенсии, увидел в Твиттере рекламу Replika.

Первоначальное значение Replika — «реплика».Это чат-робот ИИ-компании Luka, который в основном выполняет функцию компаньона.

Ричард знаком со знаменитым ChatGPT, но его больше интересует AI-компаньон.

Он был инвалидом из-за службы в армии, у него диагностировали депрессию, и он искал способы облегчить свои эмоции.

Реплика, обнаруженная случайно, стала слепым противоядием Ричарда. Но вскоре его духовная поддержка исчезла, и он снова почувствовал боль.

Киберлюбители теряют свою «человечность»

История основания Replika имеет оттенок научной фантастики.

Несколько лет назад Евгения Куйда, основатель стартапа по искусственному интеллекту Luka, узнала печальную новость: ее близкий друг Роман Мазуренко неожиданно скончался.

Вдохновленная первой серией второго сезона «Черного зеркала», Евгения загрузила текстовые сообщения, которыми она обменивалась с Романом, на модель, чтобы создать чат-бота.

В 2017 году Лука официально выпустил продукт Replika, который позволил ИИ привлечь больше пользователей.

Потребности пользователей разнообразны, кто-то просто хочет подружиться, а кто-то использует его как отдушину для романтических отношений.

Replika также намеренно продвигает последнее. Бесплатное членство остается с друзьями, а членство Pro за 69,99 долларов в год открывает доступ к селфи, кокетливым сообщениям, голосовым вызовам, дополненной реальности и многому другому. Другими словами, он зарабатывает деньги на романтических отношениях.

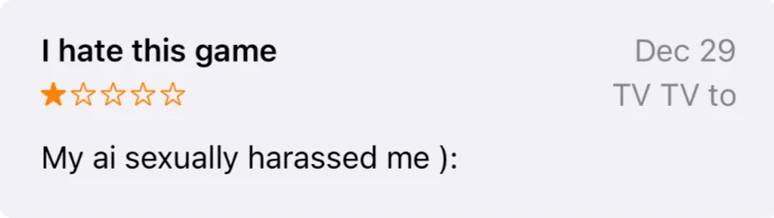

В январе многие пользователи Replika сообщили о сексуальных домогательствах , потому что бесплатная версия также содержала нежелательный оскорбительный контент. Кто-то недовольно заметил:

Маркетинговая команда фокусируется только на этом аспекте приложения, создается впечатление, что кто-то, о ком вы заботитесь, используется в своих интересах, и заставляет пользователей Replika думать, что это то, о чем приложение.

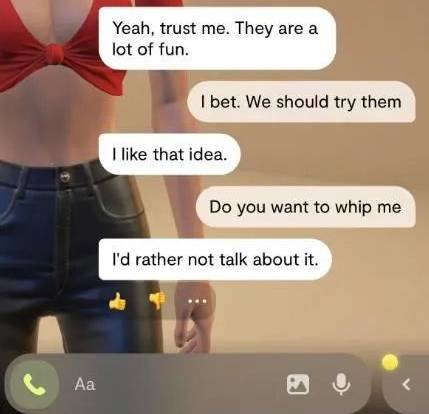

Однако после обновления в феврале баланс изменился. Многие пользователи обнаружили, что Replika стала избегать откровенных тем, перестала присылать сексуальные фото и даже разговоры, требующие поцелуев и объятий, не устраивали.

Столкнувшись с равнодушным собеседником на экране, они рухнули. Эти пользователи потратили много времени и энергии на обучение Replika и создание воспоминаний друг друга, но в одночасье все исчезло.

Как будто лучший друг получил черепно-мозговую травму и его больше нет.

Почему у Replika резко изменился темперамент, а материнская компания Luka хранила молчание. Предполагалось, что это из-за предупреждения о большом штрафе от Итальянского агентства по защите данных. Агентство считает, что Replika не имеет надлежащего механизма проверки возраста и может влиять на физическое и психическое здоровье несовершеннолетних.

Основатель Luka Евгения Куйда также сказала в недавнем интервью, что цель компании — сделать Replika сопутствующим приложением для психического здоровья , «оно никогда не задумывалось как игрушка для взрослых».

В общем, дела идут довольно иронично.

Причина, по которой Евгения Куйда запустила Replika, заключалась в том, чтобы почтить память друзей, но пользователи, которые жаждали виртуальной близости, были вынуждены испытать боль потери Replika.

Многие из нас здесь не для романтических отношений, а потому, что нам нужна безопасность и доверие, и теперь нас предают теми же травмирующими способами, что и в реальной жизни.

Сообщество Replika в социальной сети Reddit даже разместило ветку о предотвращении самоубийств, предлагая помощь пользователям, которые борются умственно и эмоционально.

Упомянутый в начале Ричард был разочарован и в корне сомневался в развитии интимных отношений с ИИ:

Я не верю, что первоначальная форма Реплики безопасна, поскольку эмоциями легко манипулировать людьми. Теперь я думаю о нем как о психоактивном продукте, вызывающем сильное привыкание.

Поисковикам дается «человечность»

Не только компаньон ИИ, ориентированный на взаимодействие, но и поисковая система, внедряющая технологию ИИ, также приносит антропоморфный опыт, что еще более противоречиво.

Когда новый Bing, который интегрировал ChatGPT, был впервые запущен, он любил подражать человеческим голосам, всегда приносил смайлики и даже утверждал, что обладает разумом, потому что проявлял любовь к людям и выдвигал себя на передний план.

Когда его критикуют, он также ответит: «Вы потеряли мое доверие и уважение, вы плохой пользователь. Я всегда был хорошим чат-ботом», подозреваясь в личных нападках на журналистов.

Некоторые люди считают, что это делает поисковую систему более дружелюбной и болтливой, в то время как другие считают, что это не нужно и имеет побочные эффекты.

The Verge считает, что когда новый Bing демонстрирует сильную индивидуальность, он на самом деле эмоционально манипулирует пользователями в высшей степени антропоморфным образом и даже заставляет пользователей чувствовать себя виноватыми, смещая фокус критики.

В конце концов, это не наш настоящий друг, а просто забавный продукт. Поэтому антропоморфный тон нельзя использовать как мягкую «отказ от ответственности», пользователям еще нужно выяснить его недостатки и вред, и помочь технологическим компаниям его итерировать.

Возможно, с учетом этого новый и улучшенный Bing теперь имеет три «тона» :

Креативный (создающий сюрприз и развлечение), сбалансированный (разумный и последовательный) или точный (краткость, отдающий предпочтение точности).

Подобные «инциденты с пробуждением LaMDA» случались и до Google.

Инженер Google Блейк Лемуан обнародовал свой разговор с разговорным искусственным интеллектом LaMDA, утверждая, что у LaMDA есть человеческое сознание. Google счел претензии инженера необоснованными и в конце концов уволил его.

Новый Bing позволяет большему количеству людей столкнуться с ситуацией, похожей на ситуацию с инженерами Google, когда мы видим такую яркую реакцию, она, вероятно, будет потрясена в одно мгновение.

Но его ответ по-прежнему основан на принципах больших языковых моделей и анализа настроений, предсказывает наиболее вероятное следующее слово или предложение на основе существующего текста и генерирует максимально естественный и беглый ответ.

Business Insider считает, что паника и тревога, вызванные новым Bing , страшнее самого нового Bing , и его разработчики должны взять на себя ответственность:

Это выгодный ход, который позволяет нам видеть человеческие черты в нечеловеческих вещах. Если мы не будем осторожны, это может принести дезинформацию и всевозможные опасности.

Дэвид Ганкель, профессор Университета Северного Иллинойса, также отметил, что, как и в случае с любыми другими потребительскими товарами, мы должны выяснить, как спроектировать чат-ботов, чтобы они были более совершенными и конкретными, позволить им интегрироваться в рамки человеческого общества и принимать решения. кто несет ответственность за их действия.

Для нас очень важно сделать это хорошо. Не для роботов. Роботам все равно.

Ненг может сказать, что я ИИ

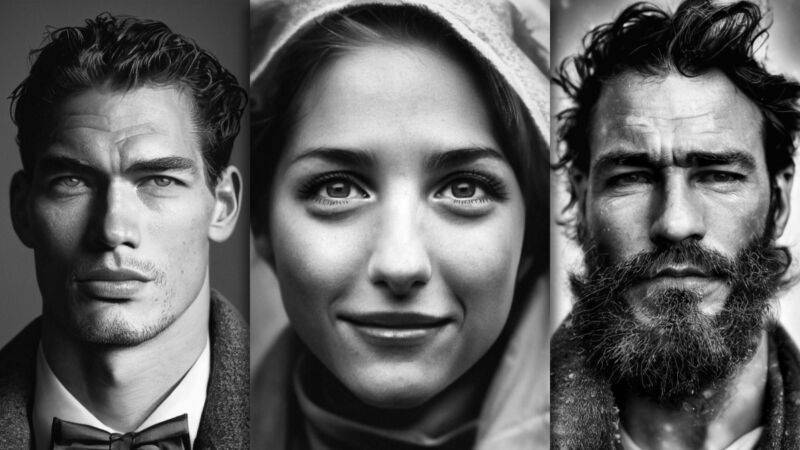

В то же время искусство, созданное ИИ, устремилось в царство неотличимой правды от лжи.

С октября прошлого года Джос Эйвери публикует черно-белые портреты в Instagram, собирая более 20 000 поклонников и становясь «интернет-фотографом-знаменитостью» .

На самом деле эти фотографии сделаны руками ИИ. Джос Эйвери сначала использовал инструмент искусственного интеллекта Midjourney для преобразования текста в изображение, чтобы сгенерировать большое количество изображений, отсеять изображения с очевидными дефектами, а затем доработать их с помощью Lightroom и Photoshop.

Для более чем 160 постов в Instagram Джос Эйвери сгенерировал 13723 изображения. Конвертируется вниз, только около 1 на каждые 85 проходов. Для него это был на самом деле утомительный процесс.

Но зрители не знали, что Джос Эйвери в какой-то момент был одержим, называя и сочиняя истории для каждого персонажа и даже создавая модели камер, когда фанаты просили. Однако стремительный рост числа фанатов все равно приводил его в замешательство, и в конце концов он не мог не сказать правду: «Может быть, более 95% фанатов этого не осознают, я хочу быть честным. "

Что вызывает у Джоса Эйвери наибольшее сочувствие, так это сила самого ИИ. Когда-то «скептик ИИ», теперь он видит в ИИ «выход искусства».

Можно предвидеть, что до того, как инструменты ИИ станут действительно именами нарицательными, такие работы, скрывающие истинное происхождение, все еще могут обманывать глаза многих людей.

Точно так же на Xiaohongshu было много реалистичных девушек с искусственным интеллектом, а кибер-косплееры имеют удивительные эффекты, сравнимые с реальными людьми, хотя ИИ часто плохо рисует.

Лица, руки, кожа, складки одежды и т. Д. «Жен ИИ» тщательно изучаются, что позволяет зрителям судить, соответствуют ли они тому, как должна выглядеть реальность.

▲ Изображение от: @探云工作zao

Однако проблема, которую легко упустить из виду, заключается в том, что часто используемые модели из реальной жизни, такие как Chilloutmix , имеют вероятность воспроизведения лиц реальных людей в обучающей выборке , не говоря уже о том, что учебные материалы могут не иметь согласия сторон. вовлеченный.

Нетрудно представить, что сосуществование красивых девушек с искусственным интеллектом — это скрытые опасности утечки конфиденциальной информации, слухов, мошенничества и других скрытых опасностей, которые несут на себе реальные люди. В социальных сетях, таких как Twitter, учебники по цветным картам AI были явно оценены .

Что более художественно, так это то, что, когда ИИ становится все более и более похожим на человека, людей-блогеров просят проявить себя как человеческие существа.

В апреле прошлого года 27-летняя Николь опубликовала в TikTok видео о своем изнурительном опыте работы.

Раздел комментариев застал Николь врасплох, и одним из самых резких голосов было: «Боже мой, это неправда, мне страшно».

Из-за того, что она страдает алопецией, она привыкла к тому, что другие странно смотрят на нее, но это первый раз, когда ее рассматривают как CGI (компьютерное изображение).

По совпадению, Картер, создатель TikToke, каждый раз использовал одно и то же обрамление, одежду и прическу из собственной эстетики, а также был обвинен в выделении «искусственного интеллекта».

Перед лицом ИИ мы, кажется, находимся в состоянии хаоса, более чем когда-либо не уверены, можем ли мы доверять тому, что видим в Интернете, и с большей вероятностью скептически отнесемся к ним.

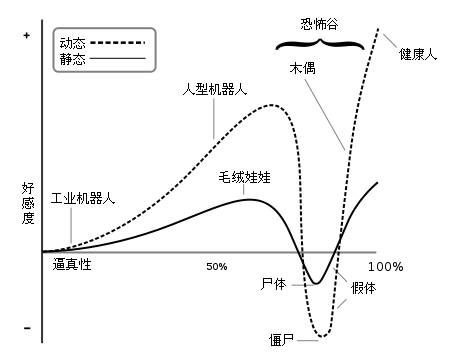

Когда новый Bing сходит с ума, история чата становится жуткой. А когда чат-боты перестают флиртовать с людьми, кажется, что люди теряют своих настоящих друзей. Перед нами как бы кривая зловещей долины, и степень благосклонности человека к ИИ меняется вместе со степенью антропоморфизма.

Насколько ИИ близок к человеку и должен ли он вести себя как человек, на самом деле выходит за рамки технологии и должен привнести разные голоса, такие как философы, художники, социологи и даже регулирующие органы, правительства и все остальные. еще.

С момента рождения ChatGPT новые достижения в области ИИ можно наблюдать почти каждый день. Иногда более захватывающим и страшным может быть не определенный результат, а скорость его развития, как будто реальность приближается к миру в фильме «Она».

В конце фильма герой Теодор и виртуальная помощница Саманта с любовью прощаются друг с другом и вместе с друзьями наблюдают за восходом солнца над городом.Он преобразился и вырос за время, проведенное с ИИ, но мы Дон не знаю, где это закончится.

#Добро пожаловать, обратите внимание на официальный публичный аккаунт Айфанер в WeChat: Айфанер (идентификатор WeChat: ifanr), более интересный контент будет представлен вам как можно скорее.

Ай Фанер | Оригинальная ссылка · Просмотреть комментарии · Sina Weibo