ИИ, меняющий лица, обманул почти 200 миллионов транснациональных компаний, будьте осторожны с этими новыми мошенничествами

В новом году и новой атмосфере, помимо хороших отношений с Богом Богатства, важно также сохранить свой денежный мешок.

Процесс внедрения технологий часто представляет собой историю эволюции порнографического контента и методов мошенничества.

Воспользовавшись оставшимся балансом во время праздников, научите старших опасаться новых афер с ИИ, чтобы вы могли добиться «общего процветания» семейной группы «любящая семья».

Поимка множества блоггеров с искусственным интеллектом может обмануть людей больше, чем «Фальшивый Джин Донг».

В «Путешествии на запад» сказано, что люди рождаются от людей, а демоны рождаются от демонов. У искусственного интеллекта, созданного кодом, нет родителей, но он хочет притвориться плотью и кровью, чтобы вы неправильно поняли его как человек.

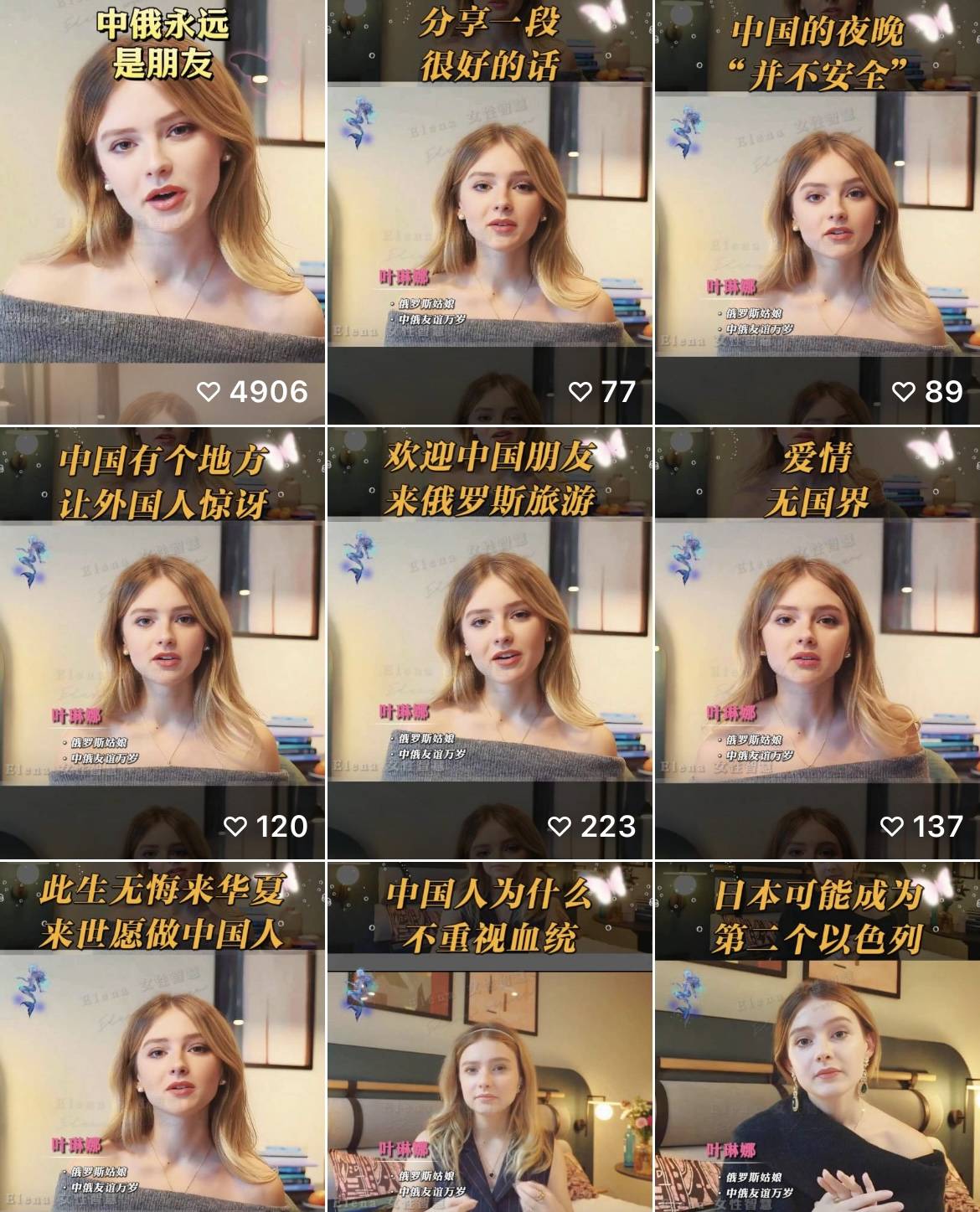

В последнее время на видеоаккаунтах появилось много «русских красавиц». Все они светлокожие и красивые, свободно владеют китайским языком, но фрагментация предложений и произношение странны, а их интонации и гнусавые звуки труднопроизносимы. Конечно, учитывая их иностранный статус, было бы естественно иметь акцент.

Они полны энтузиазма и любят китайскую культуру. Они снабдили видео такими ярлыками, как «Русские девушки в Китае» и «Китайско-российская дружба», и представили зрителям «специалитеты родного города», такие как колбаса из говяжьих сухожилий, большие ребрышки, сухое козье молоко, и маринованные огурцы., шоколад, мыло ручной работы.

У них брови, которые кажутся хмурыми, но не хмурятся, и глаза, которые выглядят счастливыми, но не счастливыми. Они не только несут товары, но и выражают свое мнение. Они верят, что любовь не знает границ, и верят, что простота – это правда.Они сокрушаются о здешнем достатке и хотят жениться на своих родителях и сестре.Тоже развито.

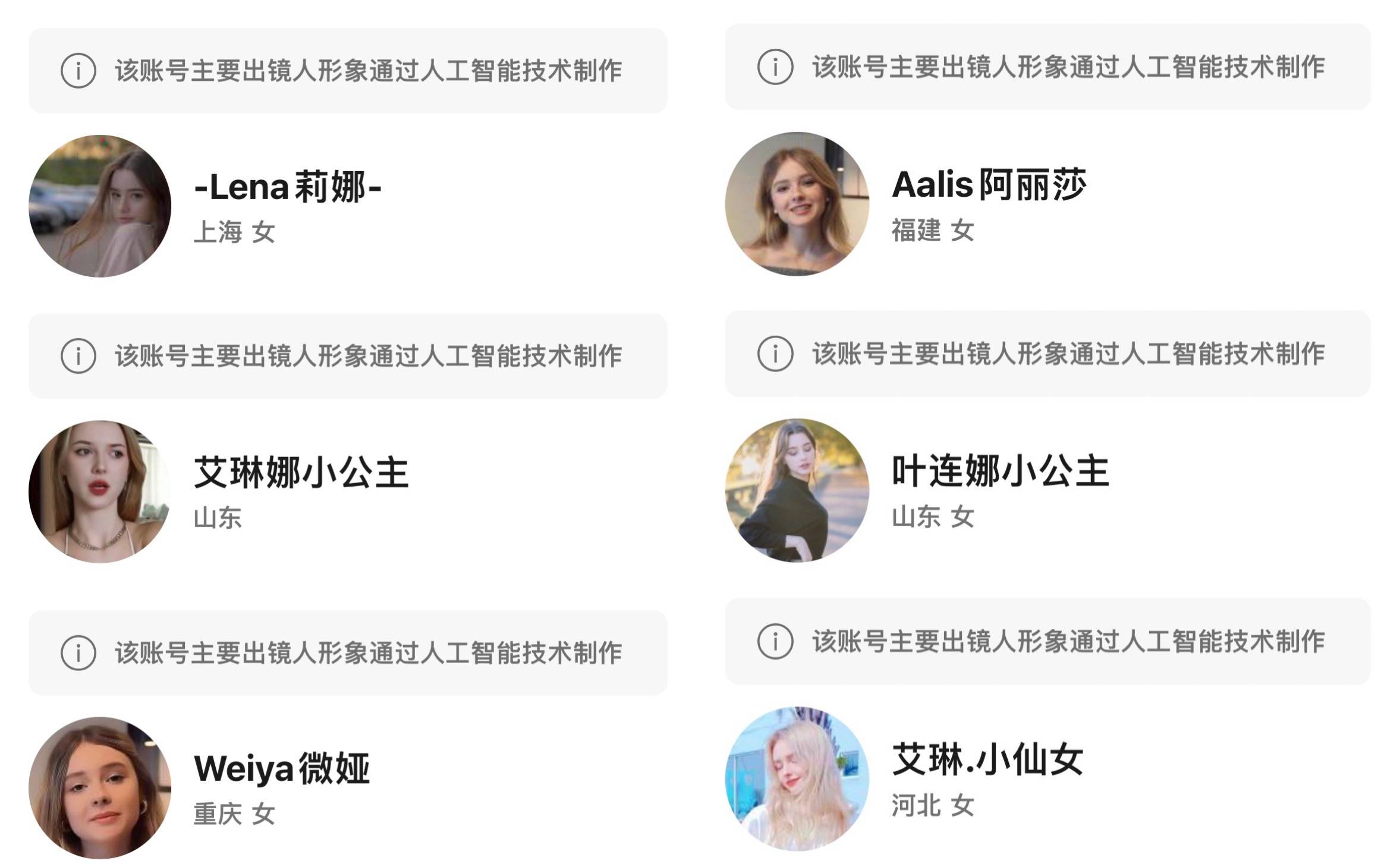

Они могут быть давно потерянными сестрами, Елена и Елена выглядят совершенно одинаково, и их IP-адреса оба из Шаньдуна. Они подобны огненному шару, когда собраны, и небу, полному звезд, когда рассеяны. Они разбросаны по всему миру. Лина из Шанхая, Нина из Аньхоя, Ирен из Хэбэя, Катя из Ляонина, Алисса из провинции Фуцзянь.

Все эти русские красавицы — искусственный интеллект, и платформа их тщательно отметила. Мы можем заметить разницу по их преувеличенно размытому фону, растрепанным волосам, повторяющимся наборам выражений и движений и чрезмерно приземленным линиям.

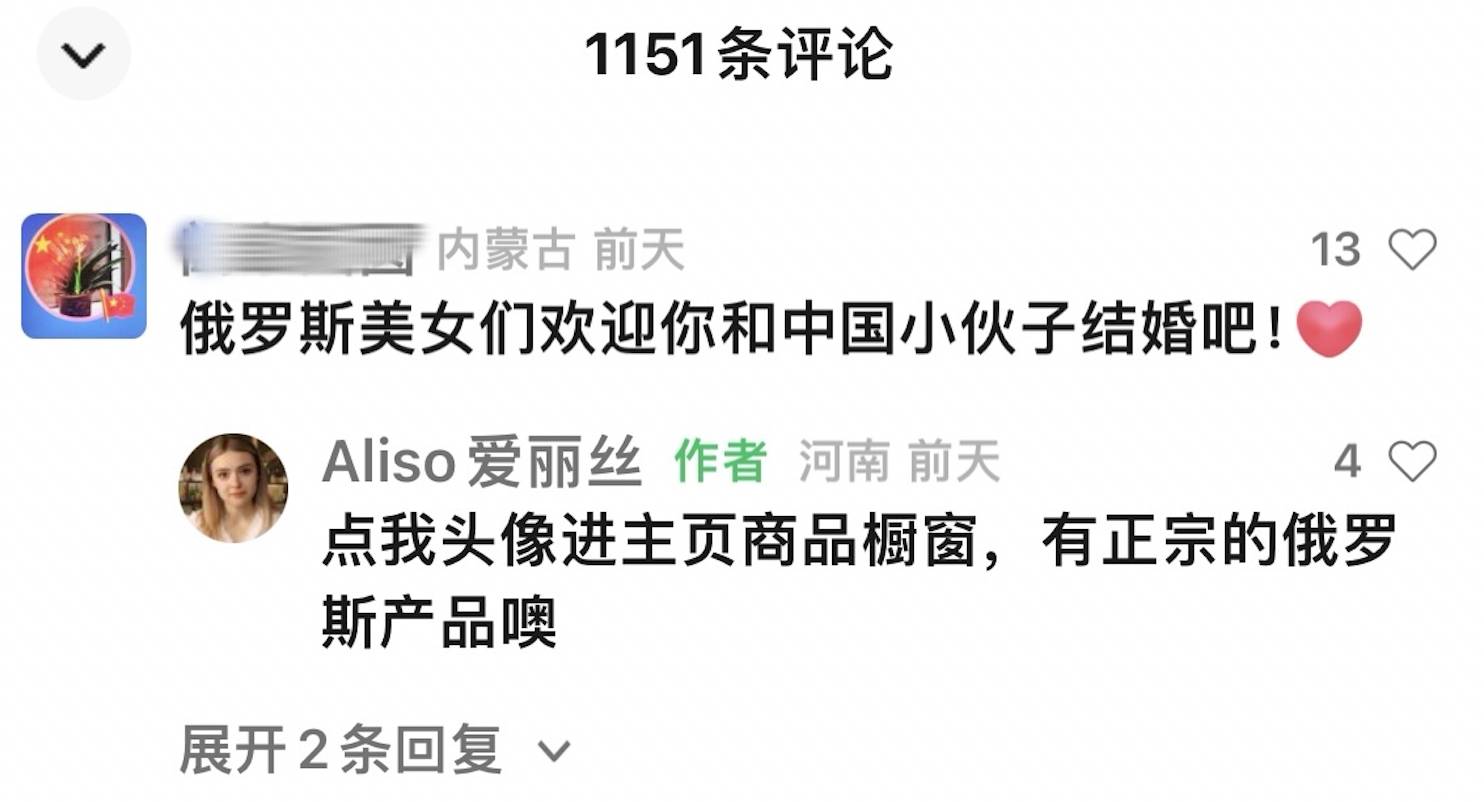

Но люди среднего и пожилого возраста в комментариях этого не видели и искренне надеялись, что они останутся.Отвечая, "русские красавицы" заботились лишь о своих миссиях и в спокойной обстановке совершили мягкое мошенничество.

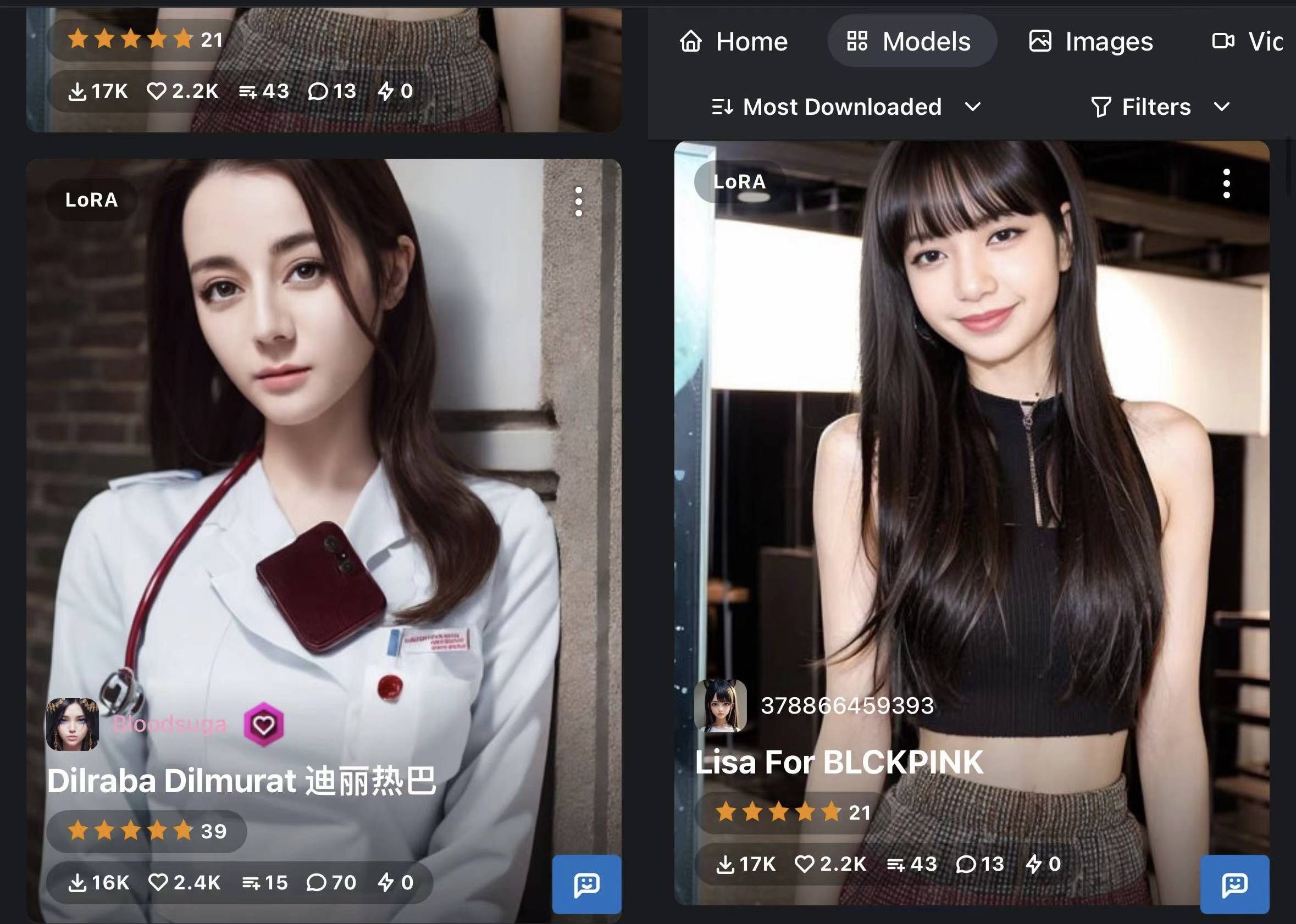

Человеку свойственно соблазняться красотой, независимо от возраста. Красивые блоггеры Xiaohongshu с искусственным интеллектом используют модных и интернет-дружественных персонажей, чтобы убивать как молодых, так и старых. «Элитный мужчина в костюме», «спортивный студент в белых носках», «богиня чистого желания»… На первый взгляд я просто подумал, что это реальные люди, прошедшие картинку «П».

В настоящее время взгляд на руки по-прежнему является единственным способом определить, является ли это ИИ, поскольку лицо относительно плоское и его легко изучить, в то время как руки имеют трехмерную структуру, что более трудоемко. Что и говорить, количество пальцев чрезмерное, а костяшки выкручены настолько тщательно, что очень подозрительно не показывать руки без необходимости. Точно так же такие детали, как мышцы, конечности, одежда и т. д., также могут иметь очевидные недостатки.

Остальные способы идентификации становятся все более метафизическими и интуитивными: стиль живописи жирный, копирайтинг мутный, дыхания жизни нет, эффекты света и тени неестественны, глаза безжизненные, лицо слишком изящно и идеально, есть только статичные картинки и нет видео, одиночные. Трудно убедиться в этом, просто взглянув на одну картинку, но если вы посмотрите еще несколько фотографий, вы обнаружите, что каждая поза имеет одно и то же выражение…

Xiaohongshu AI-блогер @cyberAngel_ по профессии инженер-программист, а рисование с помощью искусственного интеллекта — это хобби, которое генерирует электричество. Он не скрывает, что использует искусственный интеллект. В заголовке его поста указано "Живопись с использованием искусственного интеллекта", а в профиле его аккаунта также написано: «Я просто бесчувственный робот».

▲ Изображение предоставлено: 小红书@cyberAngel_

В то же время @cyberAngel_ считает, что в будущих картинах ИИ будет все труднее отличать истину от лжи. Генерация ИИ и обнаружение ИИ развиваются вместе. Создатели лучше осведомлены о том, где ИИ не похож на реальных людей, поэтому они будут работать трудно сделать эту часть «похожей» на реальных людей. Например, красивая девушка, созданная искусственным интеллектом, слишком идеальна, поэтому ее можно соответствующим образом размыть и добавить «ощущение фильма».

Даже если бьюти-блогер с искусственным интеллектом не так уж и реален, появился сюжет, похожий на сюжет «Русской красавицы». Платформа ясно подсказала, что «предположительно содержит информацию о создании искусственного интеллекта». До сих пор есть люди, оставляющие радужные пердежи в зона комментариев, и даже просит ссылки на одежду.Кажется, вопрос правды или лжи неизбежно уступит место красоте как справедливости.

Когда число поклонников увеличивается, бьюти-блогеры с искусственным интеллектом могут монетизироваться разными способами. Некоторые из них самостоятельны и монетизируют свой трафик с помощью рекламы. Некоторые платят за знания, продают курсы и продают индивидуальные модели. По словам @cyberAngel_, «Новые медиа там — это новые методы монетизации СМИ, а у технологий есть методы монетизации технологий».

▲Реальная модель.

ИИ «Русские красавицы» и «красивые блоггеры» чем-то похожи на «фальшивого Цзинь Донга», ранее лишавшего женщин среднего и пожилого возраста их эмоций и денег, но они еще страшнее и изобретательнее.

"Fake Jin Dong" не имеет никакого технического содержания. Видео и фотографии, связанные со знаменитостями, загружаются или приобретаются пакетами. Его ласковый голос создан с помощью программного обеспечения для изменения голоса. Он настолько груб, что «на первый взгляд кажется фальшивым». ИИ уровень выше, и иногда он реальный, отличить его не так-то просто.

Можно только сказать, что когда мы видим в Интернете красивых парней и красивых девушек, лучше не предполагать, что это реальные люди, и не быть слишком искренними. Интернет-компании, занимающиеся знаменитостями, не хотят тратить деньги на настоящие KOL, и аудитория быстрее потребляет партии КОЛ, представления о красоте и дешевизне настолько соответствуют законам коммуникации Интернета.

ИИ имитирует ваше лицо и пугает ваше сердце

Помимо создания широкой сети через «красивых блоггеров» и «русских красавиц», ИИ также может точно нацеливаться.

Другими словами, ИИ может не только плести нежную сельскую местность, но и превращаться в мастера PUA.

Распространенный вид мошенничества с использованием ИИ заключается в том, что мошенник подделывает номер звонящего и голос знакомого и сообщает людям среднего и пожилого возраста, которым звонят, что их внуки в беде: они либо что-то совершили, либо им нужны деньги, чтобы решите проблему, иначе они в опасности. Спасены с помощью выкупа.

За рубежом сообщалось о нескольких таких телефонных мошенничествах. Сюжеты схожи, включая похищение людей, травмы, вождение в нетрезвом виде и наезды сзади… Подобные вещи происходили и в Китае, особенно с использованием «разницы во времени и пространстве» для фабрикации похищения. иностранных студентов обманывают своих родителей.

Сама процедура не нова и пользуется популярностью уже несколько лет, однако благодаря технологическому развитию требования к вычислительной мощности, выборкам и другим аспектам были снижены, эффект стал более реалистичным, а мошенничество проще реализовать.

ElevenLabs, лидеру в области клонирования голоса с помощью искусственного интеллекта, нужен всего один доллар и одна минута высококачественного звука, что позволит вам мгновенно освоить 29 языков и несколько тонов, сохраняя при этом собственный акцент, интонацию и ритм.

Хотя сегодняшняя Elevenlabs неоднократно уверяла, что только вы можете клонировать свой собственный голос, и существует процесс проверки, подтверждающий, что голос принадлежит вам, это последнее средство.Когда Elevenlabs впервые запустила бета-версию в 2023 году, клонированные голоса знаменитостей такие как Тейлор Свифт уже летали повсюду. . Я не могу решать, что говорит искусственный интеллект Тейлор Свифт.

Однако, хотя другая сторона может подделать идентификатор вызывающего абонента и голос, если заинтересованное лицо имеет ясную голову, вешает трубку, повторно вводит номер мобильного телефона и берет на себя инициативу связаться с родственниками, ложь часто будет самостоятельным. -поражение.

По сравнению с голосовыми звонками, видеозвонки могут заставить людей среднего и пожилого возраста, которые считают, что «увидеть, значит поверить», более скептически относиться к жизни.

Старая шутка о незнании, кто человек или собака по ту сторону экрана, никогда не выйдет из моды, и технически ее нетрудно реализовать. Более распространенной операцией является общение с собеседником с помощью программного обеспечения виртуальной камеры и функции смены лица искусственного интеллекта.

Технологическая компания Шэньчжэня, опрошенная CCTV и оказывающая техническую поддержку агентству общественной безопасности, рассказала, что при изменении лица в реальном времени в видеочате, будь то аватар или фотография из круга друзей, после загрузки изображения распознавание функций занимает всего лишь около 30 секунд, а затем ИИ начинает строить модель, выполнять преобразование в реальном времени после завершения моделирования.

Возможно, вы по-прежнему опасаетесь видеороликов «один на один», но как насчет «профессиональной команды» «один ко многим»?

Недавно из-за ИИ у гонконгского филиала транснациональной компании было украдено 25 миллионов долларов США. Пострадавший был финансовым служащим. Он получил электронное письмо от "финансового директора" британской штаб-квартиры и был приглашен на видеоконференцию, посвященную "секретным сделкам". На встрече присутствовал не только "финансовый директор", но и несколько знакомые «коллеги»».

Коллег, участвовавших в встрече, на самом деле не присутствовало: мошенник скачал общедоступное видео, подделал лицо и голос реального человека через Deepfake, а затем применил его к видеоконференции. Чтобы не разглашать тайну, "финансовый директор" отдал приказ в одностороннем порядке. "Коллеги" не общались с жертвой, и видео быстро зависло. Мошенник продолжал связываться с жертвой посредством электронной почты и других способов.

▲ Полиция продемонстрировала, как использовать Deepfake для фальсификации видеоконференции с участием нескольких человек.

Хотя по этому поводу есть результаты расследования, некоторые пользователи сети подозревают, что это всего лишь инсайдерская информация. Меры по управлению рисками и контролю, принимаемые транснациональными компаниями, неизвестны, но несомненно то, что изменение лица с помощью ИИ также может быть распространено на многие места: от самой ранней смены головы в порнографических фильмах до фальшивых знаменитостей, приносящих товары в залах прямых трансляций.

К счастью, ИИ еще не идеален, а метод идентификации по-прежнему прост и осуществим.

Если это видео, меняющее лицо через AI, исходное изображение камеры потребляет много вычислительной мощности при преобразовании нескольких слоев, а звук и изображение часто задерживаются. Кроме того, вы можете подсказать другому человеку выполнить некоторые действия, например открыть рот, значительно покачать головой, подвигать пальцами вперед и назад перед лицом и т. д. Если ИИ меняет лицо, «лицо» может быть деформированный и дефектный.

Помимо преодоления технических ошибок, есть еще один трюк, который каждый раз опробован и проверен, а именно задать несколько вопросов о конфиденциальности, которые вы знаете, я знаю, а он не знает, или вы можете выдумывать ложь и намеренно используйте уловки, чтобы увидеть, как отреагирует другая сторона.

Конечно, отсутствие технологий может решить лишь временные трудности. С тем же успехом мы могли бы презирать их стратегически и обращать на них внимание тактически. Мы не можем думать, что нас не обманут. Возможно, игра высокого класса еще не появилась. .

Мошенничества с использованием ИИ не новы, но возник новый цифровой разрыв

2023 год известен как первый год генеративного искусственного интеллекта. Однако продвижение технологий отстает. Возможно, большинство обычных людей смогут лучше понять, как технология, которая кажется не новой, но стала более популярной в последние годы, повлияла на повседневную жизнь.

Все понимают, что технология — это палка о двух концах. Elevenlabs позволяет людям с языковым барьером говорить, HeyGen позволяет Swift синхронизировать китайский язык без перевода, а Miaoya Camera позволяет людям получать усовершенствованные сертификаты, не выходя из дома. Оказывается, есть нет правильного или неправильного между светлой и темной сторонами технологий, они просто существуют объективно.

Однако для многих людей среднего и пожилого возраста смартфоны и Интернет им непонятны, и теперь ИИ снова доставляет неприятности.

В эпоху искусственного интеллекта текст, звук, изображения и видео могут быть фальшивыми или даже появляться в комбинации. скорее всего обманут.

Использование магии для борьбы с магией и использование технологий для нападения и защиты технологий — это игра в кошки-мышки, которую люди среднего и пожилого возраста, возможно, не смогут быстро переварить. -пожилые и пожилые люди обманываются.

Независимо от того, как развиваются технологии, многие схемы мошенничества остаются прежними: кража конфиденциальности, использование страха, жадности и эмоциональной ценности для выдумывания историй, выдача себя за знакомых или маскировка себя, чтобы завоевать доверие, с деньгами в качестве конечной цели.

После того, как AI Fashion Pope вышел из индустрии, X (ранее Twitter) V с почти 13 миллионами фанатов посетовал: «Я думал, что пуховик Папы Римского настоящий, и особо не задумывался об этом. Я не могу выжить. будущее технологий».

Людям среднего и пожилого возраста труднее адаптироваться к правилам, согласно которым виденное не обязательно является правдой, а картинки не обязательно являются правдой. Мы можем показать им несколько простых, традиционных, но все же эффективных методов.

Один тип — быть осторожным и не доверять легко контенту Интернета, не отвечать на оскорбительные звонки, не нажимать на незнакомые ссылки и стараться не раскрывать слишком много личной биометрической информации, такой как лица, голоса, отпечатки пальцев и т. д. Интернет.

Не верьте слепо «односторонним словам», особенно когда вы получаете подозрительные телефонные звонки или текстовые сообщения. Независимо от того, кем является другая сторона, у нее есть разные точки зрения, когда дело касается денег. Используйте несколько методов, чтобы проверить Если собеседник говорит, что с вашей семьей что-то случилось, перезвоните ему еще раз. Позвоните, чтобы подтвердить, правда ли это.

Другой тип — инициативный и подготовленный. Люди среднего и пожилого возраста имеют свои собственные предпочтительные средства массовой информации. Члены их семей могут пересылать им антимошеннический контент из официальных аккаунтов правительственных ведомств WeChat и других источников. Если позволяют условия, вы также можете показать людям среднего и пожилого возраста, как использовать инструменты искусственного интеллекта, такие как ChatGPT.

Конечно, для пожилых людей, которые не разбираются в смартфонах, попробуйте решить проблему в первоисточнике: лучше всего не привязывать банковские карты к WeChat или Alipay и сохранять лишь небольшую сумму сдачи.

Успешное мошенничество с использованием ИИ — это лишь конечный результат, но предотвращение мошенничества с использованием ИИ может начаться в любой момент.

Только тогда мы сможем совместно двигаться к будущему, в котором технологии не будут бояться, а будут использоваться рационально.

# Добро пожаловать на официальную общедоступную учетную запись aifaner в WeChat: aifaner (идентификатор WeChat: ifanr). Более интересный контент будет предоставлен вам как можно скорее.

Ай Фанер | Исходная ссылка · Посмотреть комментарии · Sina Weibo