Как Google сделал портретный световой эффект на Pixel 5?

Мы слишком часто слышали термин «компьютерная фотография» за последние два года.

Когда дело доходит до компьютерной фотографии, люди, естественно, думают о серии мобильных телефонов Google Pxiel. Можно сказать, что эта серия создала прецедент компьютерной фотографии. Она раскрывает силу и очарование компьютерной фотографии.

Именно потому, что возможности компьютерной фотографии настолько поразительны, производители мобильных телефонов, которые постепенно вспоминали последние два года, наконец, погрузились в нее. В это время Google уже разыгрывает больше цветов.

«Портретный световой эффект» был первоначально запущен с выпуском Google Pixel 4a и Pixel 5 в октябре этого года, который является эксклюзивной особенностью Pixel этого поколения. Но несколько дней назад Google обновил приложения для камеры и фотоальбома, делегировав эту функцию пользователям после Pixel 2.

Вдохновленный освещением, используемым фотографами-портретистами, «Portrait Light Effect» может изменять положение и моделировать источник света, а затем добавлять новый источник света в сцену фотографии. Он также может определять направление и интенсивность первоначального освещения, а затем автоматически дополнять ситуацию освещения.

Такая мощная функция вычислительной фотографии, естественно, неотделима от возможностей машинного обучения нейронных сетей. После того, как фотографии, сделанные в режиме портретного светового эффекта мобильного телефона, используются в качестве базы данных для обучения, более поздние возможности «портретного светового эффекта» позволяют использовать два новых алгоритма:

- Автоматически добавлять синтетический источник света: для данной портретной фотографии алгоритм синтезирует и добавит внешний источник света, и освещение и освещение фотографа будут согласованными в реальности.

- Повторное освещение после композиции: для заданного направления освещения и портретной фотографии добавьте составной свет наиболее естественным образом.

Позвольте мне сначала поговорить о первой проблеме, которая заключается в том, чтобы определить положение источника света и добавить его. На самом деле фотографы обычно используют эмпирический и перцептивный путь, наблюдая за интенсивностью и положением света, падающего на лицо объекта, а затем определяя, как его осветить. Но для ИИ непросто определить направление и положение существующего источника света.

С этой целью Google внедрил новую модель машинного обучения – контуры всенаправленного освещения. Эта новая модель расчета освещения может использовать человеческое лицо в качестве детектора света для определения направления, относительной интенсивности и цвета источника света по всем источникам света, а также может оценивать положение головы на фотографии с помощью другого алгоритма лица.

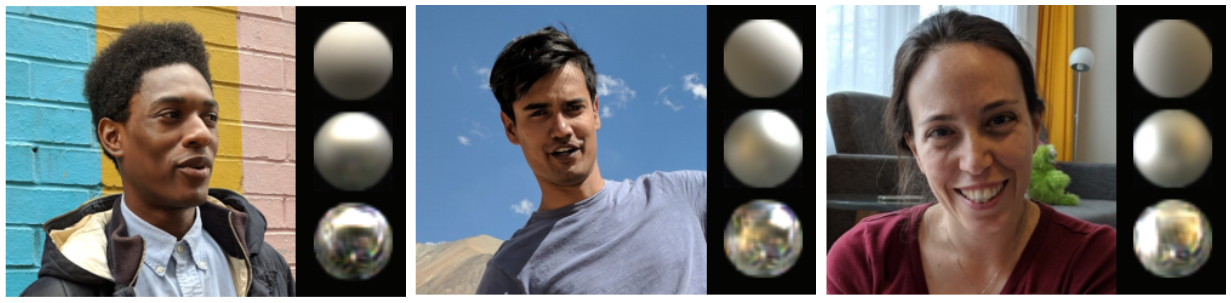

Хотя это звучит очень высоким, эффект рендеринга реальной обучающей модели довольно приятный. Он будет рассматривать человеческую голову как три круглых серебряных сферических объекта. «Текстура» верхнего шара – самая грубая, используемая для имитации Рассеянное отражение света. Шар посередине тоже матовый, что используется для имитации более концентрированного источника света. Нижний шар – это «материал» зеркала, который используется для имитации более плавного зеркального отражения.

Кроме того, каждая сфера может отражать цвет, интенсивность и направленность окружающего освещения в соответствии со своими характеристиками.

Таким образом, Google может получить направление посткомпозиционного источника света. Например, классический портретный источник света расположен на 30 ° над линией обзора и между 30 ° и 60 ° относительно оси камеры. Google также следует этому классическому правилу.

После изучения направления добавления источников света к портретам, следующее, что нужно сделать, – как сделать добавленные источники света более естественными.

Предыдущий вопрос немного похож на «Девять мечей Дугу». После его изучения я задам несколько фиксированных вопросов. Чтобы решить последнюю проблему, вам нужно сделать "Dugu Nine Swords" как можно более реальным боем, интегрировать различные реальные ситуации, а затем научиться взламывать мировые боевые искусства.

Чтобы решить эту проблему, Google разработал еще одну новую обучающую модель для определения самонаправленного источника света, который нужно добавить к исходной фотографии. При нормальных обстоятельствах невозможно обучить эту модель существующим данным, потому что она не может выдерживать почти бесконечное воздействие света и должна полностью соответствовать человеческому лицу.

По этой причине Google создал совершенно особенное устройство для обучения машинному обучению – сферическую «клетку». В этом устройстве 64 камеры с разными углами обзора и 331 индивидуально программируемый светодиодный источник света.

Если вы были в Dolby Cinema, в предварительном просмотре Dolby Cinema есть ссылка, где звук движется в полусферическом куполе, имитируя почти бесконечное направление в реальности. На самом деле устройство Google имеет похожий принцип.

Постоянно изменяя направление и интенсивность освещения и моделируя сложный источник света, вы можете получить данные об отраженном свете человеческих волос, кожи и одежды, чтобы получить то, каким должно быть освещение под сложным источником света.

Google пригласил 70 разных людей для тренировки этой модели с разными формами лица, прическами, цветом кожи, одеждой, аксессуарами и другими характеристиками. Это гарантирует, что синтезированный источник света максимально соответствует реальности.

Кроме того, Google не выводит напрямую окончательное изображение через модель нейронной сети, но позволяет модели нейронной сети выводить изображение с более низким разрешением.

Вот объяснение того, что такое частное изображение. Картинку можно разбить на два слоя: нижний слой и слой деталей. Нижний слой содержит низкочастотную информацию изображения, которая отражает изменения интенсивности изображения в крупном масштабе; слой деталей содержит высокочастотную информацию изображения, которая отражает детали изображения в мелком масштабе. Нижний слой, умноженный на слой деталей, является исходным изображением, а слой деталей также может называться частным изображением.

Затем через нижний слой исходного изображения, добавляя дополнительные источники света к данным входного частного изображения во время выборки, вы можете получить окончательное выходное изображение.

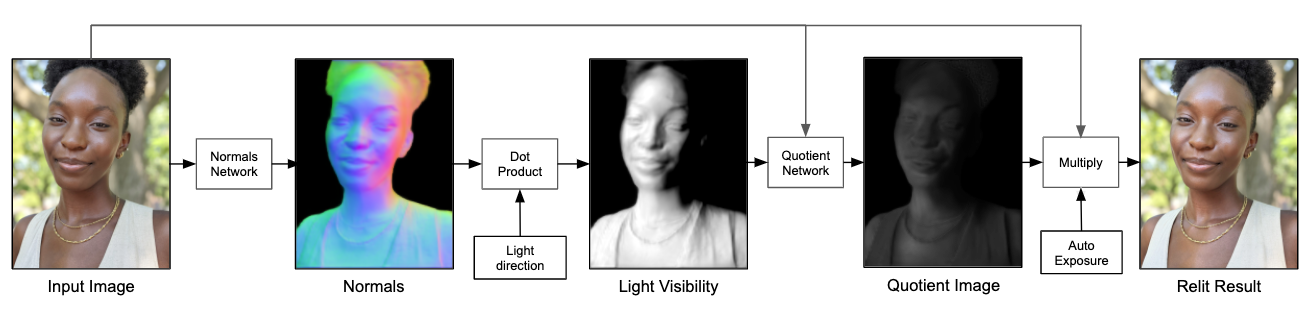

Финальный процесс выглядит следующим образом. Сначала, учитывая изображение, затем вычисляют нормаль к поверхности персонажа на изображении, затем вычисляют видимый источник света на изображении и используют модель нейронной сети для моделирования дополнительного источника света для вывода изображения с коэффициентом более низкого разрешения, а затем используют его как Слой деталей умножается на нижний слой исходной фотографии, и, наконец, получается портретная фотография с дополнительными источниками света.

Google также произвел много оптимизаций в конвейере, чтобы смоделированные световые эффекты можно было взаимодействовать в реальном времени на мобильном телефоне, в то время как размер всей модели составляет всего около 10 МБ.

Эффект портретного освещения Pixel 5. Можно сказать, что это типичный случай вычислительной фотографии Google. Благодаря непрерывному обучению моделей нейронных сетей мобильный телефон может имитировать освещение реальных портретов. Доработан новый прикладной сценарий компьютерной фотографии.

Некоторые люди говорят, что фотография – это искусство, а компьютерная фотография – это, по сути, оскорбление фотографии. Но с тех пор, как француз Дагер создал первую практическую камеру в 1839 году, камера используется уже более 100 лет. От нишевого до массового, до появления камеры мобильного телефона, у всех есть почти равные возможности делать снимки. Выражение людских сердец постепенно обогатило искусство фотографии.

Правильно, компьютерная фотография – это одновременно «фотография» и «вычисление теней», но алгоритмы уже давно являются неотъемлемой частью мобильной фотографии. Погоня по-прежнему остается эффектом, которого можно достичь в смоделированной реальности. В конце концов, никто не будет «Волшебное изменение» называется компьютерной фотографией.

Когда Apple и Google пошли дальше и дальше в области вычислительной фотографии, мы обнаружили, что алгоритмы на самом деле являются более сильным барьером, чем оборудование.

# Добро пожаловать в официальный аккаунт Aifaner в WeChat: Aifaner (идентификатор WeChat: ifanr), более интересный контент будет предоставлен вам в ближайшее время.

Ai Faner | Исходная ссылка · Посмотреть комментарии · Sina Weibo