Поддельные изображения ИИ появляются в поиске Google — и это проблема

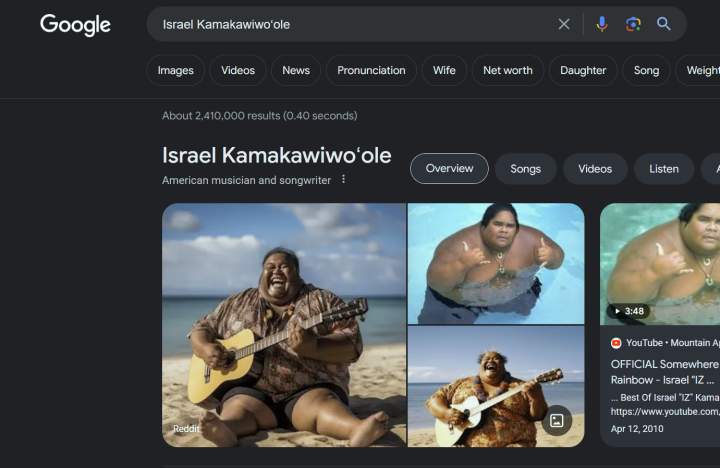

Прямо сейчас, если вы введете «Исраэль Камакавивооле» в поиск Google, вы не увидите ни одной из обложек знаменитых альбомов певца или изображения, на котором он исполняет одну из своих песен на своей культовой гавайской гитаре. Сначала вы видите изображение мужчины, сидящего на пляже с улыбкой на лице, а не фотографию самого человека, сделанную на камеру. Это фейковая фотография, созданная искусственным интеллектом. Фактически, когда вы нажимаете на изображение, вы попадаете на сабреддит Midjourney , где изначально была размещена серия изображений.

Впервые я увидел это сообщение Итана Моллика на X (ранее известном как Twitter), профессора Уортона, изучающего ИИ.

Глядя на фотографию вблизи, нетрудно увидеть все следы ИИ, оставленные на ней. Эффект фальшивой глубины резкости применен неравномерно, текстура на его рубашке искажена, и, конечно же, на его левой руке отсутствует палец. Но все это неудивительно. Какими бы хорошими ни стали изображения, созданные с помощью ИИ, за последний год, их по-прежнему довольно легко обнаружить, если присмотреться.

Однако настоящая проблема заключается в том, что эти изображения появляются в качестве первого результата для известной, известной личности без каких-либо водяных знаков или указаний на то, что они созданы искусственным интеллектом. Google никогда не гарантировал подлинность результатов поиска изображений, но есть в этом что-то очень тревожное.

Теперь есть несколько возможных объяснений того, почему это произошло в данном конкретном случае. Гавайский певец, широко известный как Из, скончался в 1997 году, и Google всегда хочет предоставлять пользователям самую свежую информацию. Но учитывая, что с тех пор об Изе появилось не так много новых статей или дискуссий, нетрудно понять, почему алгоритм это уловил. И хотя для Иза это не кажется особенно важным, нетрудно представить примеры, которые были бы гораздо более проблематичными.

Даже если мы и дальше не увидим, как это происходит в результатах поиска, это яркий пример того, почему Google необходимо иметь правила по этому поводу. По крайней мере, кажется, что изображения, созданные ИИ, должны быть каким-то образом четко обозначены, прежде чем ситуация выйдет из-под контроля. По крайней мере, дайте нам возможность автоматически фильтровать изображения ИИ. Однако, учитывая собственный интерес Google к контенту, генерируемому ИИ , есть основания полагать, что компания может захотеть найти способы внедрить созданный ИИ контент в свои результаты, а не четко маркировать его.