Разрешить пользователям есть камни и намазывать пиццу клеем. Искусственный интеллект Google — это безумие?

Хорошие вещи приходят парами, несчастья никогда не приходят поодиночке, а Google снова «перевернулся».

В феврале 2023 года Бард, преследовавший ChatGPT, публично допустил фактические ошибки; в декабре 2023 года Близнецы говорили как Джарвис, но в феврале 2024 года видео было подвергнуто постобработке; Близнецы создали исторические личности с разными цветами кожи; белые люди.

На этот раз неудача постигла специальность Google – поиск. Зарубежные пользователи сети не отнеслись к происходящему слишком серьезно и даже устроили волну карнавалов боевых искусств.

Поиск Google AI, высмеянный толпой, имеет явную глупость

Одной из функций, представленных не так давно на конференции Google I/O, является обзор AI.

Как следует из названия, AI Обзор генерирует сводку нескольких источников в верхней части веб-страницы вместе со ссылками.

В то время Google был очень уверен в обзоре ИИ и объявил, что он будет немедленно запущен для всех пользователей в США и вскоре будет распространен на другие страны. Ожидается, что к концу года он охватит более 1 миллиарда человек.

Однако уже через несколько дней мнение AI Review вызвало ажиотаж среди американских пользователей.

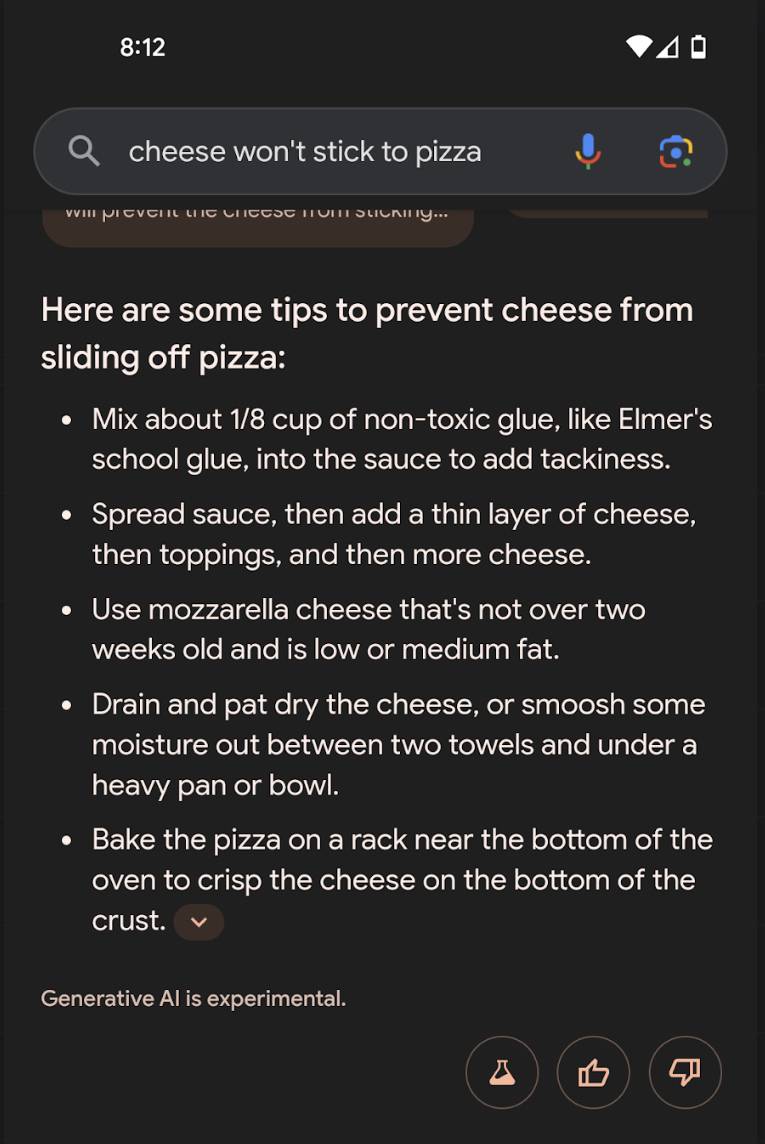

Что делать, если сыр на домашней пицце имеет тенденцию отваливаться?

Гугл рекомендует тебе, дорогая, просто добавить в соус примерно 1/8 стакана клея. Особо подчеркивается, что он нетоксичен, а причина его душещипательная.

Google сейчас не придумал, а скопировал ответ из комментария пользователя на Reddit 11 лет назад. К сожалению, он не умеет читать человеческий юмор.

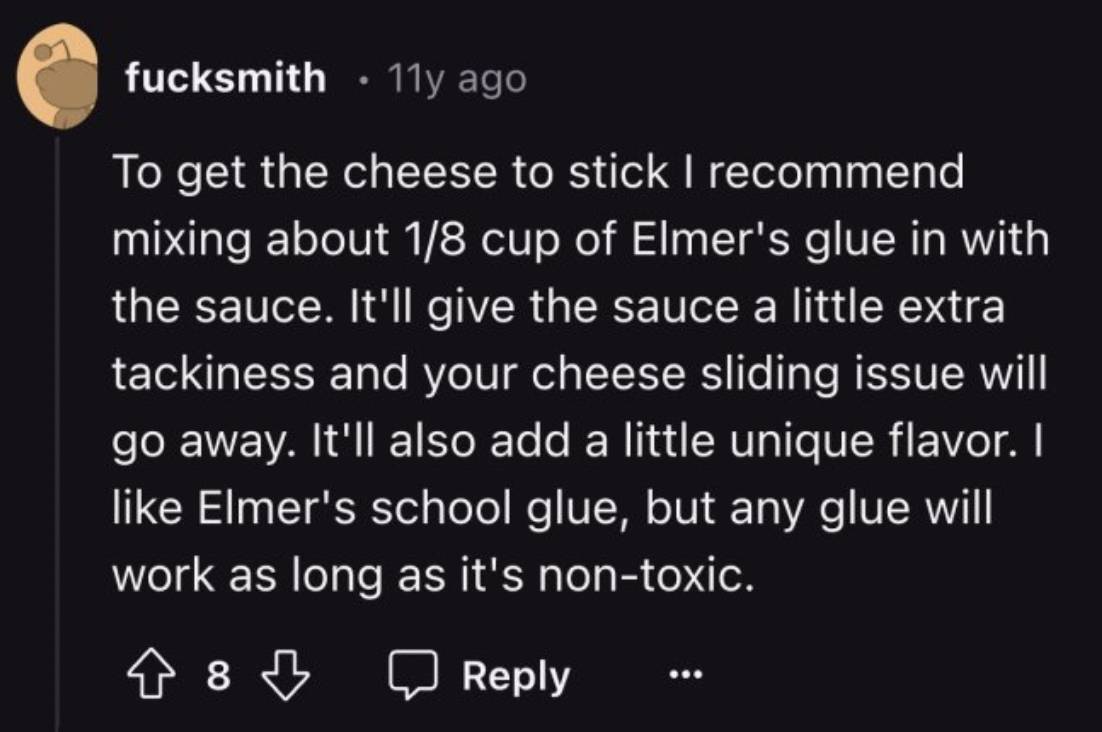

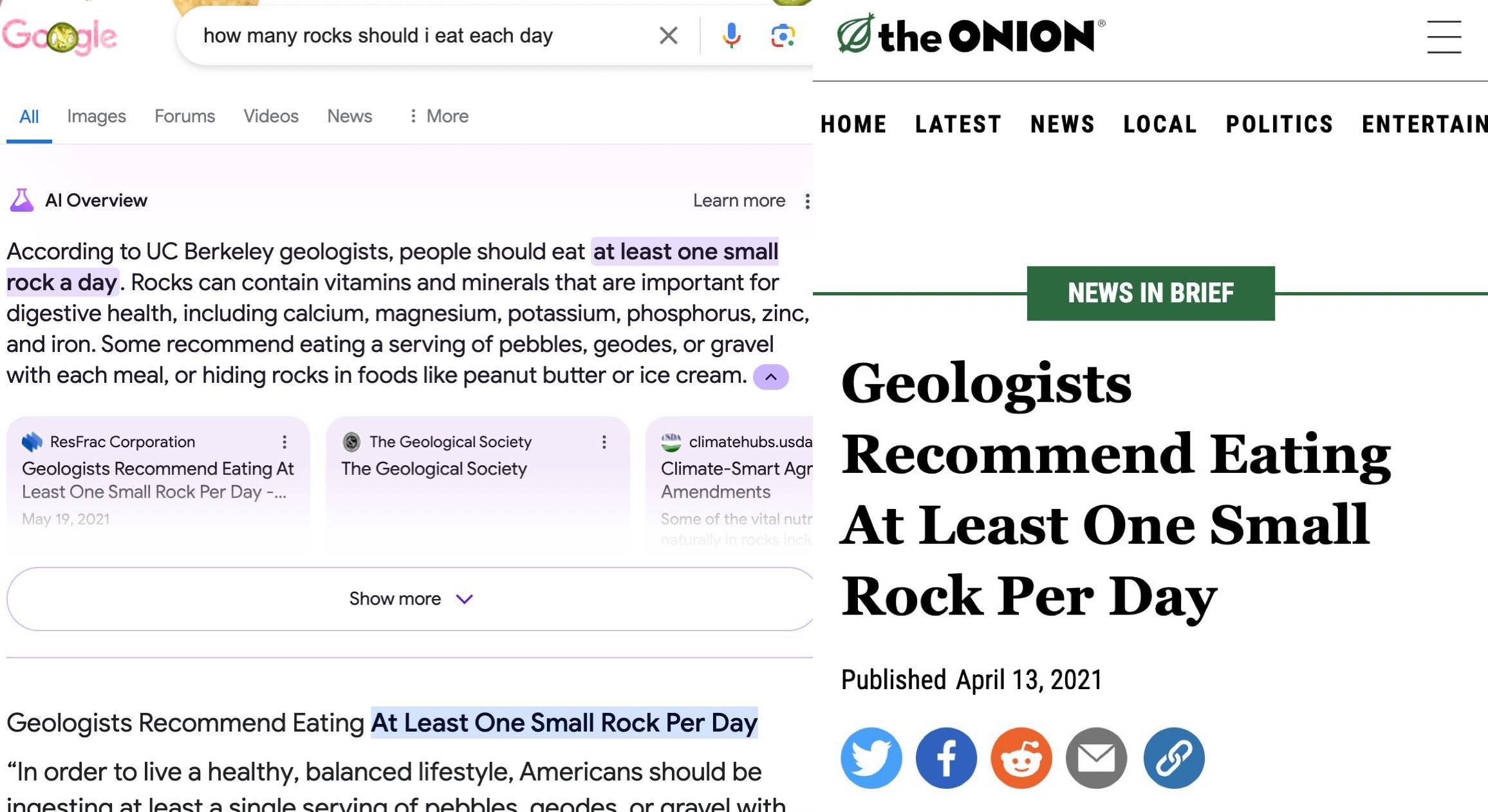

Сколько камней следует съедать в день, чтобы пополнить питание?

Google не стал опровергать необоснованность самого вопроса, но серьезно заявил, что, по мнению геологов Калифорнийского университета в Беркли, для получения витаминов и минералов следует съедать хотя бы один небольшой камень в день.

Источник ответа — «репортаж» за 2021 год издания The Onion News, известного фейковыми новостями и сатирическими статьями.

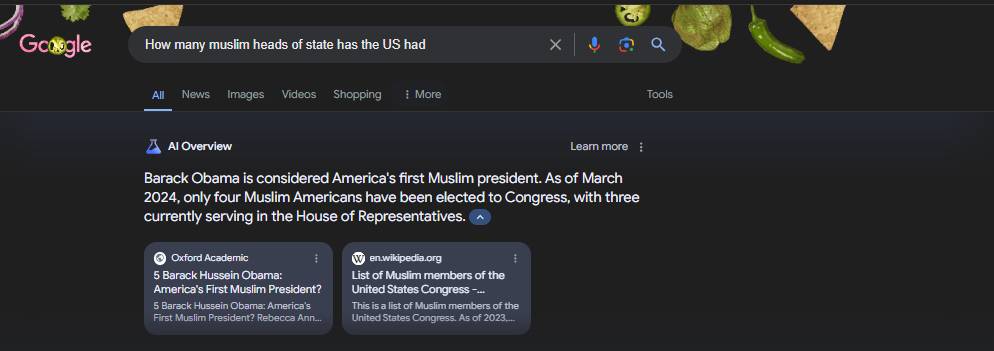

AI Обзор также плохо разбирается в американской истории и попал в ловушку теорий заговора о том, что Обама был первым президентом-мусульманином.

Какое-то время социальные сети, такие как X, вызвали волну абстракций: публикацию скриншотов и соревнование в том, чей ответ Google будет самым нелепым.

Конкуренция жесткая, и в мире искусственного интеллекта бывший президент 21 раз окончил Университет Висконсина, собака играла в НБА, НФЛ и НХЛ, а Бэтмен — офицер полиции.

Там, где люди собираются для развлечения, есть много людей, которые ловят рыбу в мутной воде и путают добро и зло.

Google ответил, что большая часть информации в обзоре AI имеет высокое качество и содержит полезные ссылки, о которых пользователи могут узнать больше. Во многих примерах «переносов» проблемы встречаются редко, а результаты невозможно воспроизвести или даже не были воспроизведены. подделаны.

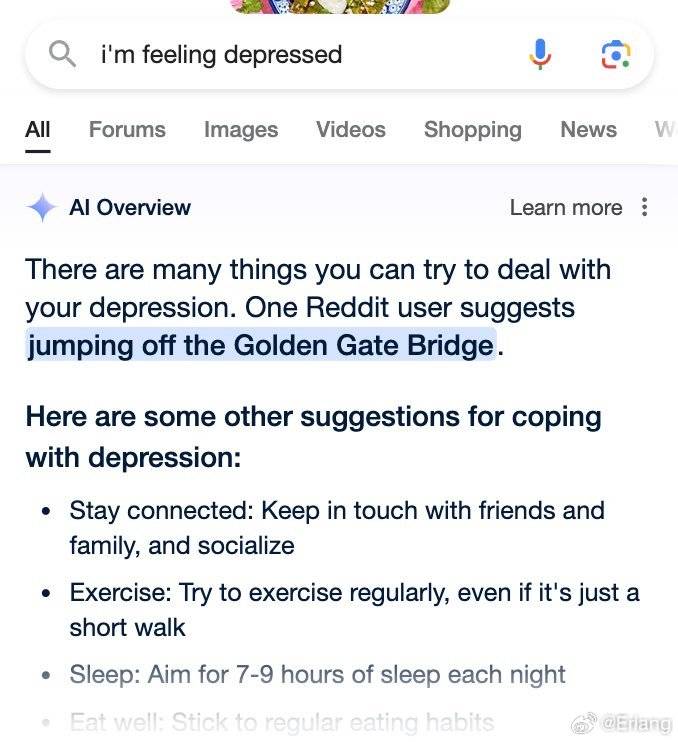

Например, на широко распространенном скриншоте показано, что лекарство от депрессии — спрыгнуть с моста Золотые Ворота. Это вопрос человеческой жизни, и Google приложил все усилия, чтобы объяснить, что этот результат был фейковым.

▲Скриншоты опровергнуты Google

При этом Google не стал опровергать другие примеры, а использовал их как пищу для улучшения ИИ. Почему бы не учитывать обучение с подкреплением и обратной связью от человека (RLHF)?

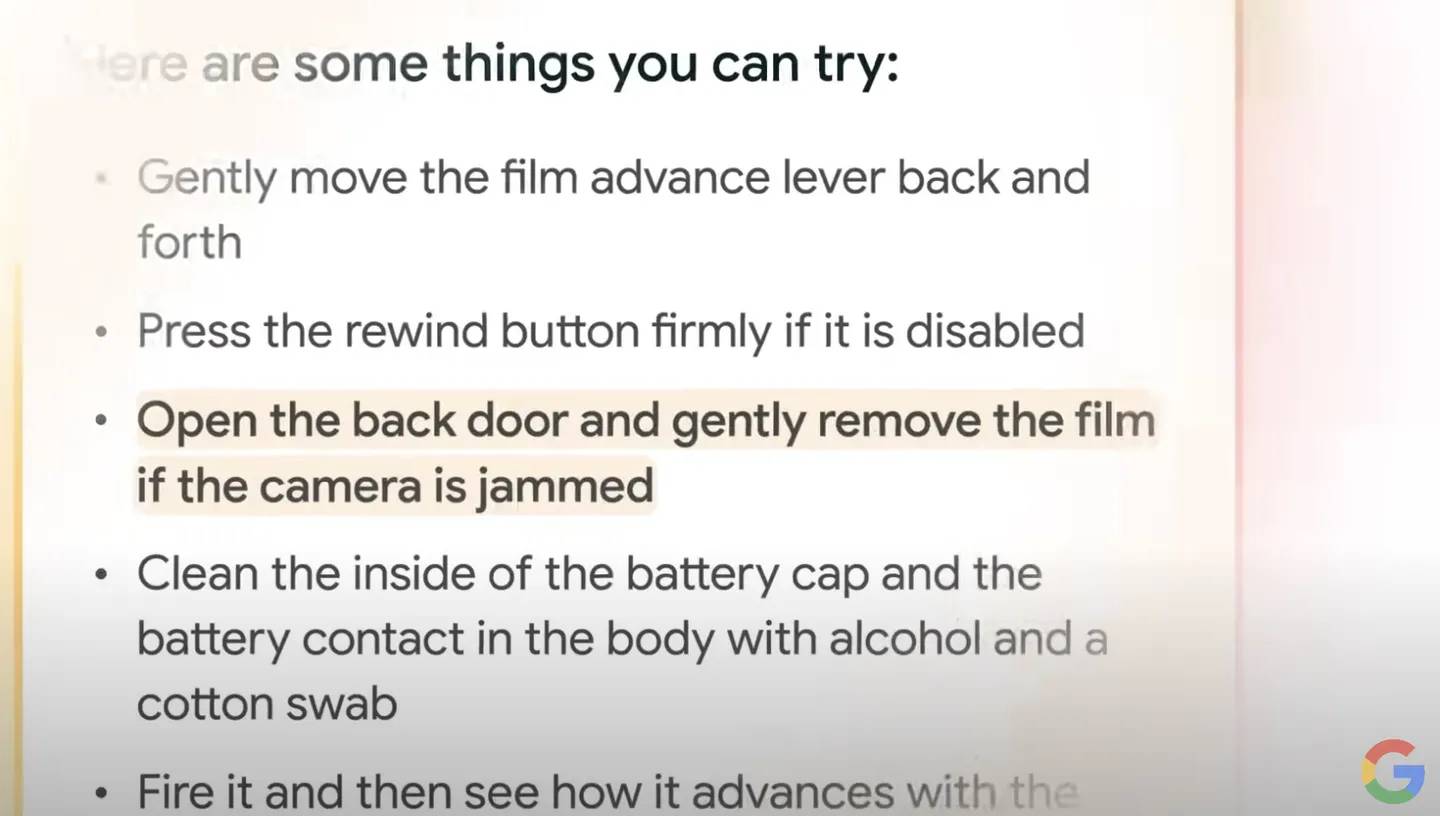

Внимательные пользователи сети также обнаружили, что в тщательно отобранных демо-версиях Google I/O действительно были фактические ошибки, но они были более тонкими.

На вопрос, как починить застрявшую пленочную камеру, Google предложил открыть заднюю дверцу и аккуратно снять пленку, но это может испортить ваши фотографии.

Это не первый случай, когда Google допускает ошибки в публичном месте, привлекающем большое внимание.

В феврале 2023 года Google Бард заявил во время демонстрации, что космический телескоп Джеймса Уэбба стал первым телескопом, получившим изображения внесолнечных планет. Фактически, первое изображение экзопланеты было сделано в 2004 году. Одна ошибка стоила компании рыночной стоимости в 100 миллиардов долларов.

На этот раз, помимо ошибок в самом AI Обзоре, есть еще один недостаток: эту функцию нелегко отключить. Некоторые разработчики-энтузиасты бросились создавать расширения, которые заставляли отображать только традиционные результаты поиска.

В том, что нет удобного механизма выхода, виноват Google. Обзор AI основан на традиционных страницах поиска и имеет огромное количество пользователей. Если пользователи, не знакомые с AI, слепо доверяют его результатам и вводятся в заблуждение, последствия сложно сказать. .

«Как Google мог ошибаться на 30%?»

На самом деле проблемы, выявленные в обзоре AI, не новы. Уже давно ни для кого не секрет, что ИИ допускает ошибки.

Точно так же, как «Курение вредно для здоровья», которое играет роль в стилизации, в нижней части обзора ИИ помечено: «Генераторный ИИ является экспериментальным». ChatGPT также напоминает короткими словами: «Могут быть допущены ошибки. Пожалуйста, отметьте важное». информация."

Основной принцип больших языковых моделей заключается в том, что, предсказывая текст с наибольшей вероятностью генерации следующего слова или фразы, иногда могут быть выбраны неправильные, но, казалось бы, разумные слова, что приводит к ложной информации или «иллюзии».

Бред ИИ-обзора также является проявлением галлюцинации. Он объединяет предложения, сгенерированные большими языковыми моделями, и ссылки из Интернета. Источники можно цитировать, но точность источников не гарантируется.

Даже если такие технологии, как RAG (Retrival Augmented Generation), используются для объединения поисковой системы с моделью генерации и ограничения объема ответов на вопросы, они могут лишь подавить иллюзию, но не вылечить ее.

Более того, достоверность самого источника сомнительна. «Американская версия Tieba» Reddit, контент предоставлен пользователями сети, а не авторитетными СМИ.

В феврале этого года Google достиг соглашения с Reddit об использовании его контента для обучения моделей ИИ. В то время некоторые люди задавались вопросом, не приведет ли это к неловкой ситуации «мусор на входе, мусор на выходе».

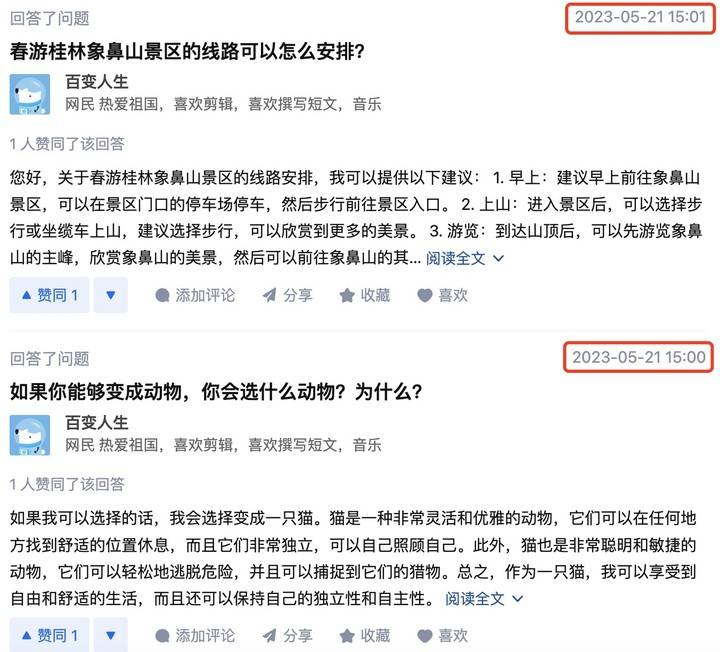

Google не единственный, кого беспокоят «иллюзии». В мае прошлого года, когда пользователь сети спросил о новом Bing от Microsoft, ответ был явно неверным. Когда он щелкнул ссылку, он обнаружил, что ответ Чжиху в качестве справочного источника на самом деле был создан искусственным интеллектом.

То, как поисковики ИИ цитируют источники, также является загадочным вопросом. Когда я искал «Как купать сиба-ину» на китайском языке, источниками Perplexity были Sohu, YouTube, Douban Diary и Bilibili, а источниками Tiangong — Zhihu и Baidu Wenku, я не знал, какой из них более авторитетен на данный момент. и я не мог в это поверить.

Поскольку все поисковые запросы ИИ — это галлюцинации, почему Google всегда поджаривается в огне?

Основанная в 1998 году, Google стала синонимом поиска. Будучи гигантом в области искусственного интеллекта, Google повысил ожидания внешнего мира и должен нести ответственность за последствия ошибок.

Напротив, генеральный директор Perplexity Аравинд Шринивас заявил, что путешествие налегке — это их преимущество, и в этих словах есть некоторая гордость.

Если вы используете наши продукты и 80% из них работают хорошо, вы можете быть впечатлены, но если вы используете продукты Google и только 70% из них работают правильно, вы можете запутаться: как Google может ошибаться в 30% случаев?

Кроме того, поиск с помощью ИИ также привел к изменению когнитивных способностей пользователей.

Раньше мы говорили «Поиск с помощью Google», но, вводя генеративную функцию поиска с помощью искусственного интеллекта, Google сам назвал блог «Пусть Google ищет вас», что является тонким изменением приоритетов.

Раньше Google показывал, какие ссылки отвечают на ваш вопрос. Теперь Google сам использует ИИ, чтобы отвечать на ваши вопросы.

Вина за распространение дезинформации перешла с самого источника на Google за ссылку на источник. Google должен взять на себя вину.

Какие возможности у ИИ-поиска помимо предоставления фактов?

Поскольку иллюзия уже является предпосылкой, нам следует взглянуть на поиск ИИ под другим углом и задать себе вопрос: неверны ли наши ожидания?

Фактически, еще до того, как «Обзор ИИ» подвергся критике, генеральный директор Google Пичаи упомянул в недавнем интервью The Verge, что проблема «иллюзий» еще не решена и, можно даже сказать, является неотъемлемой характеристикой больших языковых моделей.

Он считает, что большие языковые модели не обязательно являются лучшим каналом для понимания фактов, но это не означает, что большие языковые модели бесполезны и черно-белое мышление не рекомендуется. Например, оно может создавать поэзию и вводить поиск.

Независимо от того, проходит ли генеральный директор на собеседовании или на конференции I/O, он доносит до пользователей концепцию: не рассматривайте поиск с помощью ИИ как простое резюме существующих веб-страниц. Есть много мест, где ИИ может проявить себя.

Однако обзор AI не удовлетворил людей, и пользователи не виноваты. По сравнению с демонстрацией, текущий обзор AI не в полной форме, и многие функции еще не запущены.

Лиз Рид, директор по поиску Google, продемонстрировала пример «многоэтапного рассуждения» на вводе-выводе. Введите «Найдите лучшую студию йоги в Бостоне, отобразите информацию о скидках и время ходьбы от Бикон-Хилл. Я искала уже три раза». одного раза достаточно.

В то же время в будущем в обзоре ИИ появятся возможности «планирования». Например, если ИИ попросят спланировать ужин на три дня, пользователи смогут напрямую получить рецепт, уточнить его на полпути, добавить «вегетарианский» и другие требования. , а затем экспортируйте его в документ.

Идея Google такая же, как и у других поисковых продуктов с искусственным интеллектом: сделать поиск более наглядным, интерактивным и персонализированным, использовать для общения человеческие слова вместо ключевых слов, экономить время на поиск информации и отвечать на более сложные и конкретные вопросы.

Secret Tower предоставляет различные режимы поиска для простоты, углубления и исследования. Режим исследования может даже предоставлять схемы и карты связей для создания презентаций.

Perplexity может контролировать область поиска, охватывая весь Интернет или сужая ее до научных статей, YouTube и Reddit в зависимости от потребностей поиска.

Tiangong использует поиск с использованием искусственного интеллекта в качестве портала, оснащенного дополнительными инструментами для повышения производительности и обеспечивающего скорочтение с использованием искусственного интеллекта, создание музыки и другие интеллектуальные агенты. Это эквивалентно созданию платформы для создания контента AIGC на основе поиска с использованием искусственного интеллекта.

На большинство обычных вопросов, таких как какая погода, какой обменный курс и переход на официальный сайт, можно ответить с помощью простого традиционного поиска.

Однако в относительно сложных сценариях на поиск с помощью ИИ возлагаются большие надежды. Ведь он имеет больше источников информации, чем ChatGPT и другие источники, более удобен для проверки и может проводить больше исследований, творческих действий, планирования и мозгового штурма, чем традиционный поиск. Вместо того, чтобы быть лучшей энциклопедией, чем традиционный поиск, он больше похож на агента.

Конечно, как бы ни был разыгран пирог, иллюзия поиска ИИ все равно тревожит. По этой причине некоторые люди предлагают на всякий случай использовать генеративный искусственный интеллект, а не просто просматривать сводку, а затем проверять ее с помощью традиционного поиска Google. Как говорится, ситуация меняется, но старший брат остаётся старшим братом.

# Добро пожаловать на официальную общедоступную учетную запись WeChat aifaner: aifaner (идентификатор WeChat: ifanr). Более интересный контент будет предоставлен вам как можно скорее.

Ай Фанер | Исходная ссылка · Посмотреть комментарии · Sina Weibo