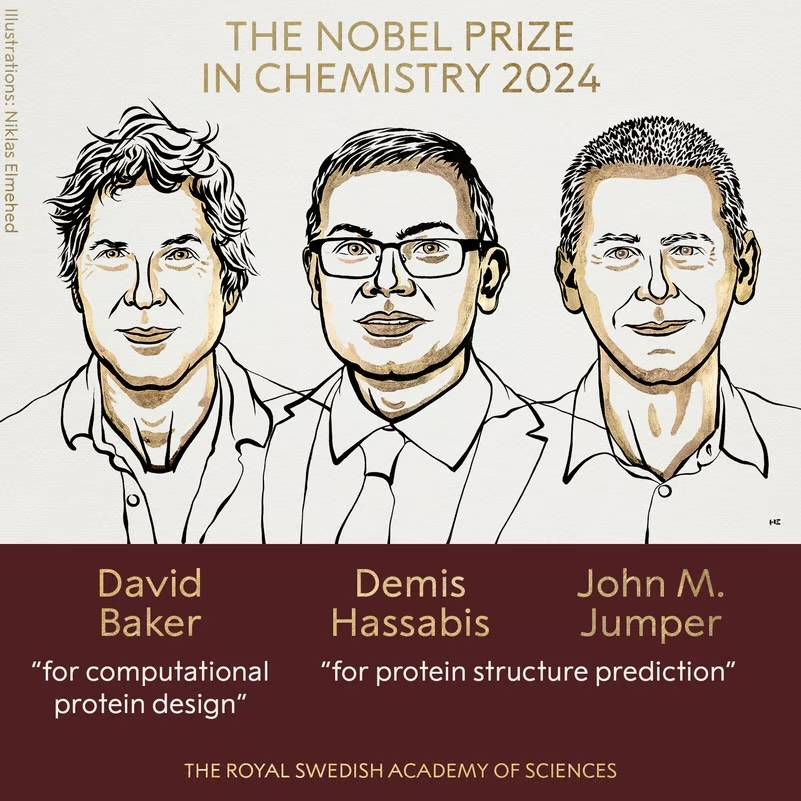

только! Генеральный директор Deepmind получил Нобелевскую премию по химии 2024 года. Говоря об искусственном интеллекте, он сказал: «Есть переоценка, но она все еще недооценена».

Нобелевскую премию в этом году получит ИИ.

Только что выпущенную Нобелевскую премию по химии выиграли Дэвид Бейкер, Джон М. Джампер и Демис Хассабис. Фамилия должна быть знакома каждому: это основатель Deepmind.

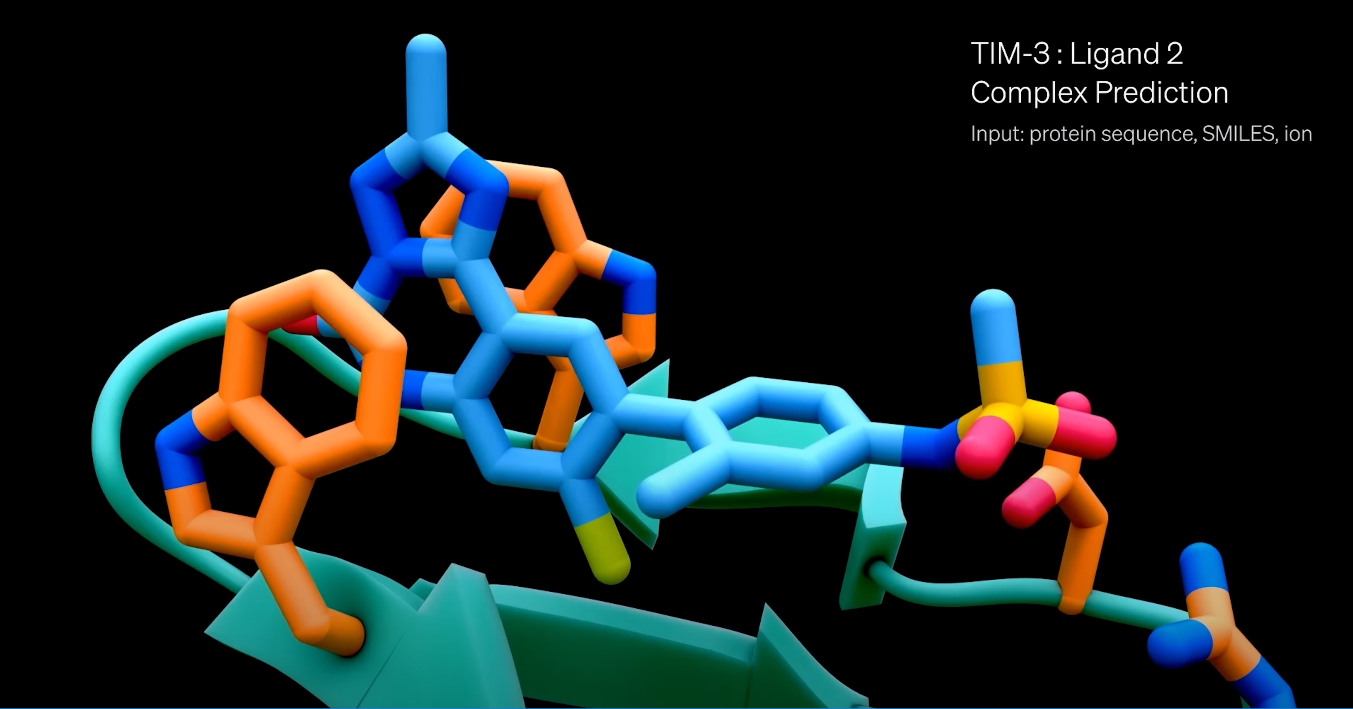

Не так давно Демис Хассабис был гостем на подкаст-канале DeepMind. Столкнувшись с Ханной Фрай (новым директором Института прикладной математики Британского математического общества), он не только рассказал об исследованиях команды в области структуры белков, но и подробно рассказал о них. подробно о работе DeepMind, Gemini и о том, что ждет AGI, и, что более важно: как стать более сбалансированным по мере того, как технология становится более мощной.

Ниже приводится отрывок из разговора, который был отредактирован по содержанию.

Ханна Фрай: Добро пожаловать в Google DeepMind, меня ведет профессор Ханна Фрай. Когда мы впервые начали задумываться о создании этого подкаста в 2017 году, DeepMind была относительно небольшой исследовательской лабораторией, ориентированной на искусственный интеллект. Когда их впервые приобрела Google, они работали над собственным проектом где-то далеко, в Лондоне. В прошлом квартале Google полностью перенастроил свою структуру, поместив команду ИИ в центр своей стратегии.

Демис Хассабис: Нет, абсолютно нет (смеется).

Ханна Фрай: Что ж, большое спасибо, что пришли. Мне интересно: теперь, когда общественный интерес к ИИ стремительно растет, ваша работа стала проще или сложнее?

Демис Хассабис: Я думаю, что это палка о двух концах, да. Это определенно сложнее, потому что вокруг так много внимания, внимания и довольно много шума. На самом деле, я предпочитаю, когда людей меньше и я могу больше сосредоточиться на науке. Но сейчас это также хорошо, потому что показывает, что технологии готовы влиять на мир разными способами и позитивно влиять на повседневную жизнь людей. Так что я думаю, что это тоже интересно.

Ханна Фрай: Вы удивлены тем, как быстро ИИ привлек внимание общественности? Хотя, думаю, вы этого тоже ожидали.

Демис Хассабис: Да, именно, в какой-то момент (уже ожидаемый). Многие из нас работали над этим годами, даже десятилетиями. Поэтому я думаю, что в какой-то момент каждый поймет важность ИИ. Но все же довольно сюрреалистично видеть, как все это действительно осуществилось. Я думаю, это появление чат-ботов и языковых моделей, ведь каждый использует язык и каждый может понимать язык. Так что это простой способ для общественности понять и, возможно, оценить позицию ИИ.

Ханна Фрай: Я слышала, как вы назвали этих чат-ботов «неоправданно полезными», и мне это очень нравится. Мы поговорим о технологии трансформаторов через минуту, и я думаю, что именно этот большой прорыв дал нам эти инструменты. Но теперь я хочу сначала спросить, что вы подразумеваете под «неоправданно полезным»?

Демис Хассабис: Я имею в виду, я думаю, если кто-то вернется на 5-10 лет назад и скажет, что мы собираемся что-то сделать, то это будет примерно так: построить какую-нибудь потрясающую архитектуру, а затем масштабировать ее оттуда, а не строить из нее. какая-то концепция или абстракция – это дискуссия, которая у нас была бы 5, 10 лет назад, нужен ли нам особый способ абстрагирования? Потому что мозг, кажется, делает именно это.

Но каким-то образом, если вы предоставляете системам достаточно данных, скажем, всему Интернету, они, похоже, учатся и обобщают их, не просто наизусть, но действительно, в определенной степени, понимают, с чем имеют дело. И это работает таким образом, что с точки зрения восприятия, несколько иррационально, я не думаю, что кто-то мог подумать пять лет назад, что это работает.

Ханна Фрай: Да, такие вещи, как концептуальное понимание и абстракция, просто происходят естественным образом, а не (проектируются).

Демис Хассабис: Да, раньше мы говорили о таких вещах, как концепции и обоснование, обоснование языка на реальном опыте, может быть, в моделируемой среде, может быть, в воплощенном интеллектуальном роботе, что действительно важно для настоящего понимания мира вокруг нас. Мир необходим. Конечно, эти системы еще не внедрены. Они допустили много ошибок и не имели по-настоящему модели мира, хорошей модели мира. Но они узнали больше, чем люди ожидали, просто изучая язык.

Ханна Фрай: Возможно, нам все еще придется объяснять, что такое заземление для зрителей, которые не знают. Потому что это очень важная концепция.

Демис Хассабис: Конечно, именно по этой причине классическая система исследования искусственного интеллекта была создана в таких местах, как Массачусетский технологический институт, в 1980-х и 1990-х годах. Вы можете думать о них как о гигантских базах данных, связанных с другими словами. Проблема в том, что вы можете сказать, что фраза «у собаки есть ноги» существует в базе данных, но когда вы показываете ей изображение собаки, она не знает, что набор пикселей указывает на это предложение. Это проблема, с которой приходится сталкиваться при проведении работ по заземлению. У вас есть абстрактное представление символов, но в реальном мире — в беспорядочном реальном мире — что это на самом деле означает? Мы пытаемся это понять, но это никогда не бывает совсем правильно.

Конечно, это не относится к сегодняшним системам, которые учатся непосредственно на данных. В каком-то смысле они формировали эту связь с самого начала. Но интересно то, что если вы просто изучаете язык, теоретически вам должно не хватать значительной части необходимой основы. Оказывается, многое из этого можно предположить.

Ханна Фрай: Почему теоретический?

Демис Хассабис: Откуда такое заземление? Эти системы, по крайней мере первые крупные языковые модели, раньше в реальном мире не существовали. Они не подключены к эмулятору, не подключены к боту, у них даже нет доступа к интернету. Они также не являются мультимодальными, у них нет визуальных способностей или чего-то еще, они просто живут исключительно в языковом пространстве, абстрактной сфере, поэтому довольно удивительно, что они могут сделать какие-то выводы о реальном мире из этих вещей.

Ханна Фрай: Если люди вовлекаются, взаимодействуют с системой и ясно говорят: «Это бредовый ответ», «Это хороший ответ», это может обеспечить восприятие.

Демис Хассабис: Точно, поэтому, конечно, если они пойдут не так, отчасти это связано с отсутствием обоснования в ранних версиях. Например, если вы спросите собаку, как лаять, а она ответит неправильно, то вы поправите ее, если дадите обратную связь. Часть обратной связи исходит из наших собственных знаний, которые постепенно проникают в модель.

Ханна Фрай: Я помню, что видела действительно хороший пример: «пересечь Ла-Манш» вместо «пройти через Ла-Манш».

Демис Хассабис: Да, это такая вещь: если он отвечает неправильно, вы даете ему обратную связь, что он неправильный, а затем он должен это понять, вы не можете пересечь Ла-Манш пешком.

Ханна Фрай: Я как бы хочу спросить: как вы думаете, на той стадии, на которой мы сейчас находимся, вещи переоценены или недооценены? Или это пропагандируется не в том направлении?

Демис Хассабис: Я думаю, что скорее последнее. Я бы сказал, что в краткосрочной перспективе это было переоценено. Есть заявления о том, что они могут сделать все, что невозможно; за ними гонятся всевозможные стартапы и венчурный капитал, но они еще не готовы. С другой стороны, я думаю, что это все еще недооценено, мне все еще не кажется, что люди полностью понимают, что произойдет, когда мы доберемся до ОИИ и после ОИИ. Это было бы очень важно, так что поймите и эту ответственность. Итак, оба варианта немного преувеличены, и я думаю, что мы переживаем такой цикл.

Ханна Фрай: По сравнению со всеми этими потенциальными стартапами и венчурным капиталом, вы (команда) десятилетиями живете и дышите исследованиями в области искусственного интеллекта и находитесь в хорошей позиции, чтобы определить, какие из них являются реалистичными целями, а какие нет. Но как же другим отличить, что реально, а что нет?

Демис Хассабис: Я думаю, очевидно, что вам необходимо проявить должную осмотрительность на техническом уровне и иметь некоторое представление о технологиях и последних тенденциях. Я думаю, это также зависит от говорящего, его опыта и технических знаний. Они только в прошлом году начали интересоваться ИИ? До прошлого года занимались криптовалютой? Это могут быть какие-то подсказки.

Когда место внезапно привлекает внимание и вместе с ним приходят деньги, все переживают, что что-то упускают. Это создает оппортунистическую среду, которая в некотором роде противоречит тем из нас, кто десятилетиями работал глубоко техническим и глубоко научным образом.

Ханна Фрай: Да, одна из наших главных тем — Близнецы, и она основана на очень глубоком научном подходе. Чем Gemini отличается от других крупных языковых моделей, выпущенных другими лабораториями?

Демис Хассабис: С самого начала мы хотели, чтобы Gemini была мультимодальной. Он может обрабатывать не только язык, но и аудио, видео, изображения, код — что угодно. Причина, по которой мы хотим это сделать, заключается, прежде всего, в том, что мы думаем, что таким образом эти системы смогут по-настоящему понять мир вокруг себя и построить лучшие модели мира. На самом деле это возвращается к теме, о которой мы только что говорили: мы все еще создаем основу, но на этот раз речь идет о языке.

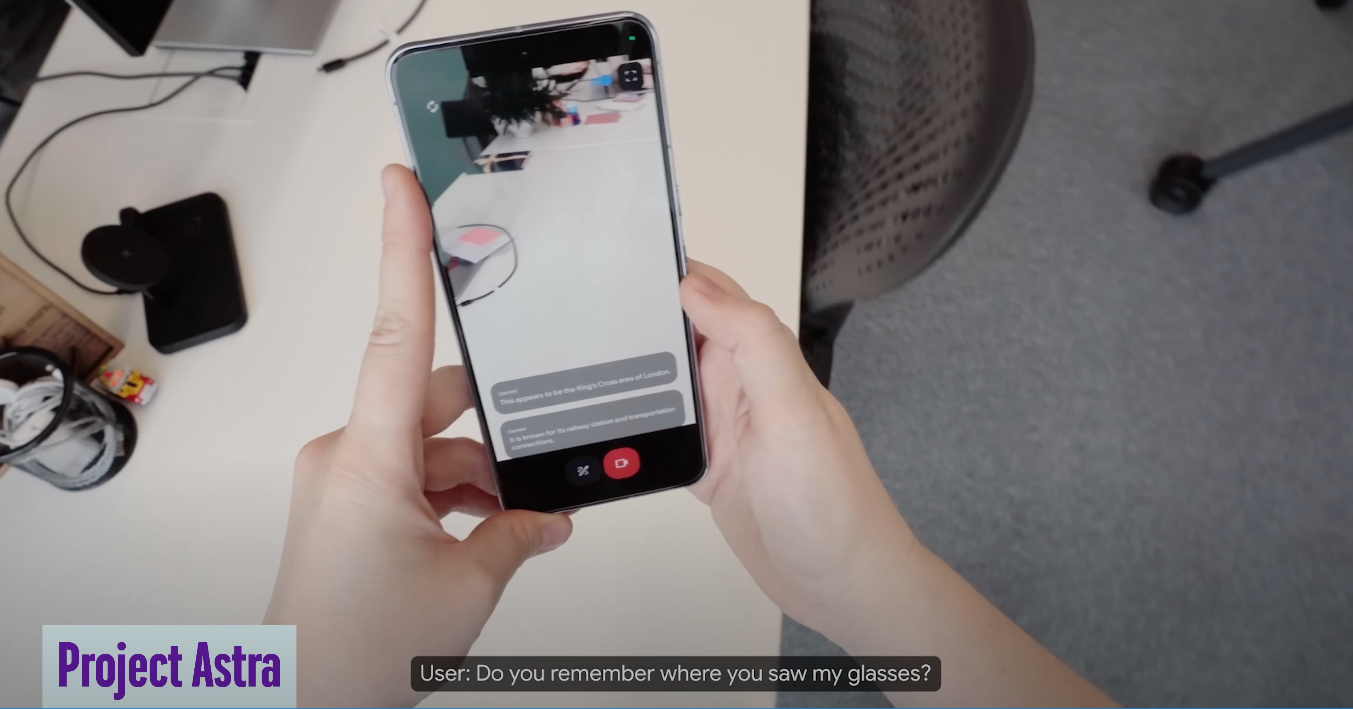

А потом у нас возникла идея универсального помощника, и мы создали прототип чего-то под названием Astra, о котором, я думаю, мы еще поговорим, который понимает не только то, что вы печатаете, но и среду, в которой вы находитесь.

Если представить себе личного помощника или цифрового помощника, то чем больше контекста он понимает, тем полезнее будет помощь, которую он сможет оказать. Мы всегда думали, что такая система будет более полезной. Поэтому мы с самого начала заложили мультимодальность. Это один из аспектов — мультимодальность по своей сути. И на тот момент это была единственная модель, которая могла это сделать. Теперь другие модели пытаются догнать

Кроме того, у нас также есть некоторые большие инновации в памяти, такие как длинный контекст, который теперь может запоминать один миллион или два миллиона токенов, и вы можете думать о них примерно так же, как о запоминании одного миллиона или двухсот тысяч слов. Вы можете подарить ему такое произведение, как «Война и мир», или даже, благодаря мультимодальности, теперь вы можете подарить ему целое видео, целый фильм или лекцию, и заставить его отвечать на вопросы или находить в видеопотоке нужный вам контент.

Ханна Фрай: Я помню, вы привели пример того, как Астра помогает вам вспомнить, куда вы положили свои очки. Но мне интересно, как развиваются эти технологии. Это просто усовершенствованная версия старых Google Glasses?

Демис Хассабис: Конечно, Google имеет долгую историю разработки устройств наподобие Glass, начавшуюся примерно с 2012 года. Таким образом, они далеко впереди в этой области, но чего, вероятно, не хватает, так это технологии, которую представляет Astra. С помощью этой технологии вы сможете по-настоящему понять интеллектуального агента или интеллектуального помощника, который понимает то, что видит. Мы в восторге от цифровых помощников, которые могут сопровождать вас и понимать мир вокруг вас. Когда вы его используете, это кажется очень естественным использованием.

Ханна Фрай: Хорошо, я хочу немного вернуться к истокам Gemini. Это произошло из двух разных отделов, верно.

Демис Хассабис: Да, в прошлом году мы фактически объединили два исследовательских отдела Alphabet. Другими словами, объединение оригинального DeepMind и Google Brain в суперотдел, объединяющее все лучшие таланты в нашей компании и во всем Google и объединяющее лучшие знания во всех исследованиях, особенно в аспекте языковых моделей. У нас есть такие проекты, как Chinchilla и Gopher, в которых были созданы ранние модели языка, такие как Palm и Lambda, каждая из которых имеет свои сильные и слабые стороны. Мы собрали их всех вместе, чтобы сформировать Gemini, первый проект маяка, запущенный объединенной командой. Еще одна важная вещь заключается в том, что мы также объединяем все вычислительные ресурсы для проведения действительно масштабного обучения и централизации вычислительных ресурсов. Так что я думаю, что это действительно круто.

Ханна Фрай: Я думаю, что Google Brain и DeepMind во многом различны, не так ли?

Демис Хассабис: Действительно. Я думаю, что оба сосредоточены на передовых технологиях искусственного интеллекта, и, хотя на уровне отдельных исследователей уже ведется активное сотрудничество, возможно, не так много на стратегическом уровне. Теперь, после слияния, я называю Google DeepMind «машинным отделением» Google. На самом деле в том, как мы работаем, больше сходства, чем различий. Мы продолжаем сохранять и удваивать наши сильные стороны в области фундаментальных исследований. Например, откуда появится архитектура Transformer следующего поколения? Мы хотим изобрести это. Очевидно, Google Brain изобрел архитектуру предыдущего поколения, и мы объединили ее с придуманным нами методом глубокого обучения с подкреплением. Я по-прежнему считаю, что в будущем необходимо больше инноваций, и я верю, что мы сможем это сделать, как мы делали в течение последних 10 лет, и это очень интересно.

Ханна Фрай: Итак, вернемся к самому Gemini: насколько он хорош по сравнению с другими моделями?

Демис Хассабис: Я думаю, что есть некоторые тесты [которые говорят о его возможностях], но это не проблема, проблема в том, что вся эта область нуждается в более качественных тестах. Существуют некоторые известные академические тесты, но они сейчас немного перенасыщены и не могут по-настоящему различить тонкие различия между различными топ-моделями. Я бы сказал, что сейчас на переднем крае находятся три модели: наш Gemini, GPT от OpenAI и Claude от Anthropic. Конечно, есть и другие хорошие модели, например разработки «Мета», «Мистраль» и других компаний, которые имеют свои сильные стороны в разных областях. Например, в зависимости от ваших потребностей Claude может быть лучше для кодирования, GPT может быть лучше для рассуждений, а с точки зрения обработки памяти, длинного контекста и мультимодального понимания это Gemini. Конечно, мы все постоянно совершенствуем наши модели. Итак, учитывая, что Близнецам всего год, я думаю, что мы на очень хорошем пути. В следующий раз, когда мы будем говорить на эту тему, надеюсь, мы будем в первых рядах, потому что так и есть.

Ханна Фрай: Кажется, нам еще предстоит пройти долгий путь. Я имею в виду, что есть еще некоторые вещи, в которых эти модели не очень хороши.

Демис Хассабис: Да, определенно. На самом деле, это сейчас большая дискуссия. Итак, этот последний набор вещей, похоже, возник из технологии, изобретенной 5 или 6 лет назад. Проблема в том, что им все еще не хватает тонны вещей. Итак, они, на самом деле, вы знаете, производят то, что мы знаем как галлюцинации. Они также не очень хороши в планировании.

Ханна Фрай: Какой смысл они планируют? Я имею в виду.

Демис Хассабис: Да, именно об этом сейчас идет дискуссия. Эта недавняя серия разработок на самом деле основана на технологии, изобретенной 5 или 6 лет назад. Проблема, однако, в том, что им все еще многого не хватает. Например, есть проблемы с их фактической точностью, и мы знаем, что они могут галлюцинировать. Кроме того, они недостаточно хороши в планировании.

Ханна Фрай: Что именно означает «планирование»?

Демис Хассабис: Например, с точки зрения долгосрочного планирования вы ставите ему цель, а они пока не могут выполнять за вас операции в реальном мире. Так что это по-прежнему очень пассивные системы вопросов и ответов. Вам нужно активировать их, задавая вопросы, а затем они дают какой-то ответ, но по-настоящему решить проблему за вас они не могут.

Если вы хотите, чтобы это был цифровой помощник, вы можете сказать: «Забронируйте мне поездку в Италию и организуйте все рестораны, музеи и т. д.». Даже если бы он знал ваши предпочтения, он не смог бы их забронировать. Билеты и решение этих вопросов. Так что в настоящее время он не может этого сделать.

Но я думаю, что это следующая эра – те системы, которые имеют более агентное поведение, то, что мы бы назвали агентными системами или системами, которые обладают способностью действовать как агенты. Это то, в чем мы преуспеваем. Это то, что мы сделали со всеми нашими игровыми агентами, AlphaGo и другими проектами, о которых мы говорили в прошлом. Мы совмещаем эти престижные работы с новыми масштабными мультимодальными моделями. Я думаю, именно сюда пойдет следующее поколение систем. Вы можете думать об этом как о сочетании AlphaGo с Gemini.

Ханна Фрай: Да, я думаю, что AlphaGo уже очень хороша.

Демис Хассабис: Да, он очень хорош в планировании, только в игровом мире, конечно. Поэтому нам необходимо интегрировать его в общие области, такие как повседневная работа и язык.

Ханна Фрай: Вы только что упомянули, что Google DeepMind теперь является машинным отделением Google. Это довольно большое изменение. Несколько лет назад я также спросила, идет ли Google на серьезную авантюру?

Демис Хассабис: Да, я так думаю. Я думаю, что Google всегда понимал важность искусственного интеллекта. Когда он занял пост генерального директора, Сундар сказал, что Google — это компания, ориентированная прежде всего на искусственный интеллект. Мы обсуждали этот вопрос в начале его пребывания в должности. Он видел потенциал искусственного интеллекта как следующего большого изменения парадигмы после мобильного Интернета, даже большего. Но я думаю, что за последние год или два мы действительно начали соответствовать этой философии не только с точки зрения исследований, но также с точки зрения продукта и других аспектов. Это очень интересно, и я думаю, что это правильный выбор для нас: скоординировать работу всех талантов и сделать все возможное, чтобы двигаться вперед.

Ханна Фрай: А как насчет наоборот? Потому что я думаю, с точки зрения DeepMind, с его мощными исследовательскими возможностями, означает ли это, что теперь он стал «машинным отделением» Google и что вы должны уделять больше внимания коммерческим интересам, а не чисто научным исследованиям?

Демис Хассабис: Нам действительно нужно уделять больше внимания интересам бизнеса, что сейчас является одной из обязанностей. Однако есть о чем поговорить.

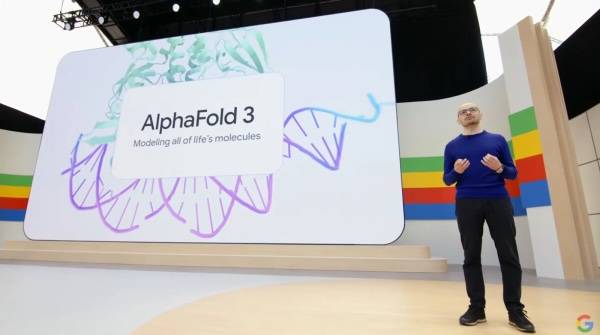

Прежде всего, мы все еще продолжаем наши научные исследования, например, недавно был выпущен AlphaFold 3, и мы удваиваем наши инвестиции в эту область. Я думаю, что это уникальная особенность Google DeepMind. Даже наши конкуренты считают это «универсальным богатством», приносимым ИИ. Прогресс на этих фронтах идет очень хорошо. Мы также расширили Isomorphic для открытия лекарств, что очень интересно. Мы продолжим продвигать эти усилия.

Помимо создания больших моделей, Gemini и т. д., мы также создаем команду разработчиков, которая сможет внедрить все эти удивительные технологии на различные платформы Google. Это невероятная привилегия: то, что мы изобретаем, может оказать немедленное влияние на миллиарды людей, и это действительно мотивирует.

Фактически, сейчас наблюдается большее сближение между разработкой технологий искусственного интеллекта для использования в продуктах и технологиями, необходимыми для чистого исследования искусственного интеллекта. Пять лет назад вам, возможно, пришлось создать специальный ИИ для продукта. Еще предстоит проделать некоторую работу над конкретным продуктом, но, возможно, это только 10% усилий. Итак, теперь, когда противоречия между разработкой продуктов ИИ и созданием AGI ушли, я бы сказал, что 90% плана исследований остается прежним.

Наконец, конечно, если вы запустите продукт и начнете применять его на практике, вы многому от него научитесь. Использование пользователем может выявить многое, что не совсем соответствует вашему внутреннему суждению, поэтому вы можете обновить и улучшить исследование, что очень полезно.

Ханна Фрай: Полностью согласна. В этом подкасте мы больше поговорим о прорывах, достигнутых благодаря применению ИИ в науке. Но я хочу задать вопрос о том, когда результаты будут обнародованы. В DeepMind эти инструменты, как и большие языковые модели, используются больше для исследований, чем рассматриваются как потенциальные коммерческие продукты, верно.

Демис Хассабис: Да, именно. Мы всегда очень серьезно относились к ответственности и безопасности, с первых дней нашей работы в 2010 году, и Google включил некоторые из наших этических норм в свои принципы искусственного интеллекта. Таким образом, мы очень близки к Google как к одному из лидеров в этой области и стремимся ответственно подходить к внедрению технологий.

Сейчас действительно интересно начать выводить на рынок продукты с генеративным ИИ. Мы быстро учимся, и это хорошо, поскольку технология все еще находится на стадии относительно низкого риска. Поскольку технологии становятся все более мощными, нам нужно быть более осторожными. Научиться тестировать генеративные технологии искусственного интеллекта важно для продуктовых команд. Это отличается от тестирования обычных технологий, поскольку генеративный ИИ не обязательно всегда делает одно и то же. Это почти похоже на тестирование игры с открытым миром, и возможности, которые вы можете попробовать, практически безграничны. Итак, как проводить красную команду, становится очень интересно.

Ханна Фрай: В данном случае красная команда соревнуется с вами?

Демис Хассабис: Да, красная команда — это создание независимой от команды разработчиков команды, которая будет проводить стресс-тестирование и пытаться всеми возможными способами взломать технологию. На самом деле вам нужны инструменты для автоматизации этих тестов, потому что даже если в вас участвуют десятки тысяч людей, это все равно не сравнится с фактическим использованием миллиардов пользователей. Когда технология будет выпущена, пользователи будут пробовать самые разные вещи. Поэтому было интересно применить эти знания для улучшения наших процессов, чтобы будущие выпуски проходили как можно более гладко. Нам нужно делать это поэтапно, начиная с экспериментальной фазы, затем закрытого бета-тестирования, а затем постепенного выпуска, как мы делали с предыдущими выпусками игр. Изучайте каждый шаг пути.

Кроме того, нам также следует больше использовать сам ИИ, который поможет нам проводить тестирование красной командой, автоматически обнаруживать некоторые ошибки или выполнять предварительную классификацию, чтобы наши разработчики и тестировщики могли сосредоточиться на решении этих сложных ситуаций.

Ханна Фрай: Одна из вещей, которая действительно интересна, это то, что вы сейчас находитесь в более неопределенном пространстве. Если вероятность того, что что-то произойдет, очень мала, но если вы попытаетесь сделать это достаточное количество раз, в конечном итоге что-то пойдет не так. Я думаю, что, возможно, было несколько ошибок, получивших огласку.

Демис Хассабис: Да, именно поэтому я упомянул, что продуктовые команды адаптируются к этому подходу к тестированию. Хотя они и тестировали эти системы, они по своей сути были случайными и неопределенными. Итак, во многих случаях, если это обычное программное обеспечение, вы можете сказать, что я протестировал 99,99% случаев, а затем сделать вывод, что этого достаточно. Но это не относится к этим генеративным системам, которые могут реагировать самыми неожиданными, неожиданными и невиданными ранее способами.

Это может быть сложно, если кто-то умный или враждебный, например хакер, решит протестировать и расширить его возможности. Из-за случайности системы генерации, даже если в ней есть все, что вы сказали ей раньше, они могут находиться в каком-то особом состоянии, или их память заполнена какой-то специфической информацией, поэтому ее вывод будет ненормальным. Так что здесь действительно много сложностей, но они не бесконечны. Хотя существуют способы справиться с такими ситуациями, они гораздо более сложны и содержат множество нюансов, чем традиционные технологические выпуски.

Ханна Фрай: Я помню, как вы говорили, что нам нужно думать об этом как о совершенно другом способе вычислений: от детерминированных вычислений, которые мы полностью понимаем, к более запутанному, вероятностному и полному ошибок способу вычислений. Считаете ли вы, что обществу необходимо немного изменить свое представление о типах вычислений, которыми мы занимаемся?

Демис Хассабис: Я думаю, да. Возможно, прежде чем мы выпустим что-то, мы можем рассмотреть возможность публикации основного документа или чего-то подобного, чтобы прояснить, каковы ожидания от системы, какова цель разработки, каковы применимые сценарии и какие задачи не могут быть выполнены. много смысла. Нам нужно обучать пользователей, например, в некоторых случаях вы можете использовать это таким образом, но не пробуйте другие вещи, потому что это может не сработать. Я думаю, что это та область, где нам нужно добиться большего, а пользователи должны быть более опытными. На самом деле это довольно интересно.

Возможно, именно поэтому чат-боты появились совершенно неожиданно. Даже ChatGPT удивил OpenAI. У нас есть собственный чат-бот, как и у Google. Глядя на них, я также заметил, что они все еще имеют много недостатков и страдают от ошибок, иллюзий и многих других проблем. Но мы не осознавали, что даже в этом случае существует множество очень хороших вариантов использования чат-ботов, которые люди находят очень ценными, например, обобщение документов, написание электронных писем, заполнение форм и т. д. В этих сценариях использования люди не возражают, даже если есть небольшие ошибки, поскольку их можно легко исправить и сэкономить много времени. Вот какой сюрприз обнаруживают люди, отдавая эти технологии в руки масс. Несмотря на многие известные недостатки этих систем, у них все еще есть ценные варианты использования.

Ханна Фрай: Итак, следующий вопрос, который я хочу задать, касается открытого исходного кода. Потому что, как вы упомянули, когда технологии находятся в руках масс, происходят действительно удивительные вещи. Я знаю, что в прошлом DeepMind открывала исходный код многих исследовательских проектов, но такое ощущение, что со временем ситуация изменилась.

Демис Хассабис: Мы всегда очень поддерживали открытый исходный код и открытую науку. Как вы знаете, мы открываем исходный код и публикуем почти все наши исследовательские проекты, включая такие проекты, как Transformer и AlphaGo, которые мы публикуем в журналах Nature и Science. AlphaFold также имеет открытый исходный код, как мы обсуждали в прошлый раз.

Действительно, обмен информацией — это способ быстрого развития технологий и науки, поэтому мы почти всегда думаем, что это полезно. Это общий путь развития науки. Единственное исключение — когда речь идет о мощном искусственном интеллекте или искусственном интеллекте, где мы сталкиваемся с проблемой технологий двойного назначения.

Итак, вопрос в том, что вы хотите поддержать все хорошие варианты использования и этих ученых, технологов с благими намерениями и поощрять их развивать эти идеи, критиковать их и т. д. Это самый быстрый путь развития общества. Однако проблема заключается в том, как одновременно ограничить доступ злоумышленников, которые могут использовать эти системы в нежелательных целях, использовать их не по назначению или превратить в системы вооружения и т. д.

Эти общие системы действительно могут быть использованы таким образом и другими способами. Не помешало бы сделать это сегодня, потому что я не думаю, что нынешняя система достаточно надежна. Но через два или три года, особенно когда вы начнете получать удовольствие от автоматизированных систем агентов или поведения агентов, если эти системы будут злоупотреблять некоторыми людьми или даже некоторыми мошенниками, это может нанести серьезный вред. Поэтому я думаю, что нам всем коллективом нужно подумать о том, что это значит для открытого исходного кода.

Возможно, передовые модели нуждаются в дополнительной проверке, возможно, через год или два после их выпуска, прежде чем они станут открытыми. Это модель, которой мы сейчас следуем, потому что у нас есть собственные модели с открытым исходным кодом, такие как Gemma, которые меньше по размеру и не являются передовыми моделями. Хотя их возможности на текущем этапе хорошо изучены, они по-прежнему очень полезны для разработчиков, поскольку их можно легко запускать и на ноутбуках. Подводя итог, можно сказать, что возможности этих моделей по-прежнему ценны, но не так мощны, как у последних передовых моделей (таких как модель Gemini 1.5). Поэтому я думаю, что мы, вероятно, в конечном итоге примем этот подход, при котором у нас будут модели с открытым исходным кодом, но они будут отставать от самых современных моделей примерно на год, чтобы мы могли действительно оценить, как эти модели работают. в открытой среде.

Ханна Фрай: Новейшие и самые передовые возможности моделей действительно могут раздвинуть границы.

Демис Хассабис: Мы можем посмотреть на возможности и границы этих моделей. Проблема с открытым исходным кодом в том, что если что-то пойдет не так, вы не сможете это исправить. Благодаря проприетарной модели вы можете отключить доступ, если злоумышленники начнут использовать ее ненадлежащим образом. В крайнем случае, можно отключить его совсем. Но как только вы откроете исходный код чего-либо, вы не сможете вернуть это обратно. Это дверь с односторонним движением, поэтому при использовании открытого исходного кода следует быть очень осторожным.

Ханна Фрай: Итак, возможно ли контролировать AGI в рамках организации?

Демис Хассабис: Пока не знаю, как это сделать. Особенно, когда речь идет о мощном искусственном интеллекте на уровне AGI, который аналогичен ИИ уровню человека.

Ханна Фрай: Как институты вписываются в идеальную экосистему, которую вы описываете? Если мы достигнем стадии, когда ОИИ будет поддерживать все научные исследования, сохранят ли традиционные институты ценность?

Демис Хассабис: Я думаю, что институты по-прежнему имеют значение. Прежде чем достичь AGI, необходимо наладить сотрудничество между гражданским обществом, научными кругами, правительством и промышленными лабораториями. Я искренне верю, что это единственный способ добраться до этой стадии.

Ханна Фрай: Ученый-компьютерщик Стюарт Рассел однажды сказал мне, что он немного обеспокоен тем, что, как только мы достигнем AGI, может возникнуть ситуация, когда мы все будем подобны принцам старины — люди, которым не нужно входить в систему. Люди, которые сидят. восседайте на троне и не занимайтесь никакой работой, просто живите жизнью в безудержной роскоши без каких-либо целей.

Демис Хассабис: Да, это интересный вопрос. Может быть, это не просто ОИИ, а скорее Искусственный Суперинтеллект (Искусственный Суперинтеллект) или какое-то другое понятие, иногда люди называют его ИСИ (Искусственный Суперинтеллект). В этом случае мы можем испытать фундаментальное состояние изобилия, в котором мы сможем иметь больше свободы в том, что мы решаем делать, пока мы обеспечиваем справедливое и рациональное распределение ресурсов.

Смысл, таким образом, становится большим философским вопросом. Я думаю, нам понадобятся философы, даже богословы и социологи, чтобы начать думать об этом. Что приносит смысл? Я по-прежнему считаю, что самореализация важна. Я не думаю, что мы все будем просто сидеть и медитировать, может быть, играть в компьютерные игры, кто знает? Но так ли это плохо? Возможно, нам также необходимо дать новое определение тому, что такое «хорошая» жизнь.

Ханна Фрай: Я думаю, что принцы былых дней не почувствовали бы ничего плохого.

Демис Хассабис: Если вы посмотрите на тех, кто занимается экстремальными видами спорта, такими как восхождение на Эверест, то все они бросают вызов человеческим пределам. Мотивы этой деятельности могут быть связаны со стремлением к смыслу и самореализации. Как вы упомянули, хотя эти вопросы, возможно, еще не обсуждаются подробно, они существенно изменят наш мир.

Несмотря на то, что самые передовые технологии привели к большим изменениям, таким как лечение болезней, решение энергетических проблем, реагирование на изменение климата и т. д., мы все еще сталкиваемся с глубоко укоренившейся проблемой «смысла». Этот поиск смысла осуществляется не только на техническом уровне, но также затрагивает философию, психологию и даже культурный уровень. Нам нужно подумать о том, как человеческое существование и поведение будут пересмотрены в условиях будущего технологического бума.

# Добро пожаловать на официальную общедоступную учетную запись WeChat aifaner: aifaner (идентификатор WeChat: ifanr). Более интересный контент будет предоставлен вам как можно скорее.

Ай Фанер | Исходная ссылка · Посмотреть комментарии · Sina Weibo