Фотография чуть не уничтожила отца, и технологическим компаниям очень “больно” творить зло во имя доброй воли

Во время разговора на работе к Марку неожиданно подошла полиция.

Марка подозревали в сексуальных преступлениях против детей, потому что в его телефоне была обнаружена фотография половых органов ребенка. И полиция установила, что это фото на самом деле принадлежит сыну Марка…

Вероятно, в вашем сознании начинает формироваться извращенный образ педофила.

Не спешите злиться, все быстро изменилось. Выяснилось, что это фото было сделано уже после того, как заболел сын Марка, чтобы сообщить врачу о своем состоянии, и Марк никогда не публиковал это фото публично.

Так как же полиция узнала, что именно система искусственного интеллекта Google обнаружила фотографии на телефоне Марка с Android, идентифицировала его как подозреваемого в совершении преступления, сообщила об этом в полицию и отключила его учетную запись Google.

В Соединенных Штатах популярность семейного сегмента Google примерно эквивалентна WeChat, а это означает, что операция Google напрямую убивает Марка из онлайна в оффлайн.

Что еще более пугает, так это то, что, как и Марк, существует гораздо больше, чем один человек, который был обнаружен платформой как аномалия и о котором, кстати, было сообщено.

Фотографии онлайн-консультации ребенка привели к тому, что его идентифицировали как преступника

У ребенка Марка развилось воспаление паха, когда он учился ходить. Из-за тяжелой эпидемии большинство людей в то время находились на домашнем карантине.Марку оставалось только выбрать онлайн-консультацию и предоставить снимки паха ребенка, пытаясь помочь врачу поставить более точный диагноз.Врач также прописал заболевание на основании описанного Состояние и фотографии показаны по рецепту.

Но с этими фотографиями есть проблема: фотографии в телефоне Android автоматически синхронизируются с облаком, и система Google распознает эти фотографии как CSAM (материал о сексуальном насилии над детьми).

После того, как его идентифицировали, использование Интернета Марком сократилось вдвое, потому что он был заблокирован. Gmail, почтовый ящик учетной записи, который пользователи используют для входа на другие платформы; Google Fi, мобильный виртуальный оператор пользователя, который можно использовать для совершения звонков и работы в Интернете; Google Фото, к которым больше нельзя получить доступ, содержит фотографии ваших члены семьи… Опечатаны. Поскольку Google считает, что вы подозреваетесь в преступлениях на сексуальной почве в отношении детей, он заблокировал вашу учетную запись и вызвал полицию «для вас». изучение.

Десять месяцев спустя отец был уведомлен полицейским управлением Сан-Франциско, которое провело полное расследование на основе фотоотчета, предоставленного Google.

Чтобы лучше расследовать потенциальных сексуальных преступников, полиция также выдала Google ордер на обыск всей информации об учетной записи Марка, видео, фотографий, данных о местоположении, отчетов о поиске в Интернете и многого другого. Для Марка это действительно катастрофа, и если бы полицейское расследование было более фанатичным, я боюсь, что даже работа не будет сделана.

К счастью, после тщательного расследования полиция подтвердила, что никаких сексуальных преступлений против детей у отца не было.

Отец невиновен, но Google непреклонен. Даже предоставление подтвержденного полицией отчета о невиновности не позволило ему успешно обратиться в Google с просьбой вернуть свою учетную запись. Информация о фотографии, которую он когда-то оставил в своем аккаунте, была полностью заблокирована и больше не может быть просмотрена. Все, что я вижу, это напоминания Google.

Ваша учетная запись была отключена из-за содержания вредоносного контента, который серьезно нарушает политику Google и может быть незаконным.

Подавать заявку на разблокировку бесполезно, можно только изменить адрес электронной почты, изменить номер телефона и начать с нуля в цифровом мире. The New York Times сообщила о двух обычных пользователях, которые фотографировали половые органы детей для онлайн-консультаций своих детей и были приговорены к незаконным аккаунтам, до сегодняшнего дня они не смогли восстановить свои аккаунты.

Они даже не являются исключительными. В 2021 году Google сообщил о 621 583 случаях в CyberTipLine NCMEC (Проект сообщения о сексуальном насилии над детьми). NCMEC уведомил местные правоохранительные органы о 4260 потенциальных жертвах, попросив полицию помочь в расследовании и спасти детей, если им будет причинен дальнейший вред.

Это звучит как хорошая история о технологиях, позволяющих вовремя остановить и предотвратить преступление, но когда в этот список входят несовершеннолетние, которые просто просят о консультации, как дети Марка, это грустная история о том, как «поймать тысячу и поймать одного по ошибке».

Из всех областей технического расследования единственным исключением являются преступления на сексуальной почве в отношении детей.

Просто ошибка хоть и есть, но Гугл явно не собирается ее менять. Он не только не разблокирует подтвержденные полицией учетные записи невиновных пользователей, но и не намерен останавливать этот несовершенный механизм цензуры.

Представитель Google Криста Малдун сказала: «Мы следуем законам США, чтобы определить, что такое CSAM, и используем комбинацию технологии сопоставления хэшей и искусственного интеллекта, чтобы идентифицировать его и удалить с нашей платформы. Наша команда экспертов по безопасности детей рассмотрит его. Контент помечен как точный, и мы консультируемся с педиатрами, чтобы мы могли определить ситуации, в которых пользователи могут обратиться за медицинской помощью».

Проблема в том, что группа проверки Google не имеет медицинского образования и не обязательно консультируется со специализированным педиатром при рассмотрении каждого случая. Таким образом, можно сказать, что в этом процессе неизбежны ошибочные суждения, единственное, что может уменьшить влияние таких неверных суждений, – это суждения профессиональных институтов и вторичная проверка правоохранительных органов.

Но для тех, кто был недооценен, это действительно катастрофа. Из-за этого неправильного суждения ваш важный аккаунт был заблокирован, из-за этого неправильного суждения вас расследовала полиция, из-за этих ошибочных суждений люди вокруг вас также могут носить затемненные очки, когда видят вас.

Джон Каллас, директор технологических программ Electronic Frontier Foundation EFF, заявил СМИ, что подход Google был навязчивым. «Это кошмар, которого мы все боимся — они собираются отсканировать наши семейные альбомы, и у нас будут проблемы».

Но это проблема не только Google, поскольку почти все технологические гиганты проявляют необычайную агрессивность, когда дело доходит до контента CSAM. Как Facebook и Google, Amazon имеет механизм проверки искусственного интеллекта + человека.Обнаружено, что подозрительные пользователи удаляют или отключают URL-адреса, изображения и функции чата по мере необходимости, а также строго блокируют учетные записи. В 2021 году Amazon также представила в NCMEC 33 848 отчетов CSAM . Что касается конфиденциальности, то в этой криминальной истории о борьбе с технологиями она, похоже, игнорируется.

Среди историй в защиту конфиденциальности пользователей наиболее впечатляющим является отказ Apple «помочь разблокировать».

В то время в США произошел серьезный теракт со стрельбой в благотворительном учреждении, и убийца был убит при бегстве. В ходе расследования полиция установила, что убийца общался с экстремистской группировкой «Исламское государство» на Ближнем Востоке посредством зашифрованной связи по мобильному телефону, но, поскольку на мобильном телефоне был пароль, суд мог только попросить производителя iPhone Apple помочь правительству разблокировать его. Но Apple публично заявила о своем отказе выполнять приказ, сославшись на защиту конфиденциальности пользователей: «Если правительство использует Закон о всех судебных приказах, чтобы упростить разблокировку iPhone, оно имеет возможность взломать чье-либо устройство и получить их данные. и правительство будет продолжать это вторжение в частную жизнь».

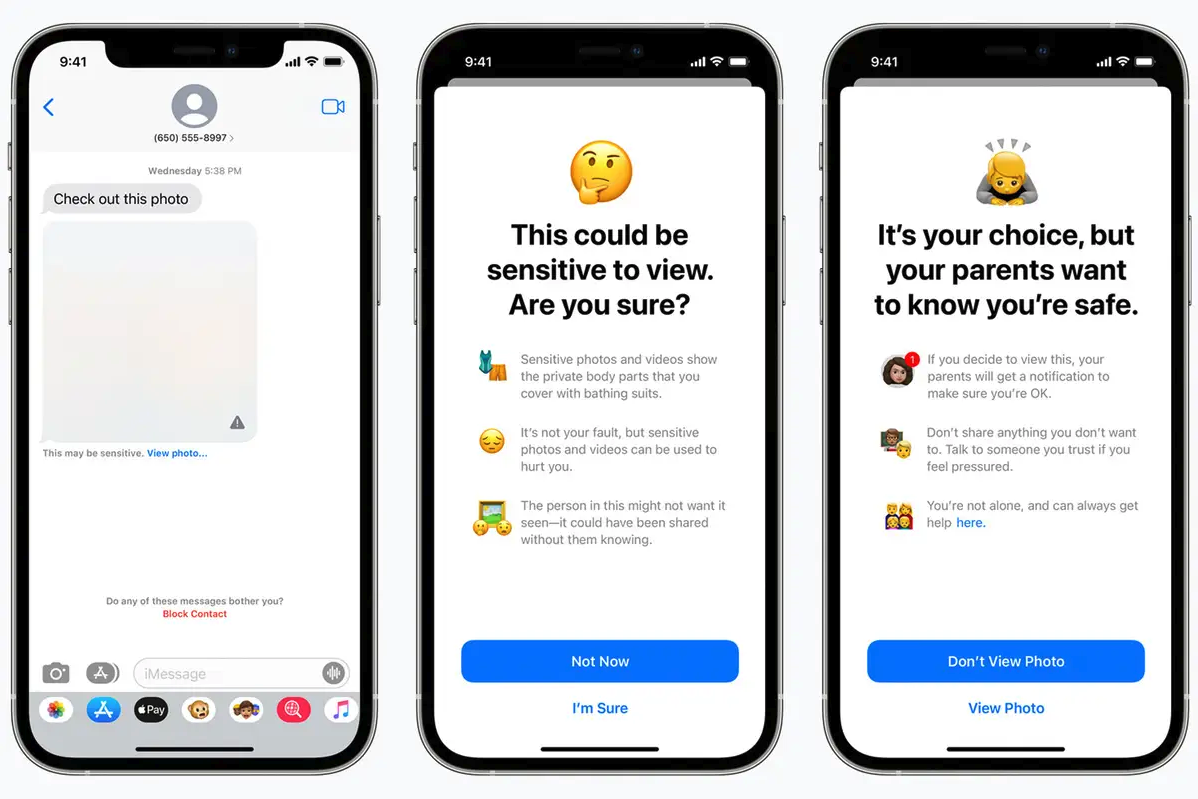

Но даже Apple, которая справедливо отказалась разблокировать айфоны пользователей, не поколеблена в области преступлений на сексуальной почве в отношении детей. Как и Google, Apple задумалась об использовании нового инструмента для сканирования фотографий пользователя iCloud, который бы соответствовал существующей базе данных изображений NCMEC, и, если бы было найдено достаточно похожих изображений, оно было бы передано оператору для проверки, что затем уведомить NCMEC.

В то время Apple также планировала представить новую функцию iMessage, предназначенную для «оповещения детей и их родителей, когда [дети] получают или отправляют фотографии откровенно сексуального характера». Дети в возрасте до 13 лет, получающие или отправляющие изображения, будут предупреждать родителей, и все дети-пользователи также получат предупреждение, когда они собираются получить или отправить подозреваемые порнографические изображения.

Вскоре после этого эта тенденция к изменениям была остановлена, потому что оппозиция была слишком громкой. EFF считает, что новое изменение может «открыть черный ход в вашу личную жизнь… меньше, а не лучше конфиденциальность для всех пользователей iCloud Photos». , Отсканируй что-нибудь завтра."

В конечном итоге Apple отложила часть сканирования изображений, но сохранила дополнительную функцию включения детских учетных записей в план «Семейный доступ». Родители могут выборочно включать для своих детей функцию анализа картинок на обнаженное изображение, и если обнаженное изображение будет обнаружено, оно будет размыто.

Даже Apple хочет добавить распознавание CSAM в свои продукты, во многом потому, что это красная черта — будь то для обычных пользователей, правоохранительных органов или платформ, у них крайне низкая терпимость к этому вопросу.

Это также означает, что, когда вам действительно понадобится техническое сотрудничество технологических компаний, решение сначала сотрудничать с делами о преступлениях на сексуальной почве против детей получит большую общественную поддержку.

Обновление британского Закона о безопасности в Интернете предполагает, что поставщики услуг, предоставляющие услуги между пользователями, должны стремиться сообщать Национальному агентству по борьбе с преступностью о любом распространенном контенте, связанном с сексуальной эксплуатацией и насилием над детьми. Законодательная поправка четко указывает, что предприятия должны разрабатывать программное обеспечение, которое может проверять информацию, в том числе сквозные зашифрованные звонки, для упреждающего обнаружения материалов о преступлениях на сексуальной почве в отношении детей и сообщения об этом властям — или столкнуться с санкциями.

Просто история Google говорит нам о том, что даже если эта функция будет работать без сбоев, существует риск «убийства по ошибке», и каждое ошибочное ранение нанесет вред невиновным пользователям. Технологии могут не решить все проблемы.Привычные нам искусственный интеллект и алгоритмы все еще слишком «просты» перед лицом сложных социальных проблем, и трудно полагаться на одну технологию для выявления потенциальных или уже существующих преступлений. .

Вмешательство технологий может даже создать новые проблемы в изначально сложной среде Это не обязательно хороший результат, если исходное намерение хорошее. Ведь иногда благими намерениями вымощена дорога в ад.

Заглавное изображение взято из фильма «Чистилище в Интернете: разоблачение комнаты N».

#Добро пожаловать на официальный аккаунт Айфанер в WeChat: Айфанер (WeChat: ifanr), в ближайшее время вам будет представлен более интересный контент.

Love Faner | Исходная ссылка · Просмотреть комментарии · Sina Weibo