Эти новые технологии Meta AI придают роботам «прикосновение».

Сегодня, с развитием роботов с искусственным интеллектом, для них уже не является странным наличие «зрения» или «слуха». Ведь эти два чувства являются едва ли не важнейшими каналами, посредством которых человек воспринимает физический мир.

Новая технология, недавно анонсированная исследовательской группой по базовому искусственному интеллекту Meta AI (FAIR), дает роботам « прикосновение ». В этом отношении видение Меты состоит в том, чтобы позволить ИИ «понимать мир богаче» и «лучше понимать и моделировать физический мир».

Нет сомнений в том, что эти новые технологии дают роботам еще один способ взаимодействия с миром, а также позволяют им сделать еще один шаг вперед на пути к тому, чтобы стать « человеческими ».

▲Изображение: NewsBytes

Meta работает с американской компанией по производству датчиков GelSight и корейской робототехнической компанией Wonik Robotics над разработкой ряда новых технологий и стремится коммерциализировать тактильные датчики и использовать их в искусственном интеллекте.

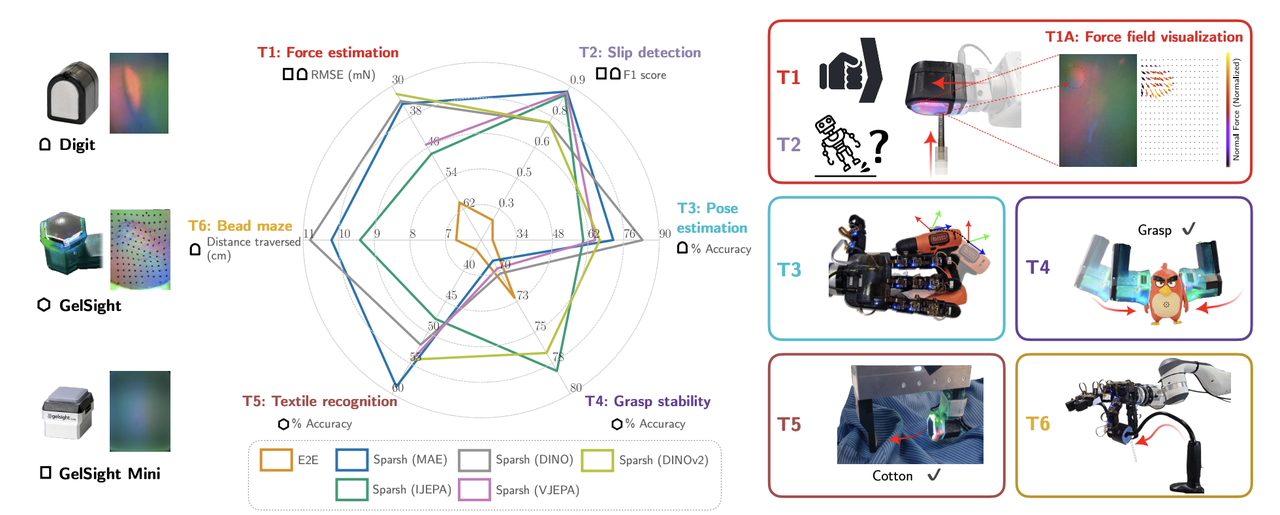

Эти новые технологии включают в себя три исследовательских инструмента — « Sparsh », « Digit 360 » и « Digit Plexus », ориентированных на тактильное восприятие, ловкость роботов и взаимодействие человека с компьютером. Кроме того, Meta также представляет « PARTNR », новый эталон для оценки планирования и рассуждения в сотрудничестве человека и машины.

Важно отметить, что эти новые технологии в настоящее время не предлагаются потребителям, а вместо этого нацелены на ученых и исследователей.

▲Изображение: Techopedia

Sparsh — первая универсальная модель кодера для тактильного восприятия на основе зрения , разработанная в сотрудничестве Вашингтонского университета и Университета Карнеги-Меллона.

Звучит немного абстрактно. Поскольку оно «тактильное», почему оно «основано на зрении»?

Фактически, традиционные методы основаны на ручных моделях конкретных задач и датчиках, которые требуют, чтобы « параметры прикосновения » объектов (такие как сила, трение и т. д.) были упакованы в « метки ощущений » и переданы роботу, который эквивалентно сообщению роботу, что такое «легкость»: «Держи осторожно» или «Толкай сильно».

Однако этот подход является громоздким, поскольку необходимо собирать множество таких данных тегов для каждой отдельной задачи и разных датчиков.

Спарш учится автономно на основе опыта посредством самоконтролируемого обучения (SSL) , не сообщая ему метку, соответствующую каждому действию. Он предварительно обучается на большом наборе данных, содержащем более 460 000 тактильных изображений, что позволяет роботу видеть множество различных объектов и сцен, а затем учиться распознавать и обрабатывать эти объекты самостоятельно.

Проще говоря, Спарш позволяет роботу научиться «чувствовать» объекты, просматривая большое количество изображений и видео , вместо того, чтобы вручную маркировать свои «чувства». Таким образом, роботу будет легче научиться использовать разные тактильные датчики для разных задач.

Интересно, что название «Спарш» происходит от санскрита, что означает « прикосновение или контактный сенсорный опыт », что очень соответствует его функции обработки цифровых тактильных сигналов и достижения сенсорного восприятия.

▲Изображение: Мета

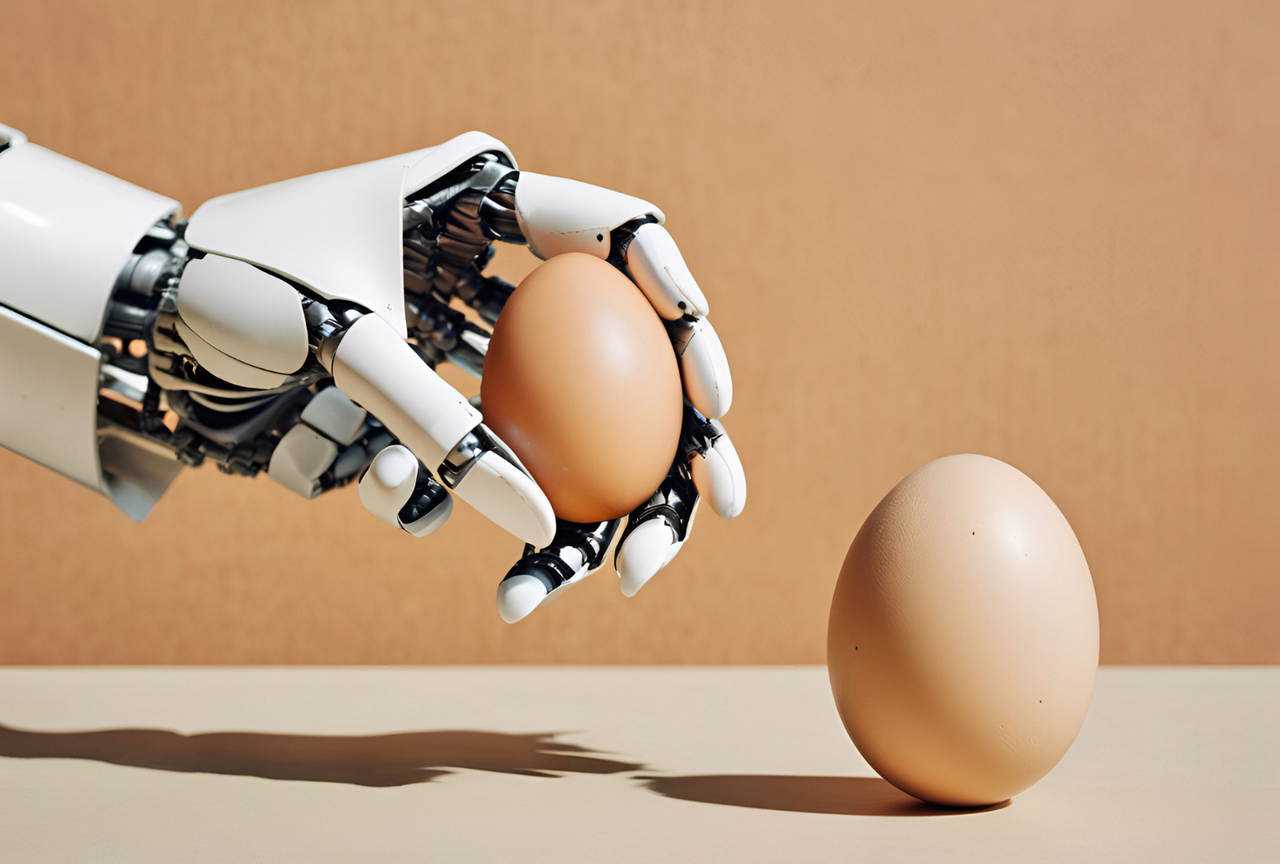

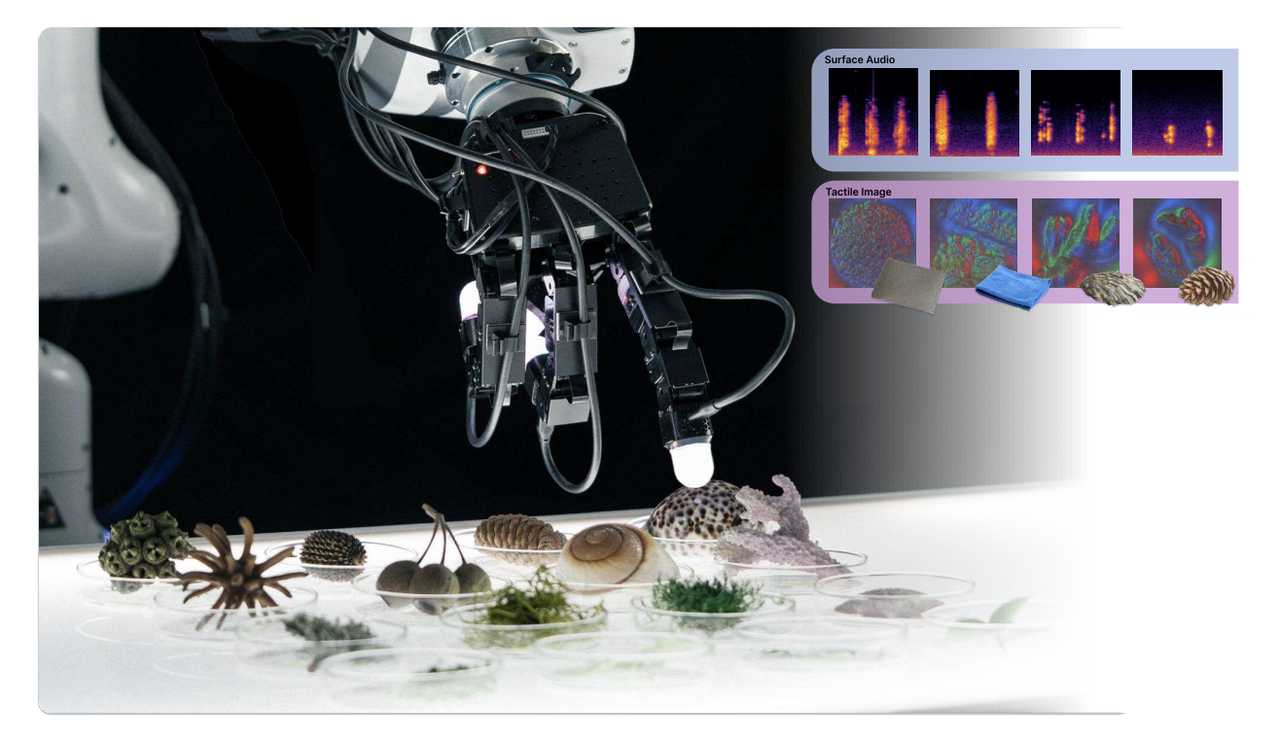

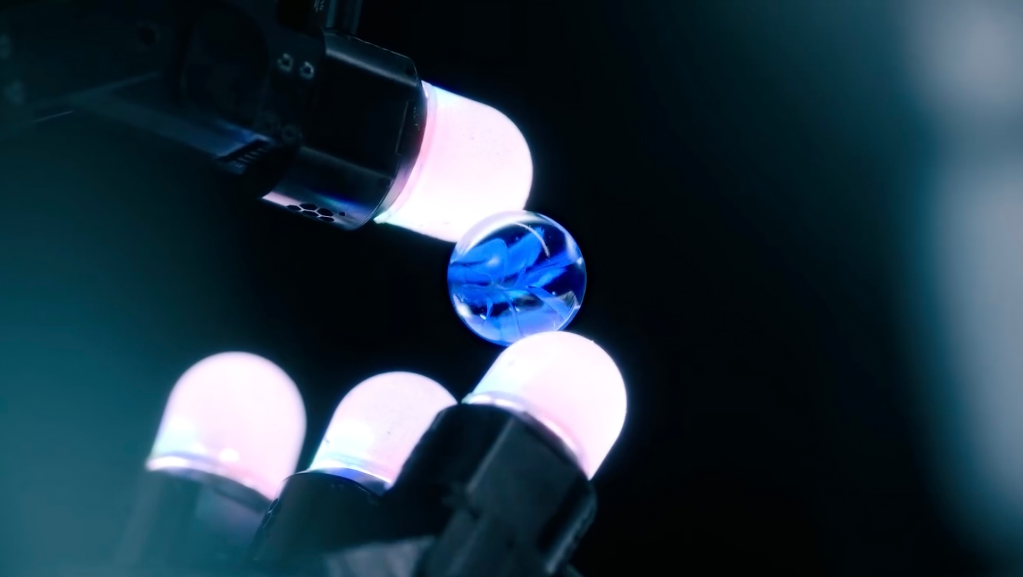

Digit 360 , искусственный тактильный датчик в форме пальца, разработанный Meta в сотрудничестве с GelSight, предоставляет богатые и подробные тактильные данные за счет оцифровки прикосновений с точностью человеческого уровня.

Digit 360, оснащенный более чем 18 сенсорными возможностями, позволяет исследователям комбинировать различные сенсорные технологии или изолировать отдельные сигналы для углубленного анализа каждого режима.

Он может обнаруживать мельчайшие изменения в пространственных деталях, улавливать силы величиной до 1 миллиньютона и включает в себя несколько режимов измерения, которые могут определять вибрацию, тепло и даже запах, что значительно превосходит предыдущие датчики.

▲Тактильный датчик Digit 360 (справа). Изображение взято с сайта Meta.

Команда Meta AI также разработала специальную оптическую систему с широким полем действия, распознающую касание, состоящую из более чем 8 миллионов сенсорных блоков (такселей), чтобы фиксировать всенаправленную деформацию поверхности кончиков пальцев.

Кроме того, с помощью встроенных в устройство ускорителей искусственного интеллекта Digit 360 способен быстро обрабатывать информацию, реагировать на сенсорные стимулы и действовать как периферическая нервная система робота. Дизайн вдохновлен рефлекторными дугами людей и животных .

Очевидно, что помимо повышения гибкости роботов, этот датчик имеет широкие перспективы применения в таких областях, как медицина, протезирование, виртуальная реальность и удаленное взаимодействие.

▲Изображение: Мета

Мета сказала в блоге:

Человеческая рука очень хорошо передает информацию о прикосновении к коже от кончиков пальцев к ладони в мозг, что позволяет ей активировать мышцы рук при принятии решений, например, как печатать на клавиатуре или взаимодействовать с перегретым предметом. Для реализации встроенного ИИ требуется аналогичная координация между тактильными ощущениями и двигательными активациями в руках робота.

Основываясь на этой концепции, Meta AI в сотрудничестве с Wonik Robotics предложила и создала стандартизированную программно-аппаратную платформу Digit Plexus .

Он позволяет интегрировать различные тактильные датчики на кончиках пальцев и кожи (такие как Digit, Digit 360 и ReSkin) в роботизированную руку, при этом тактильные данные кодируются и передаются на главный компьютер по одному кабелю для беспрепятственного сбора, управления и анализа данных. .

Система Plexus предназначена для упрощения разработки приложений робототехники, особенно тех, которые требуют сложной тактильной обратной связи. Используя Plexus, разработчики могут легче интегрировать технологию тактильных датчиков в свои проекты робототехники, улучшая ловкость роботов и восприятие физического мира.

▲Изображение: Techcrunch

Стоит отметить, что следующим шагом сотрудничества между Meta и Wonik станет разработка нового поколения Allegro Hand от Wonik, роботизированной руки, оснащенной тактильными датчиками, такими как Digit 360, которая будет работать на платформе Digit Plexus.

▲Фото: XELA

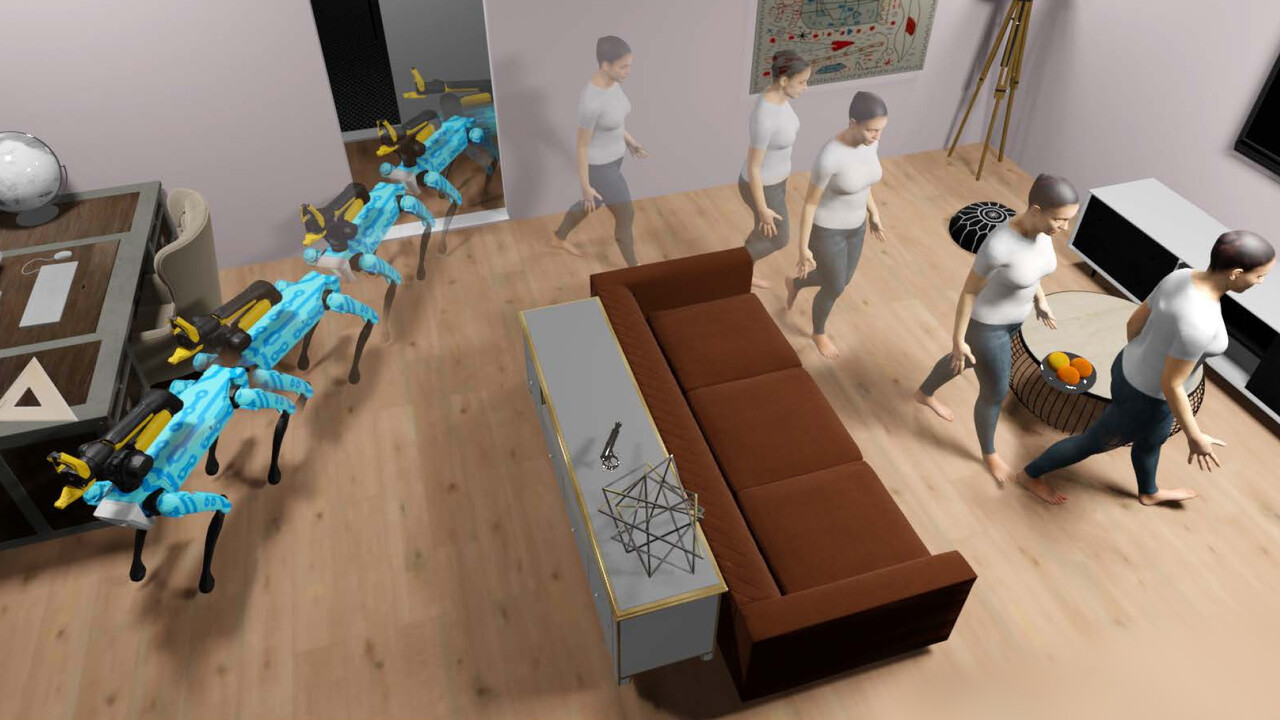

Чтобы изучить сотрудничество человека и машины в домашней деятельности, Meta выпустила PARTNR, эталон для планирования и рассуждения совместной работы человека и машины , основанный на Habitat 3.0, платформе моделирования для изучения задач сотрудничества человека и машины в домашних условиях.

PARTNR — это крупнейший в своем роде тест, состоящий из 100 000 заданий на естественном языке, охватывающих 60 домов и более 5800 уникальных объектов. Целью этого теста является оценка производительности больших моделей языка и зрения (LLM/VLM) в сотрудничестве с людьми с помощью инструментов взаимодействия человека и компьютера.

Предоставляя стандартизированные тесты и наборы данных, Meta заявляет, что «надеется, что это позволит исследованиям роботов действовать не только независимо, но и вокруг людей, делая их более эффективными, надежными и адаптируемыми к предпочтениям каждого человека».

▲Изображение: LinkedIn

Предоставление роботам «прикосновения» — это не «воздушный замок».

Эти роботы гораздо более чувствительны к внешним изменениям, чем люди. Благодаря эффективным программным и аппаратным системам совместной работы они найдут широкое применение в хирургических операциях или производстве точных инструментов .

Фактически, не только «зрение», «слух» и «осязание» исследователи из Университета штата Пенсильвания смоделировали « вкус » в модели искусственного интеллекта, в то же время компания под названием Osmo научила модель искусственного интеллекта тому, как это делать; подражать Юанью на человеческом обонянии .

Возможно, будущие роботы смогут полностью «копировать» человека с точки зрения чувств. Просто реалистичных «гуманоидов» у них лучше бы больше не было, иначе возникнет эффект зловещей долины.

# Добро пожаловать на официальную общедоступную учетную запись WeChat Aifaner: Aifaner (идентификатор WeChat: ifanr). Более интересный контент будет предоставлен вам как можно скорее.

Ай Фанер | Исходная ссылка · Посмотреть комментарии · Sina Weibo