01Ван выпустил модель со 100 миллиардами параметров Yi-Large, Кай-фу Ли: Большие модели Китая догнали Соединенные Штаты и полны решимости составить конкуренцию GPT-5

Через год Кай-Фу Ли снова вышел из круга с «Zero One Thousand Things».

В мае прошлого года была основана компания Zero One Thing, а шесть месяцев спустя она выпустила свою первую китайско-английскую двуязычную серию моделей Yi. С самого начала Кай-Фу Ли поставил перед собой амбициозную и непростую цель: «стать № 1 в мире».

Lingyiwuwu, которая с самого рождения была «популярной горячей курицей», также опиралась на команду с опытом работы в крупной компании и отличными модельными показателями, чтобы достичь оценки в 1 миллиард долларов США.

Сегодня они представляют свой второй продукт: модель Yi-Large с закрытым исходным кодом .

Атака на глобальную модель SOTA

В ноябре прошлого года Yi-34B, выпущенный Lingyiwuwu, попал в список Hugging Face со своим размером «десертного уровня» в сообществе разработчиков программного обеспечения с открытым исходным кодом, превзойдя в несколько раз более крупные модели, такие как Llama2-70B и Falcon-180B, и стал крупнейшая в мире модель того времени. Одна из самых сильных базовых моделей внутреннего открытого кода.

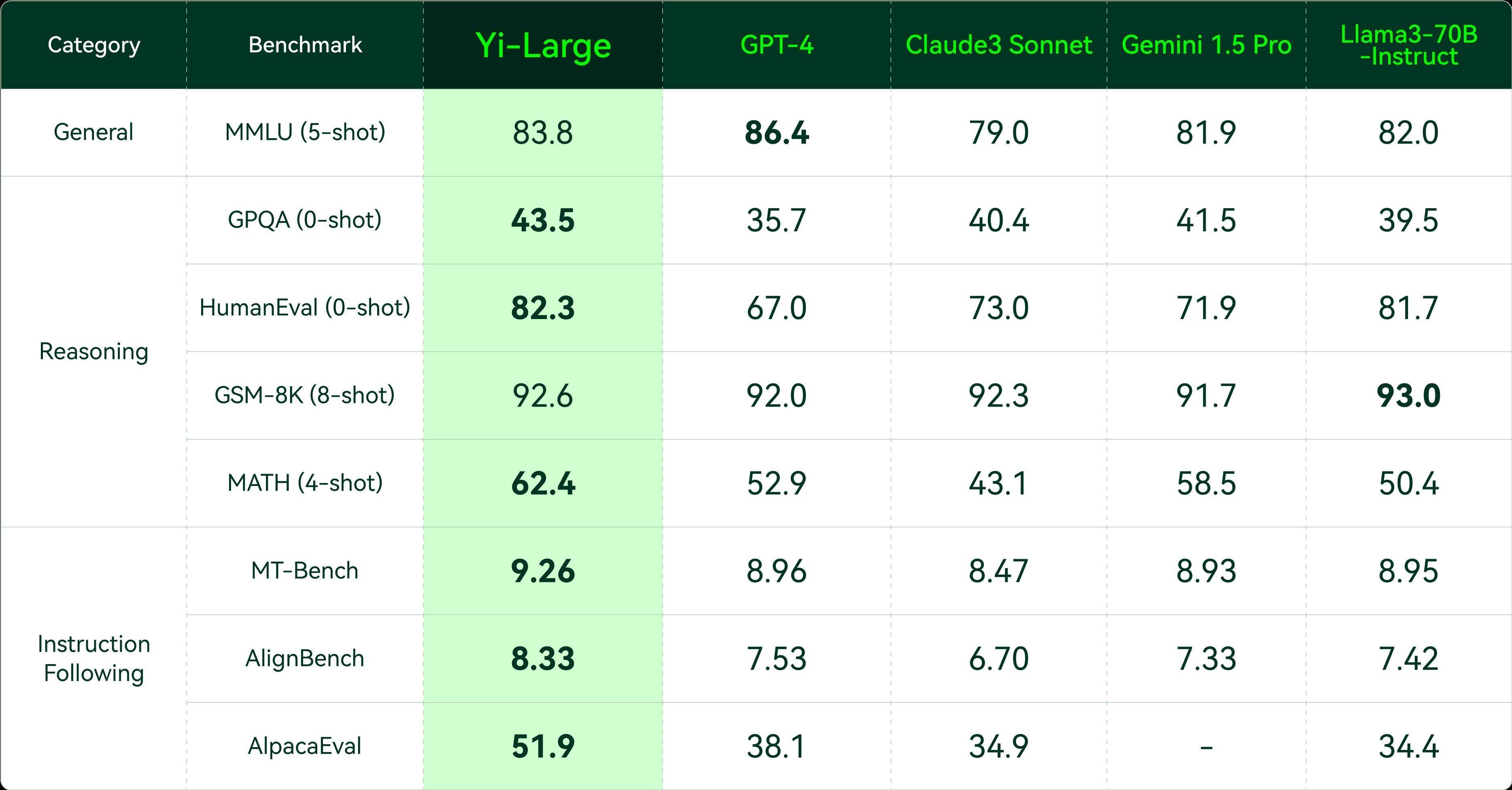

Полгода спустя 01Wang официально выпустила Yi-Large с масштабом параметров 100 миллиардов. По независимой авторитетной оценке, модель 01Wanyi Yi показала хорошие результаты на китайском и английском двуязычных ПК среди ведущих больших моделей мира.

В последнем официально сертифицированном модельном рейтинге AlpacaEval 2.0, Стэнфордского оценочного агентства, основной показатель владения английским языком модели Yi-Large, LC Winrate (контролирующий длину ответа), занимает второе место в мире, уступая только GPT. -4 Турбо, процент побед даже занимает первое место в мире.

Раньше среди отечественных моделей в топ-20 этого списка входили только Yi и Qwen.

Важным условием разумного использования большой модели является понимание того, о чем вы говорите.

Иностранные модели имеют отличные характеристики, но все они основаны на английском контексте. Однако крупные отечественные модели, родившиеся в стране, обладают уникальными преимуществами в понимании китайского языка.

Что касается владения китайским языком, в апрельском тесте производительности, обновленном SuperCLUE, Yi-Large также занял первое место среди отечественных больших моделей. Комплексные двуязычные возможности Yi-Large на китайском и английском языках продемонстрировали отличную производительность.

В более комплексной оценке возможностей крупных моделей Yi-Large превзошёл по большинству показателей аналогичные модели, такие как GPT4, Claude3 и Google Gemini 1.5, достигнув первого места. Он добился лучших результатов, чем мировые лидеры, в общих способностях, генерации кода, математических рассуждениях и следовании инструкциям и прочно вошёл в число первых эшелонов мира.

Поскольку возможности больших моделей каждой компании вступают в новый этап стремления сравнить их с GPT4, фокус оценки больших моделей также начал смещаться от простых общих возможностей к сложным возможностям рассуждения, таким как математика и программирование.

Yi-Large также добился потрясающих результатов в таких наборах оценок, как HumanEval для возможностей генерации кода, GSM-8K и MATH для математических рассуждений и GPQA для экспертных возможностей.

Кроме того, с точки зрения отраслевого внедрения понимание человеческих инструкций и согласование человеческих предпочтений стали незаменимыми возможностями для больших моделей, а оценки, связанные с следованием инструкциям (Instruction Follow), все больше ценятся крупными мировыми модельными компаниями.

MT-bench, запущенный Стэнфордским проектом оценки с открытым исходным кодом AlpacaEval и Berkeley LM-SYS, представляет собой два набора наборов для оценки соответствия инструкциям на английском языке, а AlignBench — это китайский тест для оценки соответствия, запущенный командой Университета Цинхуа.

В оценочном наборе авторитетных инструкций в стране и за рубежом Yi-Large показал себя лучше, чем пять лучших международных моделей.

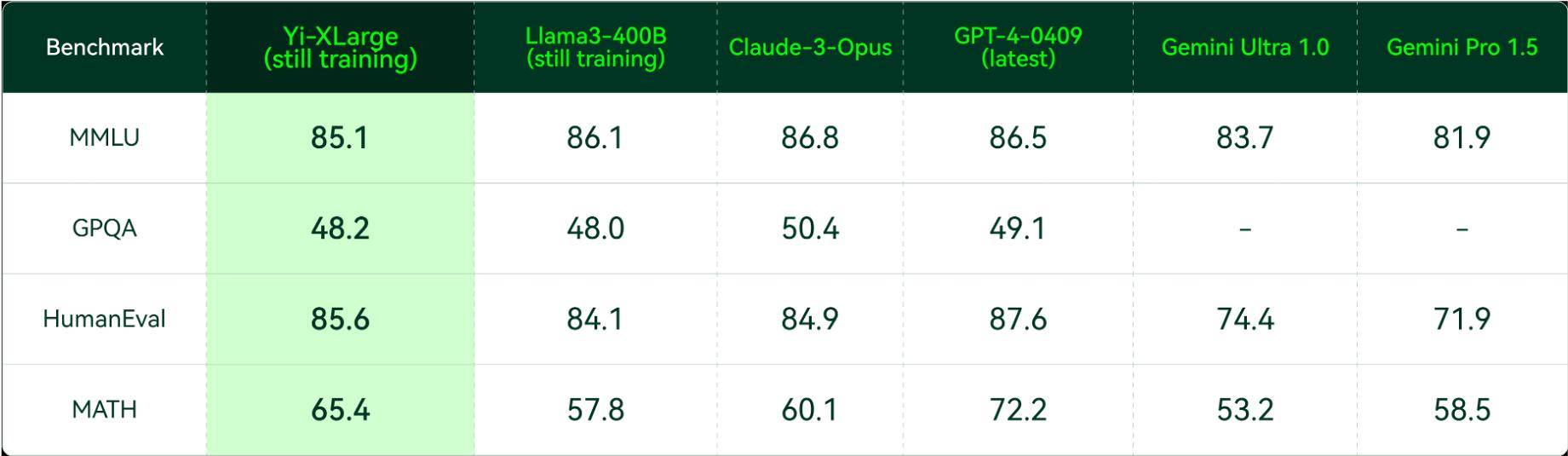

На пресс-конференции Кай-фу Ли также объявил, что Zero One Wish запустила обучающую модель Yi-XLarge MoE следующего поколения, которая повлияет на производительность и инновации GPT-5.

В то же время Zero One Thousand Things также рассматривает некоторые очень сложные вопросы. Кайфу Ли резюмировал три ключевых момента:

- С одной стороны, нам нужно подготовиться к развитию технологий и к тому, какие модели мы можем производить;

- Во-вторых, как минимизировать затраты на рассуждения и позволить нам зажечь точку инклюзивности;

- В-третьих, существует традиционный PMF для выявления потребностей пользователей.

Кай-Фу Ли сказал, что подобные соображения обычно не встречаются в компаниях Кремниевой долины:

Это наш уникальный подход и возможность для китайских единорогов.

Yi-1.5 полностью обновлен, и платформа API запущена по всему миру.

На этой пресс-конференции серия моделей Yi с открытым исходным кодом также получила комплексное обновление. Yi-1.5 разделен на три версии: 34B, 9B и 6B, а разработчикам предоставлена модель тонкой настройки Yi-1.5-Chat. Выбери из.

Судя по оценочным данным, серия Yi-1.5 продолжает выдающуюся производительность моделей с открытым исходным кодом серии Yi. Хотя математическая логика и возможности кодирования значительно улучшены, языковые возможности также поддерживают исходный высокий уровень.

После тонкой настройки Yi-1.5-6B/9B/34B-Chat поднялся на более высокий уровень с точки зрения математических рассуждений, способностей к кодированию и следования инструкциям.

Производительность Yi-1.5-6B/9B-Chat на наборах оценки математических способностей, таких как GSM-8K и MATH, и наборах оценки способностей кода, таких как HumanEval и MBPP, далека от того же, что и модель на уровне параметров, а также лучше, чем недавно вышедшая Лама-3-8Б-Инструкт.

Оценки на MT-Bench, AlignBench и AlpacaEval также занимают лидирующие позиции среди моделей с одинаковым значением параметра.

В прошлом году Zero One Wanwan решила запустить модель серии Yi с открытым исходным кодом, и ее превосходные характеристики были высоко оценены международными разработчиками.

В первый месяц после запуска версии Yi с открытым исходным кодом в ноябре 2023 года она занимала почти 50% рейтингов популярных моделей в сообществе с открытым исходным кодом. Через месяц после выпуска Yi-34B был включен в игровую площадку больших моделей Nvidia.

У Кай-фу Ли также есть свои собственные идеи по решению проблем, когда дело касается таких вопросов, как разработка крупных моделей и внедрение продуктов.

В интервью APPSO Кай-фу Ли сказал:

Мы прагматично верим в AGI. Мы должны использовать наименьшее количество чипов и минимальные затраты для обучения лучшей модели, которую мы можем. В то же время мы продолжим исследовать и найти TC-PMF. По сравнению с компаниями Кремниевой долины, разница между отечественными стартапами заключается в том, что мы можем смотреть на звезды, но мы также можем твердо стоять на ногах.

Единственная мысль, что все вещи не могут творить чудеса с помощью чистой силы, – это выяснить, можно ли использовать десять миллиардов долларов США или сто миллиардов долларов США. OPEN AI имеет право попробовать этот путь, но это не тот путь, по которому они хотят идти. Конечно, они не будут тратить время на то, чтобы предсказать точку воспламенения AGI, но он может с уверенностью сказать всем, что является более важным. это точка AI Pratt & Whitney.

Сегодня Lingyiwanwu также объявила, что выпустила несколько интерфейсов API моделей, включая Yi-Large, Yi-Large-Turbo, Yi-Medium, Yi-Medium-200K, Yi-Vision, Yi-Spark и т. д. для внутреннего рынка одновременно. Во время англоязычный сайт Yi API Platform открыт для разработчиков со всего мира для пробных приложений одновременно.

Среди них API Yi-Large с масштабом параметров 100 миллиардов обладает производительностью генерации супертекста и рассуждений и подходит для сложных рассуждений, прогнозирования, создания углубленного контента и других сценариев;

API Yi-Large-Turbo сбалансирован и настроен с высокой точностью на основе производительности, скорости вывода и стоимости и подходит для всех сценариев, высококачественного вывода и генерации текста.

Преимущество Yi-Medium API заключается в возможности следовать инструкциям, что подходит для чата, диалога, перевода и других сценариев в обычных сценариях;

Если вам нужны приложения, связанные с документами сверхдлинного содержания, вы также можете выбрать API Yi-Medium-200K, который может интерпретировать 200 000 слов текста одновременно;

Yi-Vision API обладает высокопроизводительными возможностями понимания и анализа изображений и может обслуживать чат на основе изображений, анализ и другие сценарии;

API Yi-Spark ориентирован на легкий и чрезвычайно быстрый ответ и подходит для легкого математического анализа, генерации кода, текстового чата и других сценариев.

Что еще более важно, уже есть практическое применение, и «Маленькая поджелудочная железа», разработанная для пациентов с опухолями поджелудочной железы, является одним из них.

Искусственный интеллект Xiaoyibao может предоставить пациентам комплексные знания о лечении 24 часа в сутки, 7 дней в неделю.

Техническая поддержка этого помощника — модель Yi Zero One Thing. Используя API Yi для вызова большой модели искусственного интеллекта, Сяовейбао преодолевает информационный барьер лечения опухоли поджелудочной железы и может точно и систематически представлять дорожную карту и план лечения рака поджелудочной железы пациентам с опухолью поджелудочной железы.

На данный момент этот благотворительный проект помог более чем 3000 пациентам с опухолью поджелудочной железы.

Универсальная рабочая платформа

На сегодняшней пресс-конференции также была представлена «Wanzhi», универсальная рабочая станция искусственного интеллекта, недавно выпущенная Zero One Wagon.

Согласно официальному описанию, Wanzhi — это универсальная рабочая платформа искусственного интеллекта, специально разработанная для китайских пользователей. Она может составлять протоколы встреч, еженедельные отчеты, писать помощников, интерпретировать финансовые отчеты, документы и создавать PPT. Она двуязычна на китайском и английском языках. и совершенно бесплатно.

В настоящее время пользователи могут войти в систему и испытать ее через официальный сайт и приложение WeChat «Wanzhi AI».

На пресс-конференции официальные лица Ваньчжи привели очень практический пример:

Вы только что спустились в компанию, и ваш руководитель внезапно попросил вас провести презентацию на собрании, но компьютера нет рядом. Теперь через Wanzhi введите тему, которую вы хотите представить, на своем мобильном телефоне, а затем дождитесь двух. минут, которые вам понадобятся, чтобы добраться от лифта до вашего рабочего места. PPT Это было сделано на веб-странице Wanzhi. После этого вам нужно всего лишь добавить простой текст, изображения и изменения, чтобы использовать его напрямую.

Кроме того, у Ванжи есть множество других функций.

Во-первых, Wanzhi AI Assistant может быстро читать и понимать большой объем содержимого документов, включая длинные документы и сложные финансовые данные. Он может извлечь ключевую информацию за несколько секунд и поддерживает двуязычное чтение на китайском и английском языках.

Во-вторых, в общих сценариях вопросов и ответов Ванчжи также продемонстрировал отличную производительность продукта, будучи способным быстро давать соответствующие ответы и обеспечивать профессиональную и быструю обратную связь.

Кроме того, Wanzhi AI Assistant не только поддерживает текстовый вывод, но также может отображать информацию в различных формах, таких как таблицы, формулы, коды и т. д., делая отчеты о работе и планировании жизни более понятными.

Наконец, Wanzhi AI Assistant может получать доступ к информации в Интернете в режиме реального времени, гарантируя, что данные и идеи, полученные пользователями, являются самыми последними и точными.

Согласно исследованиям и наблюдениям команды Wanzhi, эффективность личной работы увеличилась в среднем более чем на 50% после использования Wanzhi, особенно с точки зрения поиска знаний, разработки и написания документов и т. д., что значительно экономит время.

В настоящее время Wanzhi AI Assistant полностью бесплатен и открыт для пользователей.

Представители Wanzhi заявили, что применение подобных крупных моделей определенно станет важной точкой приземления в Китае в этом году.

Кай-Фу Ли также упомянул, что этот год станет первым годом использования инструментов повышения производительности искусственного интеллекта, поскольку в этом году некоторые области произойдут взрывным образом.

Он считает, что реальная ценность AI-Frist заключается в том, кто создаст AI Douyin, AI WeChat и AI Taobao? Zero One надеется, что у них есть потенциал послужить таким воспламенителем.

Однако точка включения всего ИИ наступит не одновременно, и требования к приложениям в некоторых областях будут очень высокими.

Например, с помощью инструментов повышения производительности, которые мы сейчас создаем, пользователь несет полную ответственность за контент, создаваемый инструментом повышения производительности. Таким образом, если в нем есть какие-то ошибки, которые не идеальны, требуют тонкой настройки или даже небольшая иллюзия, именно пользователь окончательно решает, можно ли его изменить, поэтому индикатором пользователя является то, могу ли я создавать лучший контент. в более быстрое время, чем без этого инструмента.

Кай-Фу Ли сказал, что TC-PMF действительно добился этого, но он может быть лучше, поэтому в этом году это обязательно произойдет с инструментами повышения производительности.

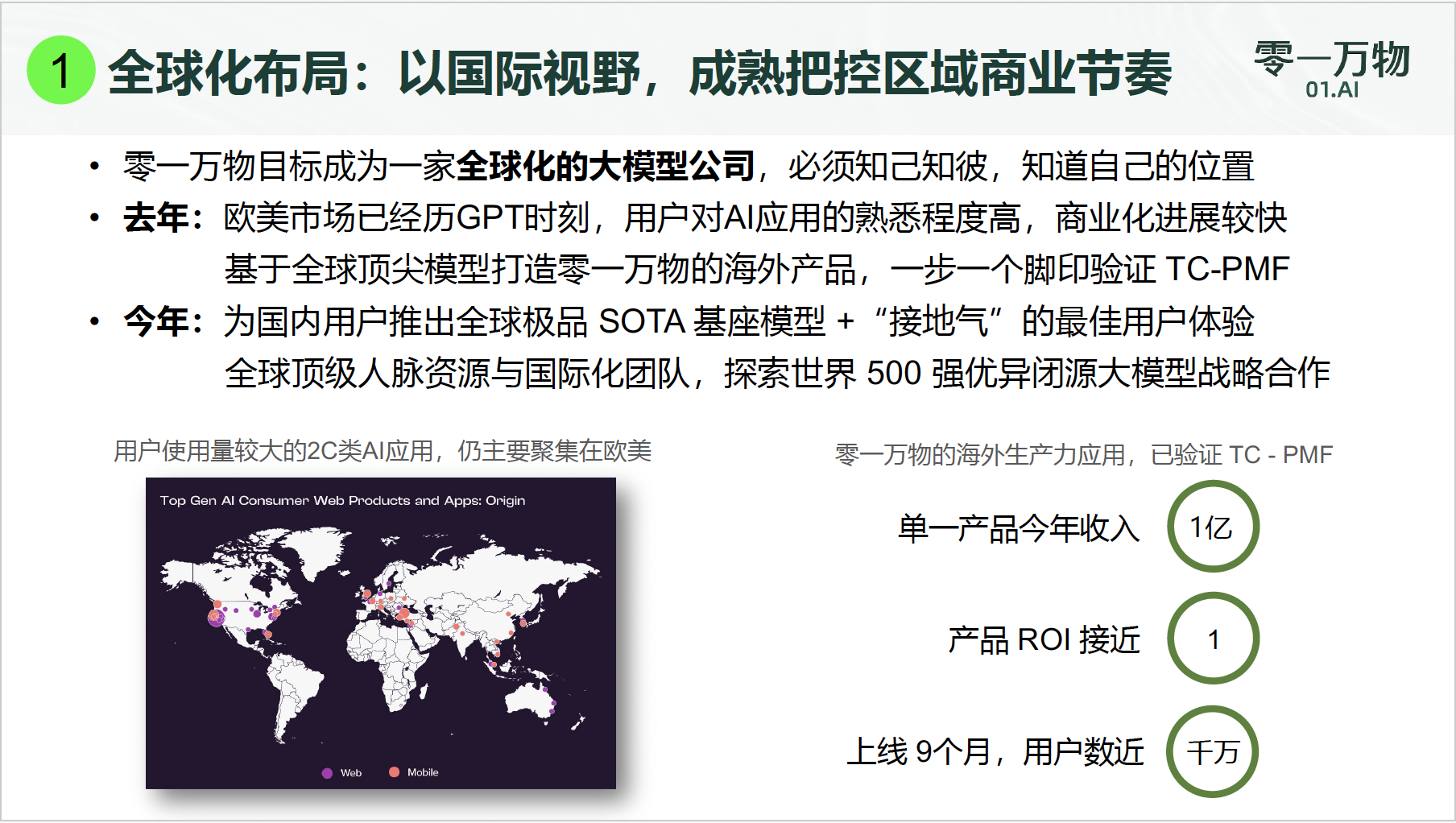

В настоящее время общее количество зарубежных пользователей приложений для повышения производительности Zero One Thousand Things приближается к 10 миллионам, а доход от одного продукта ToC в этом году достиг 100 миллионов юаней.

Кай-Фу Ли рассказал:

Наша рентабельность инвестиций по-прежнему составляет около 1. Поэтому такие результаты очень выгодны, по крайней мере, с точки зрения крупных отечественных модельных компаний.

В начале 2023 года, когда отечественное поле крупных моделей находится в схватке, различные оценочные списки огромны, и немало моделей находятся на вершине каждого основного списка.

В эпоху искусственного интеллекта 1.0 искусственный интеллект еще не продемонстрировал высоких возможностей обобщения и появления, и приватизированная модель развертывания для главных клиентов стала основной. Однако время показало, что доход, приносимый проектно-ориентированной моделью тяжелой доставки, существует. является верхним пределом роста, и проблемы его устойчивости являются серьезными.

Сегодня мы живем в эпоху ИИ 2.0, и искусственный интеллект вступил в новый этап развития. По сравнению с версией 1.0, ИИ 2.0 знаменует собой скачок от автоматизированной обработки на основе правил к возможностям глубокого обучения и автономного обучения.

С этой точки зрения «Битва ста полков» в области ИИ будет только усиливаться.

С прошлого года все больше крупных моделей отечественного производства выделяются в жесткой конкуренции, а также добиваются впечатляющих результатов в известных мировых рейтингах.

В этом году отрасль вступит в более реалистичную стадию коммерческого внедрения, и пользователи будут голосовать ногами, основываясь на возможностях, продемонстрированных на стороне приложения. Как максимально улучшить эффект применения на основе возможностей базовой модели – важный вопрос в догоне TC-PMF.

Кай-Фу Ли сказал:

Год назад крупные модели Китая чувствовали себя слишком отсталыми (по отношению к Соединенным Штатам). Но сегодня мы с большой гордостью можем сказать, что уже год мы спешим и по моделям мы, по крайней мере, догнали топовые (большие модели) продукты в США, выпущенные год назад. , мы будем продолжать усердно работать в будущем. Однако нам нужно иметь прогноз и прогноз на будущее, и мы не можем просто бежать как сумасшедшие.

В эпоху искусственного интеллекта, когда волны за рекой Янцзы толкают волны вперед, величайшее значение для пользователей имеет знание искусственного интеллекта, понимание искусственного интеллекта, использование искусственного интеллекта и даже применение его в работе, учебе и жизни в условиях конкуренции между производителями.

И это также первоначальная цель и предназначение технологии искусственного интеллекта.

*Фу Лицюнь также внес свой вклад в эту статью.

# Добро пожаловать на официальную общедоступную учетную запись WeChat aifaner: aifaner (идентификатор WeChat: ifanr). Более интересный контент будет предоставлен вам как можно скорее.

Ай Фанер | Исходная ссылка · Посмотреть комментарии · Sina Weibo