Эти продукты искусственного интеллекта разрушают барьеры для 430 миллионов человек

Ранее мы написали статью «Больше не спрашивайте меня, почему глухие ходят на музыкальные фестивали» , в которой популяризировали особое положение зарубежных музыкальных фестивалей: сурдопереводчиков.

Хотя люди с нарушениями слуха не могут слышать или отчетливо слышать музыку, они могут чувствовать ритм музыки и теплоту атмосферы благодаря очень заразительным движениям рук переводчиков языка жестов, выражению лица и языку тела.

Это может быть неожиданный сценарий языка жестов для слышащих людей. На самом деле мест, где нужны сурдопереводчики, как онлайн, так и офлайн, еще много, но их недостаточно.

Салли Чок, англичанка, открыла в 2002 году британскую компанию по переводу жестового языка. За 20 лет работы компания выросла до значительных масштабов, а время заказа сурдопереводчика сократилось до 30 минут, но она все еще не удовлетворен.

Могут ли люди с нарушениями слуха получить немедленный доступ к сурдопереводу, подобно включению субтитров на видеосайте?

Ее ответ — привлечь ИИ.

От онлайна к оффлайну людям с нарушениями слуха нужно разрешить чаще использовать свой «родной язык»

В 2022 году Салли Чок открыла новую стартап-компанию Signapse, сосредоточившуюся на разработке программного обеспечения для перевода с генеративного искусственного языка на язык жестов для перевода письменного текста на американский язык жестов и британский язык жестов в реальном времени.

В мае этого года Signapse получила 2 миллиона фунтов стерлингов в виде начального финансирования, из которых 500 000 фунтов стерлингов поступило от британского правительства.

Один из оффлайн-сценариев, на которые они нацелены, — это транспортные узлы, такие как вокзалы и аэропорты.

Международный аэропорт Цинциннати/Северный Кентукки в США заключил партнерское соглашение с Signapse, чтобы отображать на экране американский язык жестов для обеспечения приветствия, безопасности, отправления, прибытия и другой информации.

Как работает ИИ? Signapse основан на большом наборе данных языка жестов и использует генеративно-состязательные сети (GAN) и методы глубокого обучения для создания реалистичных виртуальных переводчиков языка жестов, которые переводят максимально точно.

Эти аватары созданы на основе реальных сурдопереводчиков, и каждый раз, когда они используются в коммерческих целях, реальные люди получают свою долю.

Учитывая, что пункты назначения аэропортов, время отправления и номера платформ часто меняются, сурдоперевод Signapse может обновляться в режиме реального времени путем интеграции с данными о дорожном движении.

В то же время Signapse не игнорирует онлайн-потребности и также обеспечивает сурдоперевод для веб-сайтов и потокового видео.

Хотя такие веб-сайты, как YouTube, имеют закрытые субтитры, люди с нарушениями слуха часто предпочитают язык жестов субтитрам, поскольку язык жестов имеет грамматические структуры и выражения, независимые от других языков, что улучшает их работу в Интернете.

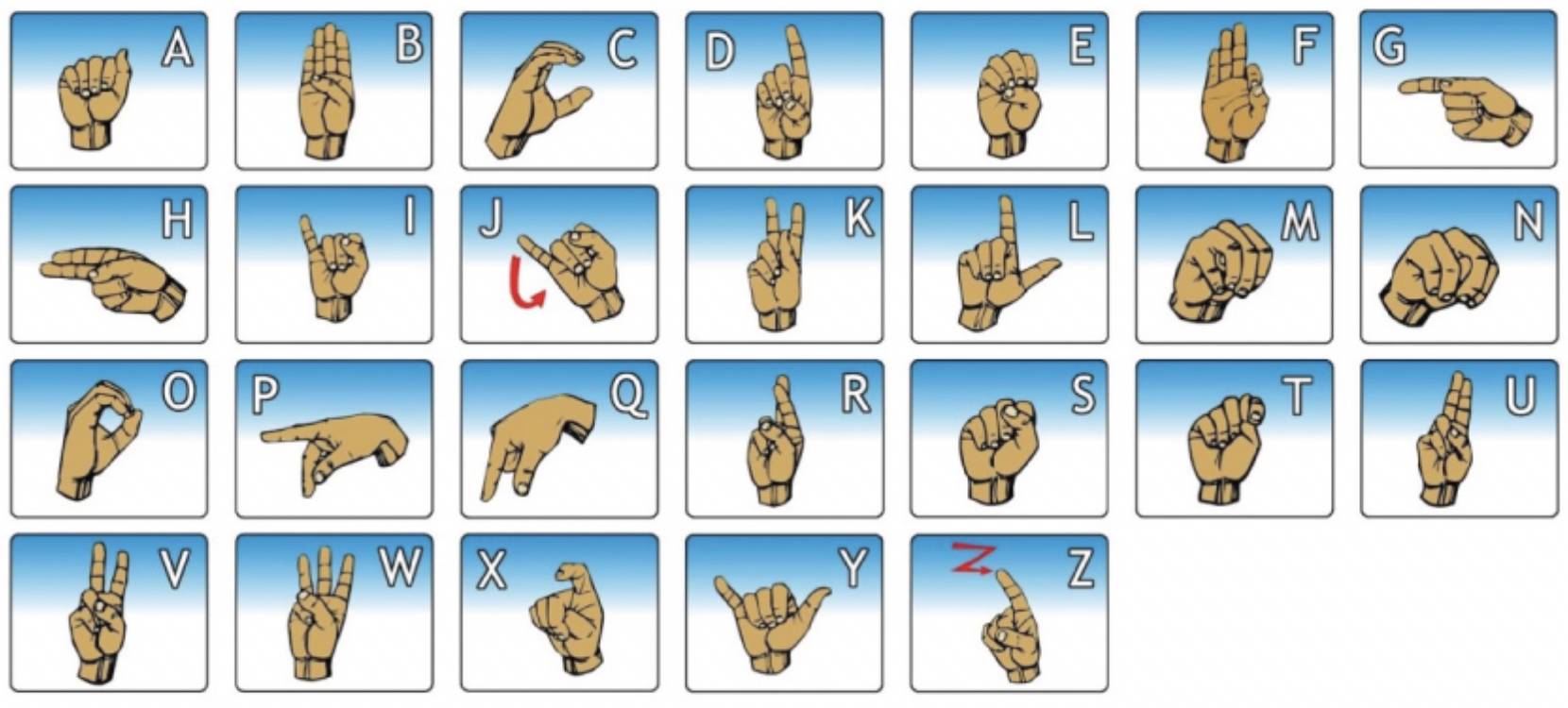

Вы должны были заметить, что, говоря о языке жестов, мы используем американский язык жестов и британский язык жестов. Подобно тому, как устные и письменные языки во всем мире непостижимы, язык жестов всеобъемлющ.

По данным Организации Объединенных Наций, около 70 миллионов человек во всем мире используют язык жестов в качестве основной формы общения, и во всем мире используется более 300 различных типов языка жестов. Только в Соединенных Штатах 500 000 человек используют американский язык жестов.

Таким образом, то, что делает Signapse в настоящее время, на самом деле очень ограничено: оно охватывает лишь небольшое количество людей, использующих американский и британский язык жестов, а также ограниченные вертикальные сценарии. За последние два года Signapse ежедневно создавал около 5000 объявлений о дорожном движении на британском языке жестов.

Signapse надеется, что в будущем их услуги станут более универсальными, охватят образование и другие сценарии, а также более персонализированными, позволяя пользователям настраивать внешний вид виртуальных сурдопереводчиков.

Окружающая среда и условия поддерживают ИИ, и крупные отечественные производители также имеют аналогичные продукты с языком жестов.

Ведущие искусственного языка жестов появились в комнате прямой трансляции Tencent Honor of Kings и на конференции разработчиков Huawei.

На зимних Олимпийских играх 2022 года был запущен ведущий на языке жестов искусственного интеллекта, созданный совместно CCTV News и Baidu Intelligent Cloud Xilin, а Школа искусственного интеллекта для глухих Тяньцзиньского научно-технического университета приняла участие в аннотировании материалов на языке жестов.

Помимо якоря языка жестов AI, платформа языка жестов AI Baidu Intelligent Cloud Xiling также может удовлетворить потребности быстрого перевода языка жестов в различных сценариях, таких как больницы, станции, банки и т. д., что аналогично герою Signapse.

Более плавное путешествие, более захватывающий опыт просмотра, больше безбарьерных услуг…

Если возможности для улучшения интерпретации языка жестов глубже моря, то, по крайней мере, способ получения публичной информации людьми с нарушениями слуха меняется благодаря ИИ, причем видимые волны продолжают расти.

Люди Дуолинго в мире языка жестов

Хотят ли слабослышащие люди тоже «слушать» музыку? Достаточно ли слабослышащим людям читать текст? Это типичное соображение, основанное на логике слышащих людей.

На самом деле, мы должны спросить наоборот: как люди с нарушениями слуха могут испытывать чувство участия в музыкальных фестивалях? Как Интернет может сделать серфинг более приятным для людей с нарушениями слуха?

Поэтому дело не в том, что на занятой станции есть лишний экран, а в том, что экран должен быть там.

Все больше компаний и людей используют возможности технологий, чтобы сделать язык жестов все более актуальным.

Позволить слышащим людям изучать язык жестов — одна из самых простых идей.

PopSign — это приложение для изучения языка жестов во время игры. Оно использует модель языка жестов искусственного интеллекта и было разработано совместно Google, Рочестерским технологическим институтом и Технологическим институтом Джорджии. Его можно использовать на Android и iOS. Слабослышащие дети слышащих родителей.

Узнав из урока, что запоминание слов начинается с «отказа» (сдачи) и заканчивается отказом, PopSign не проигрывает скучные видеоролики на языке жестов, а использует мини-игры, чтобы повысить ваш интерес и уверенность в изучении языка жестов. Это то же самое. как Duolingo, который отчаянно призывает вас зарегистрироваться. .

Есть также американская компания SLAIT, которая хочет стать «Duolingo» в мире языка жестов. Они также предоставляют захватывающие интерактивные курсы и тесты. Если вы все сделаете правильно, преподаватель по искусственному интеллекту предоставит вам обратную связь в режиме реального времени и обеспечит необходимое количество эмоциональной ценности.

Однако обучение языку жестов — лишь второй лучший вариант для SLAIT. Вначале они хотели создать инструмент на языке жестов с искусственным интеллектом для видеочата и перевода в реальном времени.

Но трудно приготовить еду без риса. SLAIT — это небольшая команда, у которой недостаточно данных и средств. По сравнению с прямым переводом предложений на языке жестов обучение отдельной лексике языка жестов проще, но не менее ценно.

Тяжелая работа по интерпретации языка жестов остается на плечи богатых гигантов.

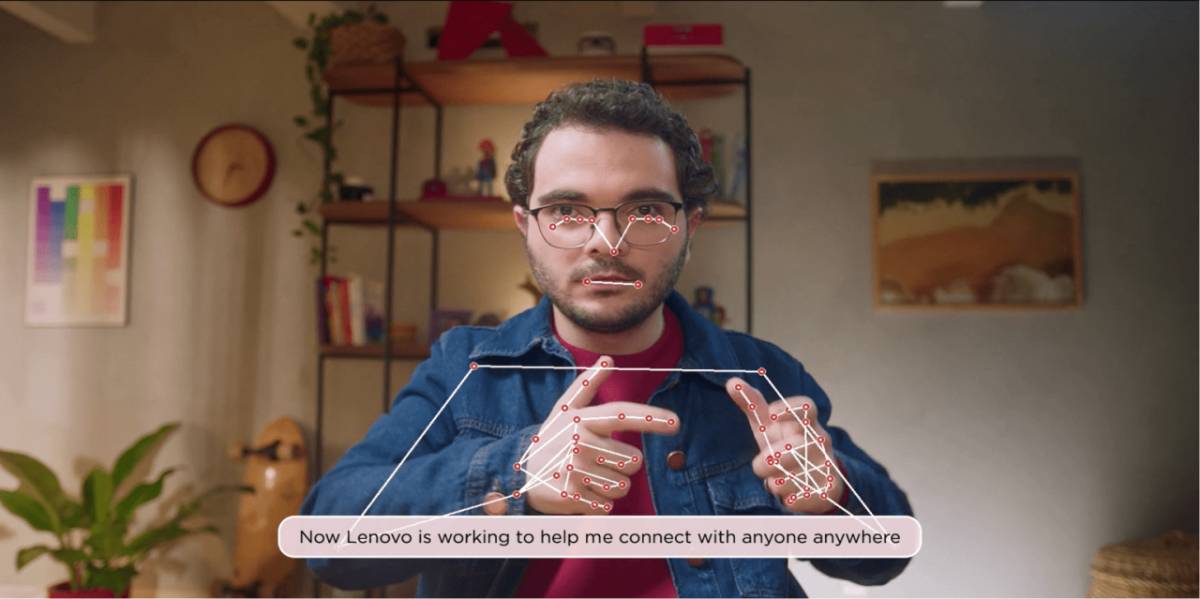

В августе 2023 года компания Lenovo Brazil разработала приложение для перевода чата в режиме реального времени на основе искусственного интеллекта для перевода португальского языка жестов и планирует в будущем охватить больше языков жестов по всему миру.

Когда человек с нарушением слуха подписывает перед камерой устройства, алгоритм мгновенно переводит его на португальский текст и отправляет получателю на другом конце.

Таких инструментов должно быть как можно больше, которые дополняют услуги по обучению жестовому языку и позволяют людям с нарушениями слуха играть более активную роль и становиться более инициаторами разговора.

Google более ориентирован на продукт и в 2023 году запустил конкурс Kaggle AI по распознаванию языка жестов.

Тема этого конкурса очень интересна — на основе более чем 3 миллионов символов, написанных пальцами, полученных из селфи людей с нарушениями слуха, участники создают модель написания пальцев, которая использует интеллектуальные камеры для быстрого отслеживания пальцев, ладоней и лиц.

Пальцевое правописание — это тип языка жестов, в котором для обозначения букв используются разные формы и положения пальцев. Для многих людей с ограниченными возможностями писать пальцем гораздо быстрее, чем печатать на виртуальной клавиатуре смартфона.

Таким образом, улучшение распознавания языка жестов и создание моделей написания пальцев позволит людям с нарушениями слуха напрямую использовать язык жестов, которым они лучше владеют, вместо того, чтобы печатать и говорить, а также использовать такие функции, как поиск, карты и текстовые сообщения на своих мобильных телефонах. телефоны.

Кроме того, это также поможет разработать приложения для преобразования языка жестов в речь, выходя из тупика, в котором люди с нарушениями слуха не могут использовать голос для вызова цифровых помощников.

Другими словами, многие продукты, ориентированные на голосовую связь, с самого начала не учитывали пользователей, которые плохо умеют говорить. Пришло время заполнить лазейки.

Сэм Сепах, главный менеджер по продуктам Google для исследования доступности, упомянул в интервью Forbes, что их цель — сделать язык жестов универсальным языком при использовании продуктов Google.

Фактически, это также должно быть целью всего Интернета — сделать язык жестов универсальным языком в цифровом мире.

Будучи программой для изучения языков, Duolingo предоставляет каждому равные возможности для получения образования. Продукты языка жестов ИИ заставляют людей чувствовать, что ограничения, которых не должно быть, снимаются, и люди могут общаться друг с другом повсюду.

Чем более могущественным становится ИИ, тем больше мы должны ценить человечество

В мае, когда был выпущен GPT-4o, очень трогательным был демонстрационный видеоролик GPT-4o, выполнявший роль глаз, позволяющий слабовидящим «видеть» окружающую среду.

Слабовидящий человек узнает из уст ИИ, что над Букингемским дворцом развеваются флаги, в реке неторопливо играют утки и вот-вот подъедет такси. Уголки его рта поднимаются в ответ на веселый тон ИИ.

Как говорится, технологии открывают дверь в новый мир. Можно ли наоборот понять, что люди с ограниченными возможностями изначально жили в мире, который не был предназначен для них?

Данные ВОЗ показывают, что 430 миллионов человек во всем мире нуждаются в реабилитационном лечении для решения проблемы потери слуха, приводящей к инвалидности. Число переводчиков жестового языка далеко от достаточного. В Соединенных Штатах соотношение пользователей с нарушениями слуха и переводчиков американского жестового языка составляет примерно 50 к 1.

Так что на данный момент язык жестов ИИ играет лишь вспомогательную роль и вишенку на торте и еще не дошел до точки «кражи рабочих мест».

Упомянутые выше продукты искусственного языка жестов в основном мелкомасштабны, вертикальны и укоренены в определенных регионах, что компенсирует недоступность переводчиков-людей.

В прошлом месяце я также увидел крутой продукт на языке жестов с искусственным интеллектом.

Исследователи из Университета Рутгерса, Университета Карнеги-Меллона и нескольких других университетов обработали общедоступные видео на языке жестов в набор данных, содержащий 8 языков жестов, и обучили SignLLM, первую многоязычную модель создания языка жестов.

Он охватывает множество языков жестов и может генерировать языки жестов с помощью слов текстовых подсказок. Разве это не очень удобно? Однако исследователи заявили, что внешний мир не должен преувеличивать результаты своих исследований. Демонстрационное видео не является прямым результатом работы модели, и его по-прежнему очень сложно создать.

В то же время некоторые слабослышащие эксперты заявили, что качество сурдоперевода в этих видео разное. Некоторые из них наполовину непонятны, некоторые совершенно непонятны и лишены мимики. У проекта есть потенциал, но он есть. необходимо улучшить.

Самое главное — дать возможность слабослышащим пользователям участвовать, выражать свое мнение и совместно улучшать продукт, потому что «без нашего участия не будет никаких решений о нас».

Есть тонкое ощущение, что сделать безбарьерную продукцию «сексуальной» сложно.

Они часто не так интересны, как выпуск крупных моделей и аппаратного обеспечения ИИ. Они всегда рассказывают вам, какие функции у них есть и кому они служат. Они надеются добиться большего в будущем и не будут «кусать больше, чем могут прожевать».

И в глазах венчурного капитала они также являются нишевыми, обладают неизвестным потенциалом и могут не иметь окупаемости инвестиций.

Но «Крестная мать ИИ» Ли Фейфэй однажды сказала, что ИИ призван помогать людям. Чем могущественнее ИИ, тем больше мы должны ценить человечество.

Каждый не должен бояться опоздать на рейс, каждый должен иметь возможность взаимодействовать с продуктами и каждый должен получать удовольствие от музыкальных фестивалей.

Те вещи, которые когда-то были невидимыми и неслышимыми, также должны быть освещены светом технологий. Давайте щелкнем пальцами в резонансе, чтобы потребности большего числа людей могли быть удовлетворены, способности большего числа людей могли быть улучшены, чтобы мы могли больше выиграть и меньше потерять.

# Добро пожаловать на официальную общедоступную учетную запись WeChat Aifaner: Aifaner (идентификатор WeChat: ifanr). Более интересный контент будет предоставлен вам как можно скорее.

Ай Фанер | Исходная ссылка · Посмотреть комментарии · Sina Weibo