Стенограмма интервью Джен-Сюня Хуана объемом 20 000 слов: Я надеюсь, что у Nvidia будет 50 000 сотрудников и 100 миллионов помощников с искусственным интеллектом

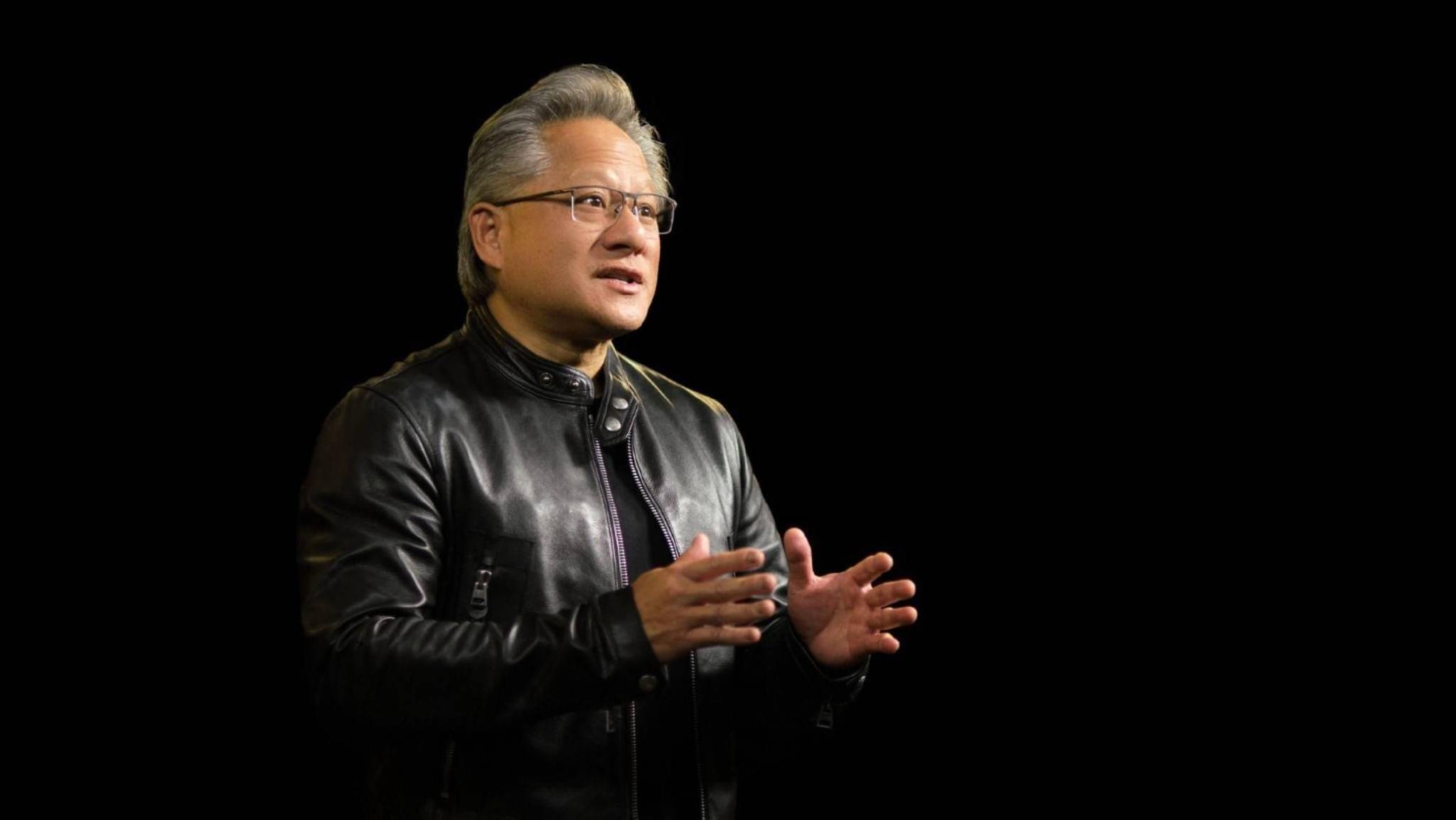

Генеральный директор NVIDIA Джен-Сун Хуанг недавно посетил диалог «Открытый исходный код», проводимый раз в две недели, и обсудил с Брэдом Герстнером и партнером Altimeter Кларком Тангом тему содействия развитию интеллекта в направлении общего искусственного интеллекта (AGI) .

Будучи глубоко вовлеченным в область искусственного интеллекта и машинного обучения на протяжении многих лет, Хуан Жэньсюнь оценивает текущее состояние и перспективы развития искусственного интеллекта очень точно: это полная революция.

Рассуждение переживает взрывной рост, спрос на модели с открытым исходным кодом растет, и постоянно внедряется полностью совместимая инфраструктура искусственного интеллекта… В эпоху популярности искусственного интеллекта у Хуан Ренсюня возникла смелая идея: он надеется, что у NVIDIA будет 50 000 сотрудников и 100 миллионов ИИ-помощников в будущем.

Когда дело доходит до конкурентных барьеров и позиционирования NVIDIA в современном мире искусственного интеллекта, Хуан Дженсен очень уверен в своих преимуществах и имеет значительные амбиции: NVIDIA лучше всех разбирается в алгоритмах, и наша миссия — создать вездесущий искусственный интеллект для нового мира. вычислительная платформа.

Конечно, в отличие от конкуренции за долю рынка, эти амбиции касаются только « эксплуатации ».

В интервью, которое длилось почти полтора часа, Хуан дал подробный анализ того, как машинное обучение меняет компьютерный мир, как ИИ вызывает беспрецедентную технологическую революцию и, в конечном итоге, запускает огромную волну революции. Кроме того, также рассматриваются такие темы, как безопасность искусственного интеллекта и споры об открытом исходном коде.

Под, казалось бы, холодной кожаной курткой скрывается страстное первоначальное намерение Хуан Жэньсюня в области искусственного интеллекта: я серьезно буду относиться к своей работе, своим обязанностям, своему социальному вкладу и эпохе, в которой мы живем.

Информационная плотность этого интервью довольно высока, а дискуссия об индустрии искусственного интеллекта беспрецедентно глубока. Не пропустите!

Ссылка на оригинальное видео интервью:

Мы кратко резюмируем основные тезисы Хуан Дженсюня в этом интервью следующим образом:

- Персональные ИИ-помощники появятся в ближайшее время и со временем будут развиваться;

- Мы перешли от человеческого программирования к машинному обучению, при этом инновации и рост происходят во всем стеке технологий;

- Содействие ускоренной эволюции ИИ требует ускорения каждой части «маховика»;

- Будущее вычислений (разработка приложений) будет во многом зависеть от машинного обучения и искусственного интеллекта, и появятся агенты, которые помогут людям использовать эти приложения;

- ИИ не заменит рабочие места, он изменит их и окажет глубокое влияние на то, как люди думают о работе;

- Безопасность ИИ является основой. Она не обязательно требует отдельного законодательства для каждой важной технологии и не допускает чрезмерного распространения регулирования на ненужные области;

- Должна существовать модель открытого исходного кода для содействия созданию ИИ. Открытый исходный код необходим для активизации многих отраслей;

Ниже приводится полный текст интервью, составленный APPSO:

Переход от человеческого программирования к машинному обучению

Брэд Герстнер: Сегодня пятница, 4 октября, и мы находимся в штаб-квартире Nvidia, недалеко от Альтиметра. В понедельник мы проведем нашу ежегодную встречу с инвесторами, чтобы обсудить все последствия искусственного интеллекта и наш прогресс в том, как быстро мы можем масштабировать интеллект.

Я действительно не могу придумать лучшего человека для начала этого разговора, чем вы, и как акционер, и как наш интеллектуальный партнер, а обмен идеями с вами всегда делает нас умнее. Мы благодарны за эту дружбу, поэтому спасибо, что заглянули.

Дженсен Хуан : Я рад быть здесь.

Брэд Герстнер: Тема этого года — «Расширение интеллекта до общего искусственного интеллекта» (AGI).

Что шокирует, так это то, что когда мы делали это два года назад, темой была эра искусственного интеллекта, и это было за два месяца до выпуска ChatGPT. Действительно удивительно думать обо всех этих изменениях. Поэтому я подумал, что мы могли бы начать с мысленного эксперимента и, возможно, сделать предсказание.

Если я понимаю общий искусственный интеллект (AGI) просто как личного помощника в кармане, то, насколько я понимаю, он знает обо мне все, имеет обо мне прекрасную память, может общаться со мной, может забронировать для меня отель и даже записал меня на прием к врачу. По вашему мнению, мир сегодня меняется так быстро, как вы думаете, когда мы сможем иметь в своем кармане такого рода личного помощника?

Дженсен Хуанг: Скоро это появится в той или иной форме. Этот помощник со временем становится все лучше и лучше. В этом красота технологии, какой мы ее знаем. Поэтому я думаю, что это будет очень полезно, когда вы только начинаете, но оно не идеально. И со временем становится все лучше и лучше. Как и всякая техника.

Брэд Герстнер: Когда мы смотрим на скорость изменений, я помню, как Илон говорил, что единственное, что имеет значение, — это скорость изменений. Мы действительно чувствуем, что темпы изменений значительно ускорились, это самые быстрые темпы изменений, которые мы когда-либо видели по этим вопросам, потому что мы работаем в области ИИ уже около десяти лет, а вы еще дольше. Это самый быстрый темп перемен, который вы когда-либо видели в своей карьере?

Дженсен Хуанг: Да, потому что мы заново изобрели компьютеры. Эти изменения во многом связаны с тем, что за последние 10 лет мы сократили предельные затраты на вычисления в 100 000 раз. Если рассчитать по закону Мура, то этот процесс улучшится примерно в 100 раз, но мы достигли гораздо большего. Мы достигаем этого несколькими способами.

Во-первых, мы ввели ускоренные вычисления для передачи работы, которая неэффективна для ЦП, на ГП.

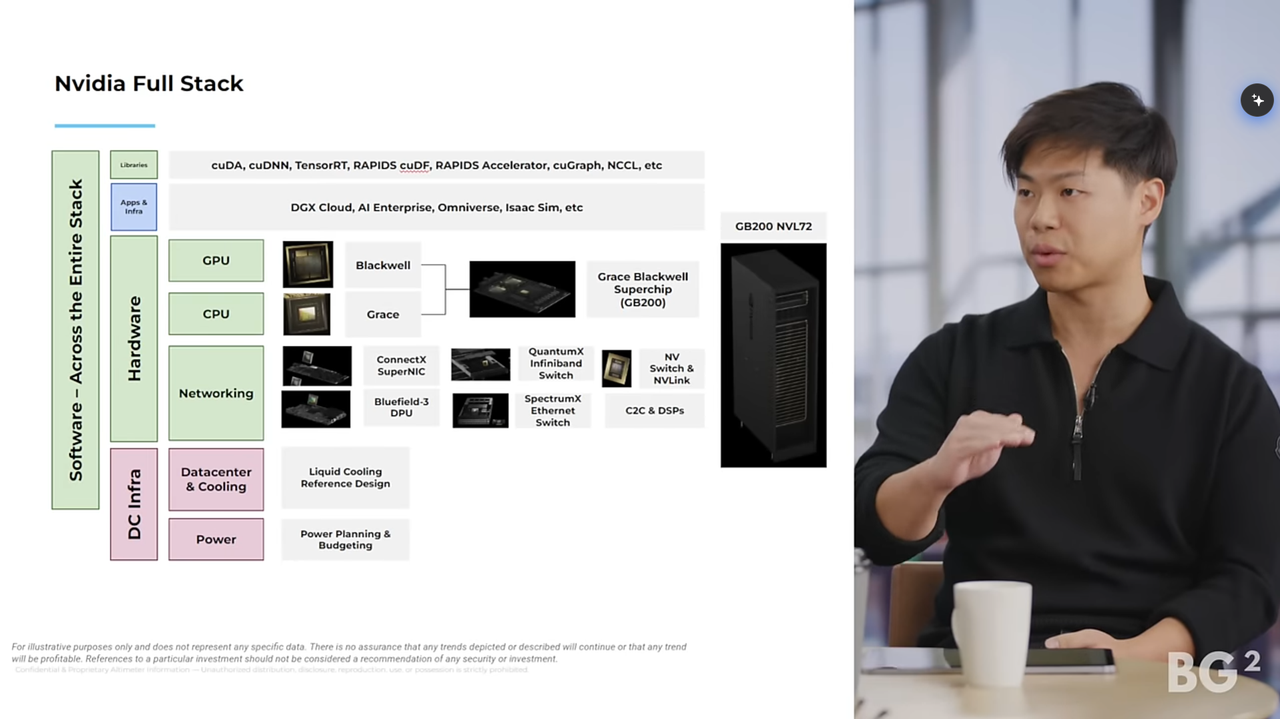

Во-вторых, мы изобрели новую числовую точность, разработали новую архитектуру, разработали интеграционные ядра, улучшили способ построения систем, добавили в MVLink сверхбыструю память (HBM) и реализовали полнофункциональное расширение с помощью MVLink и InfiniBand. По сути, все детали, которые я описал о том, как Nvidia работает, способствуют темпу инноваций , превышающему закон Мура .

Что действительно удивительно, так это то, что благодаря этому мы перешли от человеческого программирования к машинному обучению.

И самое удивительное в машинном обучении то, что оно обучается очень быстро. Итак, когда мы переопределяем распределение вычислений, у нас появляется множество форм параллельной обработки: тензорный параллелизм, конвейерный параллелизм и всевозможные методы параллельных вычислений. На этой основе мы изобрели новые алгоритмы и разработали новые методы обучения. Все эти изобретения взаимодополняли друг друга.

Когда-то, если вы посмотрите, как работал закон Мура, программное обеспечение было статичным. Он спроектирован так, чтобы существовать статически, как упакованный продукт, в то время как аппаратное обеспечение развивается со скоростью закона Мура. Сейчас весь наш технологический стек растет, и весь этот стек является инновационным. Я думаю, что это статус-кво.

Теперь внезапно мы наблюдаем удивительное расширение и, конечно же, невероятные изменения. Но раньше мы говорили о предварительно обученных моделях и масштабировании на этом уровне, как за счет удвоения размера модели, а также удвоения объема данных.

Таким образом, требуемая вычислительная мощность увеличивается в четыре раза каждый год. В то время это было большим событием. Но теперь мы видим расширение на этапе после обучения, мы также видим расширение на этапе вывода, верно? Раньше люди думали, что предварительное обучение — это сложно, а вывод — относительно легко.

Мысль о том, что сейчас все сложнее, на самом деле разумна, ведь было бы абсурдно сводить все человеческое мышление к одноразовому процессу. Поэтому в мышлении должны существовать такие понятия, как быстрое мышление и медленное мышление, рассуждение, размышление, итерация, моделирование и т. д., и сейчас эти понятия постепенно интегрируются.

Кларк Танг: Я думаю, что одна из самых неправильно понятых вещей о Nvidia на данный момент — это то, насколько реальным технологическим преимуществом обладает Nvidia, верно? Я думаю, бытует мнение, что если кто-то изобретет новый чип или чип получше, он победит.

Но дело в том, что за последнее десятилетие вы создавали весь стек технологий, от графических процессоров до центральных процессоров и сетей, особенно программное обеспечение и библиотеки, которые позволяют приложениям работать на платформах NVIDIA. Как вы думаете, технологическое преимущество Nvidia сегодня больше или меньше, чем три-четыре года назад?

Дженсен Хуанг: Я ценю ваше понимание того, что компьютерные технологии изменились. Фактически, причина, по которой люди думали (и многие до сих пор думают), что этого будет достаточно для разработки лучшего чипа, заключалась в том, что у него было больше чисел с плавающей запятой, больше переворотов, байтов и битов, вы понимаете, о чем я? Если вы посмотрите на их основные слайды, то увидите, что они полны операций переворота и операций с плавающей запятой, а также различных гистограмм, диаграмм и тому подобного.

Все это хорошо, я имею в виду, что, конечно, производительность имеет значение, поэтому в принципе они имеют значение. Однако, к сожалению, это старый образ мышления. Поскольку в то время программное обеспечение представляло собой просто приложение, работающее в Windows, оно было статичным, а это означало, что лучший способ улучшить свою систему — это создавать все более быстрые чипы.

Но мы понимаем, что машинное обучение — это не человеческое программирование. Машинное обучение — это не только программное обеспечение, это весь путь передачи данных. На самом деле, маховик, лежащий в основе машинного обучения, — это самое важное. Итак, как вы думаете о том, чтобы дать возможность ученым и исследователям данных эффективно работать в рамках этого маховика, одновременно продвигая его вперед? И этот маховик запускается с самых ранних стадий.

Многие люди даже не осознают, что ИИ на самом деле необходим для организации данных и обучения другого ИИ. Да и сам ИИ уже достаточно сложен.

▲Скоро так или иначе появятся персональные ИИ-помощники (Источник: NITCO)

Ускоряйте каждый шаг маховика

Брэд Герстнер: Значит, он улучшается? Он тоже ускоряется? Знаете, когда мы снова думаем о конкурентном преимуществе, верно? На самом деле это совокупный эффект всех этих факторов.

Дженсен Хуан: Совершенно верно, именно благодаря более умному ИИ для организации данных теперь у нас даже есть генерация синтетических данных и различные способы организации и представления данных. Итак, прежде чем приступить к обучению, вам уже предстоит провести большую обработку данных. И люди всегда думают о PyTorch как о начале и конце всего мира.

Это действительно важно, но не забывайте, что перед использованием PyTorch предстоит много работы, и после использования PyTorch предстоит много работы. И идея маховика — это на самом деле то, как о ней следует думать. Знаете, как мне думать обо всем этом маховике? Как мне спроектировать вычислительную систему, вычислительную архитектуру, которая поможет вам заставить этот маховик работать максимально эффективно? Это не единственный этап применения обучения, верно? Это всего лишь один шаг, ясно?

Каждый шаг маховика сложен, поэтому первое, о чем вам следует думать, это не о том, как заставить Excel работать быстрее или как заставить Doom работать быстрее, это старый способ делать что-то, не так ли?

Теперь все, о чем вам нужно подумать, это как сделать этот маховик быстрее. И в этом маховике много разных шагов, и, как вы знаете, в машинном обучении нет ничего простого, и нет ничего простого в том, что делает OpenAI, или что делает X, или что делают команда Gemini и DeepMind. Все просто.

Поэтому мы решили, что это то, о чем вам действительно стоит задуматься. Это весь процесс, и вам нужно ускорить каждую его часть. Вы должны соблюдать закон Амдала. Закон Амдала говорит вам, что если эта часть займет 30% времени и я ускорю ее в 3 раза, я не ускорю весь процесс слишком сильно, понимаете?

Вам действительно необходимо создать систему, которая ускоряет каждый шаг, и только ускорив весь процесс, вы действительно сможете значительно улучшить время цикла, а этот маховик скорости обучения в конечном итоге и приводит к экспоненциальному росту.

Я хочу сказать, что точка зрения компании на самом деле отражается в ее продуктах. Заметьте, я продолжаю говорить об этом маховике.

Кларк Танг: Вы имеете в виду весь цикл.

Дженсен Хуанг: Верно, и сейчас мы все ускоряем. Сейчас основное внимание уделяется видео. Многие люди сосредоточены на физическом искусственном интеллекте и обработке видео. Просто подумайте о внешнем интерфейсе: терабайты данных поступают в систему каждую секунду. Приведите пример, как работает конвейер обработки этих данных, от приема данных до подготовки к обучению, и все это с CUDA-ускорением.

Кларк Танг: Сейчас люди думают только о текстовых моделях, но в будущем они будут включать и видеомодели, а также использовать некоторые текстовые модели, такие как o1, для обработки большого количества данных, прежде чем мы начнем обработку.

Джен-Сун Хуанг: Языковые модели будут охватывать все области. Индустрия тратит много технологий и усилий на обучение языковых моделей для обучения этих больших языковых моделей. Теперь мы используем меньшие вычислительные затраты на каждом этапе. Это действительно замечательно.

Брэд Герстнер: Я не хочу упрощать это, но мы часто слышим этот вопрос от инвесторов, не так ли? Да, а как насчет кастомных чипов? Да, но будут ли в результате разрушены их конкурентные барьеры?

Я слышу, как вы говорите, что в этой комбинированной системе преимущества со временем растут. Итак, я слышу, как вы говорите, что сегодня у нас больше преимуществ, чем три или четыре года назад, потому что мы улучшаем каждый компонент. И этот эффект комбинации означает, что, как вы знаете, если рассматривать бизнес-кейс, Intel раньше доминировала в стеке технологий, и где вы сегодня находитесь по сравнению с ними?

Может быть, просто кратко подведем итоги и сравним ваше сегодняшнее конкурентное преимущество с тем, каким оно было на пике популярности.

Дженсен Хуанг: Intel – это выдающаяся компания. Intel выдающаяся компания, потому что они, вероятно, были первой компанией, которая чрезвычайно хорошо разобралась в разработке производственных процессов и производстве, а следующим шагом после производственного процесса является проектирование чипов, верно? Они спроектировали чипы, создали архитектуру x86 и продолжают производить более быстрые чипы x86. В этом их хитрость. Они совмещают это с производственными процессами.

Наша компания немного отличается, поскольку мы понимаем, что параллельная обработка на самом деле не требует идеальности каждого транзистора. Последовательная обработка требует, чтобы каждый транзистор был идеальным, тогда как параллельная обработка требует большого количества транзисторов для достижения большей экономической эффективности.

Я бы предпочел иметь в 10 раз больше транзисторов и работать на 20% медленнее, чем иметь в 10 раз меньше транзисторов и работать на 20% быстрее. Вы понимаете? Они предпочитают противоположное, поэтому однопоточная производительность и однопоточная обработка сильно отличаются от параллельной обработки. Итак, мы понимаем, что наш мир на самом деле не направлен на то, чтобы стать лучше. Мы хотим быть как можно лучше, но то, что действительно заботит наш мир, — это улучшение.

Параллельные вычисления, параллельная обработка сложны, потому что каждый алгоритм необходимо реорганизовать и перепроектировать по-разному в зависимости от архитектуры. Чего люди не осознают, так это того, что у вас может быть три разных процессора, каждый со своим собственным компилятором C, и вы можете компилировать программное обеспечение в соответствии с соответствующей ISA (архитектурой набора команд). Это невозможно ни в ускоренных вычислениях, ни в параллельных вычислениях.

Компании, разработавшей архитектуру, пришлось разработать собственный OpenGL. Итак, мы произвели революцию в глубоком обучении , потому что у нас была специализированная библиотека под названием CUDNN. Без CUDNN сегодня не было бы глубокого обучения.

Никто не говорит о CUDNN, потому что это слой под PyTorch и TensorFlow. Раньше были Caffe и Theano, теперь есть Triton и много разных фреймворков. Эта предметно-ориентированная библиотека, такая как CUDNN и Optics, предметно-ориентированная библиотека под названием CuQuantum, Rapids и многие другие.

Брэд Герстнер: Специфические для отрасли алгоритмы находятся под тем слоем PyTorch, на котором все сосредоточены. Например, я часто слышу, как люди говорят, что если бы не было этих базовых библиотек…

Дженсен Хуанг: Если бы мы его не изобрели, ни одно из приложений верхнего уровня не смогло бы работать. Вы понимаете, что я говорю? С математической точки зрения, NVIDIA действительно хороша в алгоритмах, сочетающих в себе науку верхнего уровня и архитектуру нижнего уровня. Это то, в чем мы действительно хороши.

▲Хуан Ренсюнь в интервью

Мы вступили в эпоху рассуждений

Кларк Танг: Теперь все внимание наконец сосредоточено на рассуждениях. Но я помню, как два года назад мы с Брэдом ужинали с вами и задали вам вопрос: думаете ли вы, что технологическое преимущество Nvidia будет таким же сильным в умозаключениях, как и в обучении?

Дженсен Хуанг: Я определенно сказал, что будет сильнее.

Кларк Танг: Вы только что упомянули множество факторов, таких как модульные комбинации и различные комбинации сборок, которые иногда мы не до конца понимаем. Клиентам важно иметь возможность гибко переключаться между ними. Но не могли бы вы поговорить об этом подробнее сейчас, когда мы вступили в эпоху рассуждений?

Дженсен Хуан: Рассуждение — это масштабная тренировка рассуждения, верно? Итак, если вы хорошо тренируетесь, скорее всего, ваши рассуждения тоже будут хорошими. Если вы тренируетесь на этой архитектуре без каких-либо изменений, она сможет работать на этой архитектуре.

Конечно, вы все еще можете оптимизировать систему для других архитектур, но, по крайней мере, поскольку она уже построена на архитектуре NVIDIA, она будет работать на архитектуре NVIDIA.

Другой аспект, конечно же, — это аспект капиталовложений. Когда вы тренируете новую модель, вам захочется использовать для обучения новейшее и лучшее оборудование, которое оставит позади оборудование, которое использовалось раньше. И эти устройства отлично подходят для умозаключений. Поэтому будет свободный путь устройства.

За новой инфраструктурой стоит цепочка бесплатных инфраструктурных устройств, совместимых с CUDA. Поэтому мы очень строго следим за совместимостью на протяжении всего процесса, чтобы оборудование, которое мы оставляем после себя, сохраняло отличную производительность.

В то же время мы также вложили много энергии в постоянное изобретение новых алгоритмов, чтобы гарантировать, что, когда придет время, производительность архитектуры Hopper будет в 2–4 раза выше, чем при ее первой покупке, чтобы инфраструктура может продолжать оставаться эффективным.

Итак, вся работа, которую мы делаем в плане улучшения новых алгоритмов, новых фреймворков, не только помогает каждой из наших установленных инфраструктур, для этого лучше подходит Hopper, лучше Ampere и даже Volt.

Я помню, как Сэм только что сказал мне, что они недавно удалили свою инфраструктуру Volt из OpenAI. Итак, я думаю, мы оставляем следы этой установленной инфраструктуры. Как и в случае с любой другой вычислительной инфраструктурой, важно ее установить.

Продукты NVIDIA доступны в каждом облаке, локально и на всех периферийных устройствах. Таким образом, модель визуального языка Vela, созданная в облаке, может идеально работать на периферийном роботе без изменений. В основе всего этого лежит CUDA. Итак, я думаю, что концепция архитектурной совместимости очень важна для крупных проектов. Это ничем не отличается от концепции совместимости iPhone или других устройств.

Я думаю, что установка инфраструктуры очень важна для вывода, но что мы действительно выигрываем, так это то, что, поскольку мы обучаем эти большие языковые модели на новых архитектурах, мы можем думать о том, как создавать очень хорошие архитектуры вывода в будущем.

Итак, мы думали об итеративных моделях и моделях вывода, о том, как создать очень интерактивный опыт вывода для вашего личного агента, например, как быстро взаимодействовать с вами, когда ему нужно остановиться и немного подумать.

Итак, как нам этого добиться? Ответ — НВЛинк. Вы знаете, NVLink позволяет нам использовать эти системы, подходящие для обучения, но когда обучение завершено, его производительность вывода также очень хороша. Что вы хотите оптимизировать, так это время ответа для первого токена, а добиться времени ответа для первого токена очень сложно, поскольку для этого требуется большая полоса пропускания.

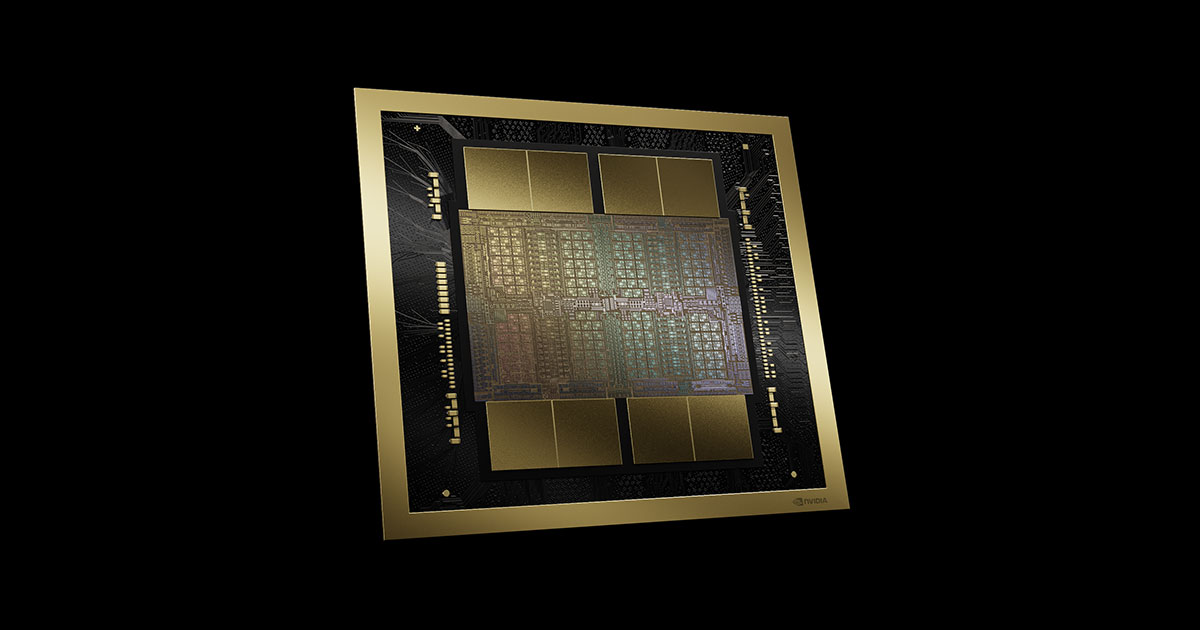

Если ваш контекст также очень богат, вам также потребуется много вычислительной мощности. Таким образом, вам нужна неограниченная пропускная способность и вычислительная мощность одновременно, чтобы добиться времени отклика в несколько миллисекунд. И такую архитектуру очень сложно реализовать. По этой причине мы изобрели Grace Blackwell NVLink.

▲Архитектура NVIDIA Blackwell (Источник: NVIDIA)

NVIDIA создает полноценную совместимую инфраструктуру искусственного интеллекта

Брэд Герстнер: Знаете, ранее на этой неделе я ужинал с Энди Джасси, и Энди сказал: «У нас есть Траниум и скоро появится Инференсия». Я думаю, что большинство людей все еще считают, что это проблема для Nvidia.

Но затем он сказал: «Nvidia является для нас очень важным партнером и будет продолжать оставаться для нас очень важным партнером в будущем, по крайней мере, в будущем, которое я могу предвидеть».

Мир работает на NVIDIA, верно? Поэтому, когда вы думаете об этих специальных ASIC, разрабатываемых для конкретных приложений, таких как ускорители вывода Meta, Tranium от Amazon или TPU от Google, а также о нехватке поставок, с которой вы сейчас сталкиваетесь, эти факторы меняют динамику между вами, или они просто. дополнение к вашей системе?

Дженсен Хуанг: Мы просто делаем разные вещи, пытаемся достичь разных целей. NVIDIA пытается создать вычислительную платформу для этого нового мира, этого мира машинного обучения, этого мира генеративного ИИ, этого мира агентного ИИ.

Мы хотим добиться того, чтобы после 60 лет вычислений мы заново изобрели весь стек вычислений: от способа программирования до машинного обучения, от способа обработки программного обеспечения от центральных процессоров до графических процессоров, от способа применения программного обеспечения к искусственному интеллекту. верно? Программные инструменты, искусственный интеллект — каждый аспект вычислительного стека, каждый аспект технологического стека изменился.

Мы хотим создать повсеместную вычислительную платформу, и именно в этом заключается сложность нашей работы. Если подумать о том, что мы делаем, то мы создаем полноценную инфраструктуру искусственного интеллекта и думаем о ней как о компьютере.

Я уже говорил ранее, что центр обработки данных теперь является фундаментальной единицей вычислений. Что касается меня, когда я думаю о компьютере, я не думаю о чипе, я думаю о концепции: это моя мысленная модель со всем программным обеспечением, всем программированием, всеми механическими частями. Это моя миссия, это мой компьютер, и каждый год мы пытаемся создать совершенно новый компьютер.

Да, это безумие, никто такого раньше не делал. Каждый год мы пытаемся создать совершенно новый компьютер и каждый год увеличиваем производительность в два-три раза. Ежегодно мы сокращаем затраты в два-три раза и каждый год повышаем энергоэффективность в два-три раза.

Поэтому мы говорим нашим клиентам: не покупайте все оборудование сразу, покупайте каждый год понемногу, хорошо? Причина в том, что мы хотим, чтобы они смогли перейти в будущее, в котором все архитектуры будут совместимы, хорошо?

Сейчас просто построить эту платформу такими темпами очень сложно, и что вдвойне сложно, так это то, что мы не просто продаем инфраструктуру или услуги, мы разбираем их и интегрируем их в GCP, интегрируем их в AWS, интегрируем в Azure. , интегрированный в другие платформы, понимаете?

Интеграция различна для каждой платформы. Нам необходимо интегрировать все архитектурные библиотеки, все алгоритмы и все фреймворки в их системы. Мы интегрируем наши системы безопасности в их системы, мы интегрируем наши сети в их системы, верно? И затем мы делаем около 10 таких интеграций в год. И именно здесь кроется волшебство.

Брэд Герстнер: Это волшебство, почему? Я имею в виду, это безумие. Это действительно безумие, что ты делаешь это каждый год. Подумайте, что заставляет вас делать это каждый год?

И затем, возвращаясь к этому, вы знаете, что Кларк только что вернулся из Тайваня, Кореи и Японии и встретился со всеми вашими партнерами по поставкам – теми, с которыми у вас были отношения более десяти лет. Насколько важны эти партнерства для совокупного эффекта создания конкурентного барьера?

Джен-Сун Хуан: Да, когда вы разбираете это систематически, и чем больше вы разбираете это, удивительно, насколько вся экосистема электронной промышленности стремится работать с нами сегодня, чтобы в конечном итоге построить этот куб компьютера и собрать его воедино в все разные экосистемы? И координация такая гладкая. Очевидно, мы передали API, методологию, бизнес-процессы и правила проектирования назад, а методологию, архитектуру и API — вперед.

Брэд Герстнер: Их укрепляли десятилетиями.

Дженсен Хуан : Он укреплялся на протяжении десятилетий и постоянно развивается. Но эти API приходится интегрировать, когда это необходимо — все эти вещи, которые производятся на Тайване и по всему миру, в конечном итоге попадают в центры обработки данных Azure. Они подойдут друг другу.

Кларк Танг: Кто-то просто вызывает API OpenAI, и он работает.

Джен -Сюнь Хуан: Да, это совершенно сумасшедшее чувство. Это мы изобрели, мы изобрели эту огромную вычислительную инфраструктуру, и весь мир строит ее вместе с нами.

Он интегрирован во все, вы можете продавать его через Dell, вы можете продавать его через HPE, он размещается в облаке и распространяется на периферийные устройства. Люди сейчас используют его в роботизированных системах, в роботах-гуманоидах, в беспилотных автомобилях, все они архитектурно совместимы, и это настоящее безумие.

Кларк, я не хочу, чтобы ты думал, что я не ответил на твой вопрос. На самом деле, я ответил. Я имею в виду ваш ASIC.

Мы, как компания, просто делаем разные вещи. Как компания, мы хотим иметь четкое представление об окружающей среде. Я прекрасно осведомлен обо всем, что связано с нашей компанией и ее экосистемой, верно?

Я знаю всех людей, которые занимаются разными вещами и что они делают. Иногда это конфронтационно для нас, иногда нет. Я это очень хорошо знаю. Но это не меняет целей нашей компании. Единственная цель компании — создать архитектурную платформу, которую можно будет использовать повсюду, и это наша цель.

Мы не пытаемся отобрать долю рынка у кого-либо. NVIDIA — пионер рынка, а не претендент на долю акций. Если вы посмотрите наши корпоративные отчеты, вы увидите, что мы никогда не говорим о доле рынка. Ни дня, чтобы мы не говорили о доле рынка внутри компании.

Все наши дискуссии были о том, как нам создать следующую вещь? Как решить следующую проблему в маховике? Как мы можем сделать лучше для людей? Как нам сократить цикл маховика, который раньше занимал год, до одного месяца? Вы знаете, это скорость света для маховика, верно? Мы думаем обо всех этих разных вопросах, но одно можно сказать наверняка: мы знаем обо всем, что нас окружает, но мы очень четко понимаем свою миссию.

Вопрос лишь в том, является ли эта миссия необходимой и значимой. Все великие компании должны иметь эту миссию.

По сути, вопрос в том, что вы делаете? Вопрос только в том, необходимо ли это, ценно ли это, действенно ли и может ли помочь другим? Я почти уверен, что если вы разработчик, стартап, занимающийся генеративным искусственным интеллектом, и решаете, как стать компанией, единственный выбор, который вам не нужно учитывать, — это то, какой ASIC поддерживать.

Если вы поддерживаете только CUDA, то вы можете использовать его где угодно и всегда можете передумать позже, но мы — точка входа в мир ИИ, не так ли? Как только вы решите присоединиться к нашей платформе, другие решения можно будет отложить, и вы всегда сможете разработать свой собственный ASIC позже, и мы не против.

Когда я работаю с GCP, такими компаниями, как GCP, Azure, мы показываем им нашу дорожную карту на несколько лет вперед. Они не собираются показывать нам свою дорожную карту ASIC, и это нас не оскорбит, ясно? Если ваши цели ясны и значимы, а ваша миссия важна для вас самих и других, вы можете быть прозрачными.

Обратите внимание, что моя дорожная карта общедоступна на GTC, а моя дорожная карта будет более подробной с такими партнерами, как Azure, AWS и т. д. У нас с ними нет никаких сложностей, хотя они разрабатывают свои собственные ASIC.

▲Миссия NVIDIA — создание полноценной и совместимой инфраструктуры искусственного интеллекта (Источник: The Brand Hopper)

ИИ меняет будущее отрасли

Брэд Герстнер: Я думаю, когда люди смотрят на индустрию, вы недавно сказали, что спрос на Блэквелл «сумасшедший». Вы также говорите, что самая тяжелая часть вашей работы — это выдерживать эмоциональное бремя, когда вы говорите «нет» людям в мире, где компьютерных ресурсов недостаточно.

Но критики говорят, что это всего лишь момент времени, и они полагают, что это будет период бума и спада, такой же, как чрезмерное строительство оптоволоконных сетей Cisco в 2000 году. Знаете, я думаю, когда мы вместе ужинали в начале 2023 года, прогноз был, что выручка Nvidia в 2023 году достигнет 26 миллиардов долларов, но на самом деле вы заработали 60 миллиардов долларов, верно?

Дженсен Хуанг: Признайтесь, это самый крупный провал прогнозов, который когда-либо видел мир.

Брэд Герстнер: Мы были особенно взволнованы тогда, в ноябре 2022 года, потому что такие люди, как Мустафа из Inflection и Ноам из Character, пришли к нам в офис, чтобы обсудить инвестирование в их компании. Они сказали: если вы не можете напрямую инвестировать в нашу компанию, тогда купите Nvidia, потому что мир изо всех сил пытается получить чипы Nvidia для создания приложений, которые изменят мир.

Конечно, с появлением ChatGPT наступил этот «кембрийский момент». Однако даже в этом случае эти 25 аналитиков все еще одержимы «криптозимой» и не могут себе представить, что происходит в мире, верно? Так что конечный результат намного превзошёл ожидания.

Вы дали понять, что спрос на Блэквелла безумен и будет таковым и дальше. Конечно, будущее неизвестно и непознаваемо, но почему критики так ошибаются? Это не будет перегруженной ситуацией, как это было в Cisco в 2000 году.

Дженсен Хуанг: Лучший способ думать о будущем — рассуждать, исходя из первых принципов, верно? Итак, вопрос в том, каково обоснование того, что мы делаем сейчас? Во-первых, что мы делаем? Что мы делаем? Мы заново изобретаем компьютеры, не так ли?

Мы только что сказали, что будущее вычислений будет во многом зависеть от машинного обучения, верно? Почти все наши приложения, будь то Word, Excel, PowerPoint, Photoshop, Premiere, AutoCAD, да какой угодно пример, все они разрабатываются вручную. Я гарантирую вам, что в будущем они будут в значительной степени зависеть от машинного обучения, верно?

И помимо этих инструментов у вас будут агенты, которые помогут вам их использовать.

Итак, теперь это факт, верно? Мы заново изобрели компьютеры и не оглядываемся назад. Весь стек вычислительных технологий пересматривается.

Хорошо, теперь, когда мы подошли к этому моменту, мы говорим, что программное обеспечение будет другим, способ написания программного обеспечения будет другим, способ использования программного обеспечения будет другим. Итак, давайте признаем, что это мои основные факты. Да, поэтому вопрос в том, что будет дальше?

Итак, давайте рассмотрим, как проводились расчеты в прошлом. У нас есть компьютерное оборудование на триллион долларов. Если вы посмотрите на центр обработки данных прошлого, откроете дверь и посмотрите на него, скажете ли вы, что это те компьютеры, которые вы хотите использовать, чтобы встретить будущее? Ответ — нет.

Вы видите эти процессоры, мы знаем, что они могут и чего не могут. Мы также знаем, что сейчас существуют центры обработки данных стоимостью в триллион долларов, нуждающиеся в модернизации. Так что прямо сейчас, если мы собираемся модернизироваться в течение следующих четырех или пяти лет, это совершенно разумно и разумно.

Брэд Герстнер: Итак, мы разговаривали с людьми, которым нужна модернизация, и они модернизируются с помощью графических процессоров, да.

Дженсен Хуанг: Я имею в виду, давайте выскажем гипотезу. У вас есть $50 млрд капвложений. Выберете ли вы вариант А: построить капвложения на будущее или вариант Б: построить капвложения по моделям прошлого? Капитальные затраты уже позади, а они просто стоят на месте и все равно лучше не станут.

Закон Мура, по сути, утратил силу, так зачем же его восстанавливать? Нам просто нужно инвестировать эти 50 миллиардов долларов в генеративный искусственный интеллект, верно? Вашей компании так будет лучше. Так какую же часть из 50 миллиардов вы вложите? Я бы вложил в него 100% из 50 миллиардов, потому что у меня есть инфраструктура, которой уже четыре года.

Итак, теперь, исходя из первых принципов, вы просто рассуждаете с этой точки зрения, и это именно то, что они делают. Умные люди делают умные вещи.

Теперь вторая часть такова: у нас есть потенциал на триллион долларов, верно? В инфраструктуру вложено триллион долларов, может быть, 150 миллиардов долларов, верно? Итак, мы собираемся построить инфраструктуру на триллион долларов в ближайшие 4–5 лет.

Второе, что мы заметили, это то, что способы написания программного обеспечения различаются, и способы их использования в будущем будут другими. У нас будут интеллектуальные агенты, не так ли?

В нашей компании будут цифровые сотрудники, и они будут в вашем почтовом ящике, и в будущем эти маленькие точки, эти маленькие аватары станут символами ИИ, верно? Я отправлю им задания. Я больше не программирую на C++, я использую слова-подсказки, чтобы «программировать» ИИ, верно? Это ничем не отличается от того, когда я написал сегодня утром кучу писем.

Я дал инструкции своей команде, верно? Я описал предысторию, указал основные ограничения того, что знал, и описал их миссию. Я даю им достаточно указаний, чтобы они поняли, что мне нужно, и хочу как можно яснее объяснить ожидаемые результаты. Но я также оставляю достаточно места для творчества, чтобы они могли меня удивить, верно?

Это ничем не отличается от того, как я подсказываю ИИ сегодня, именно так я подсказываю ИИ. Таким образом, помимо нашей модернизированной инфраструктуры появится совершенно новая инфраструктура. Эта новая инфраструктура представляет собой фабрику искусственного интеллекта, которая будет управлять этими цифровыми людьми, и они будут работать круглосуточно.

Мы собираемся использовать их во всех компаниях по всему миру, на наших заводах, в наших автоматизированных системах, верно? Итак, миру необходимо построить целый уровень вычислительных структур, то, что я называю инфраструктурой фабрики искусственного интеллекта, которого пока не существует.

Итак, вопрос в том, насколько это велико? Мы пока не знаем, но они могут исчисляться триллионами долларов, но прелесть в том, что архитектура модернизированного центра обработки данных такая же, как архитектура фабрики искусственного интеллекта.

Брэд Герстнер: В этом красота. Вы очень ясно дали понять, что у вас есть устаревшая инфраструктура на триллион долларов, которую необходимо модернизировать, и у вас есть как минимум триллион долларов новых рабочих нагрузок искусственного интеллекта, что составляет около 125 миллиардов долларов дохода в этом году.

Знаете, вам сказали, что стоимость этой компании никогда не превысит 1 миллиард долларов. И теперь вы сидите здесь, если на ваш счет приходится всего лишь 125 миллиардов дохода от общего рынка (ТАМ) в несколько триллионов, какая причина заставляет вас думать, что ваш будущий доход не будет в 2 или 3 раза больше, чем сейчас? Есть ли причина, по которой ваш доход не будет продолжать расти?

Дженсен Хуанг: Нет, это правда. Знаете, дело не в настоящем. Компания ограничена только размером «пруда», знаете ли, золотая рыбка может вырасти только до размеров пруда.

Итак, вопрос в том, насколько велик наш пруд? Это требует большого воображения, поэтому пионеры рынка думают о будущем, а не просто конкурируют в существующем пруду.

Трудно ясно заглянуть в будущее, если вы просто смотрите в прошлое и пытаетесь захватить долю рынка. Претенденты на долю рынка могут стать очень большими, тогда как пионеры рынка могут стать очень большими. Итак, я думаю, что удачей нашей компании является то, что нам пришлось создавать для себя рыночное пространство с первого дня.

В то время люди этого не осознавали, но мы создали рынок игровых 3D-ПК практически с нуля. По сути, мы изобрели этот рынок и все связанные с ним экосистемы, включая экосистему видеокарт. Мы все это придумали. Поэтому создание совершенно нового рынка для его обслуживания — это то, что нам очень знакомо.

▲Брэд Герстнер (слева) и Кларк Танг (справа) в интервью

Невероятный OpenAI и X.AI

Брэд Герстнер: Да, это верно для человека, который изобрел новый рынок. Давайте немного переключим тему и поговорим о моделях и OpenAI. Знаете, на этой неделе OpenAI привлекла 6,5 миллиардов долларов, оценивая их примерно в 150 миллиардов долларов. Мы все участвовали в этом финансировании.

Джен -Хсун Хуан: Я очень рада за них, я очень рада, что все прошло гладко. Да, они проделали отличную работу, и команда проделала отличную работу.

Брэд Герстнер: Есть сообщения, что их доход или темп роста доходов составляет около 5 миллиардов долларов в этом году и может достичь 10 миллиардов долларов в следующем году. Если вы посмотрите на размер бизнеса сегодня, его доход примерно вдвое превышает доход Google во время IPO.

У них 250 миллионов активных пользователей в неделю, что, по нашим оценкам, вдвое превышает число пользователей во время IPO Google. И если вы посмотрите на их бизнес-коэффициент, если вы верите, что они смогут достичь дохода в 10 миллиардов долларов в следующем году, то их рыночная капитализация примерно в 15 раз превысит доход в следующем году, что примерно соответствует тому же коэффициенту, который был у Google и Meta на их IPO, верно? ? Это довольно ошеломляет, если учесть, что 22 месяца назад у этой компании не было дохода и еженедельно активных пользователей.

Дженсен Хуанг: У Брэда поразительное понимание истории.

Брэд Герстнер: Когда вы подумаете об этом, расскажите нам об OpenAI как о вашем партнере и о том, насколько она важна для повышения осведомленности общественности и использования ИИ.

Дженсен Хуанг: Ну, это одна из самых влиятельных компаний нашего времени. Это компания, занимающаяся исключительно искусственным интеллектом, преследующая концепцию общего искусственного интеллекта (AGI).

Каким бы ни было определение AGI, я вряд ли верю, что его определение полностью важно, и я не верю в важность времени. Я точно знаю одно: ИИ со временем продолжит демонстрировать целый ряд возможностей. Дорожная карта развития этих возможностей будет потрясающей. Прежде чем мы перейдем к чьему-либо определению AGI, мы применим его широко.

Что вам нужно сделать сейчас, так это поговорить с цифровыми биологами, исследователями климатических технологий, исследователями материалов, учеными-физиками, астрофизиками, квантовыми химиками. Вы можете пойти к дизайнерам видеоигр, инженерам-технологам, экспертам по робототехнике, выбрать отрасль, которая вам нравится, углубиться в нее, поговорить с этими важными людьми и спросить их, меняет ли ИИ способ их работы? Затем вы возвращаете эти данные и спрашиваете себя, насколько вы скептически настроены?

Поскольку они не говорят о концептуальных преимуществах ИИ когда-нибудь в будущем, они говорят об использовании ИИ сейчас. Будь то сельхозтехнология, технология материалов, климатическая технология, выберите свою область технологий или науки, они развиваются, и искусственный интеллект помогает им продвигать свою работу.

Как мы уже говорили, каждая отрасль, каждая компания, каждый университет используют ИИ. Это невероятно, не правда ли? Это определенно каким-то образом изменит бизнес, мы это знаем, верно? Я имею в виду, что это изменение настолько реально и происходит. Поэтому я считаю, что пробуждение ИИ, вызванное ChatGPT, совершенно невероятно. Мне нравится их скорость и их единственная цель — продвигать поле, так что это действительно впечатляет.

Брэд Герстнер: Они создали двигатель, который сможет финансировать модели следующего поколения. Я думаю, что в Кремниевой долине растёт понимание того, что весь уровень моделей становится товаром, и Llama позволяет многим людям создавать модели по очень низкой цене.

Итак, вначале у нас было много модельных компаний, таких как «Character», «Inflection», «Cohere», «Mistral» и так далее. Многие задаются вопросом, смогут ли эти компании достичь «скорости убегания» экономического двигателя и продолжать финансировать модели следующего поколения. Я считаю, что именно поэтому мы наблюдаем консолидацию на рынке, верно?

Очевидно, что OpenAI достигла той «скорости бегства», при которой они могут финансировать свое будущее. Но мне не ясно, смогут ли это сделать многие другие компании. Это честный обзор текущего состояния слоя модели? Как мы видели на многих других рынках, у лидеров рынка будет экономический двигатель и приложение, позволяющее им продолжать инвестировать.

Дженсен Хуанг: Прежде всего, между моделями и искусственным интеллектом есть фундаментальная разница, верно? Модели — необходимый, но недостаточный компонент искусственного интеллекта, верно? Искусственный интеллект — это возможность, но для чего? Что такое приложение?

Искусственный интеллект беспилотных автомобилей похож на искусственный интеллект человекоподобных роботов, но это не одно и то же. Они связаны с искусственным интеллектом чат-бота, но это не одно и то же, верно? Поэтому вам необходимо понять классификацию этого стека. Возможности есть на каждом уровне стека, но не каждый уровень имеет неограниченные возможности.

Я только что сказал кое-что, и все, что вам нужно сделать, это заменить слово «модель» на «GPU». Фактически, 32 года назад наша компания сделала главное открытие: существует фундаментальная разница между графическими чипами GPU и ускоренными вычислениями. Ускоренные вычисления отличаются от того, что мы делаем в инфраструктуре искусственного интеллекта, и, хотя они и связаны, это не совсем то же самое. Они построены друг на друге, но не идентичны. Каждый уровень абстракции требует совершенно разных навыков.

Тот, кто очень хорошо разбирается в создании графических процессоров, может понятия не иметь, как стать компанией, занимающейся ускоренными вычислениями. Многие люди создают графические процессоры, и мы изобрели графические процессоры, но мы не единственные, кто сегодня производит графические процессоры, верно? В мире существует множество графических процессоров, но не все из них являются компаниями, занимающимися ускоренными вычислениями. Существует множество приложений-ускорителей, но это не то же самое, что компании, занимающиеся ускоренными вычислениями. Например, очень специализированное приложение ИИ может оказаться очень успешным.

Брэд Герстнер: Это MTIA.

Дженсен Хуанг: Верно, но она, возможно, не станет компанией с широким охватом и возможностями. Поэтому вам придется решить, где вы хотите быть. В этих различных областях могут быть возможности, но, как и в случае с созданием компании, вы должны обращать внимание на изменения в экосистеме и на то, что с течением времени становится товаром, что такое функция, что такое продукт, что такое компания. определенный. Ну, я просто затронул много разных тем.

Брэд Герстнер: Конечно, есть новый участник, у которого есть деньги, ум и амбиции, и это X.AI, верно? По слухам, вы ужинали с Ларри и Илоном. Они отговорили вас от 100 000 H100, поехали в Мемфис и за считанные месяцы построили огромный суперкомпьютерный кластер.

Дженсен Хуан: Прежде всего, эти три точки не находятся на одной линии. Я ужинал с ними. Причинно-следственная связь такая.

Брэд Герстнер: Что вы думаете об их способности создавать суперкомпьютерные кластеры? До сих пор обсуждается, что они хотят добавить еще 100 000 H200, чтобы расширить размер этого суперкластера.

Сначала расскажите нам об амбициях компании X и о том, чего они достигли. В то же время, вступили ли мы в эпоху 200 000 или 300 000 кластеров графических процессоров?

Дженсен Хуан: Ответ – да. Начните с признания того, что их достижения заслужены. От этапа разработки концепции до построения центра обработки данных, готового к установке оборудования NVIDIA, до подачи питания на него, подключения оборудования и проведения первого обучения.

Прежде всего, построить такой огромный завод, используя технологию жидкостного охлаждения, завершить энергоснабжение, получить разрешения и завершить его в такой короткий период времени. Я имею в виду, это просто сверхчеловеческое достижение. Насколько я знаю, в мире есть только один человек, который может это сделать. Понимание Илоном Маском инженерии, архитектуры, крупномасштабных систем и мобилизации ресурсов уникально и просто невероятно.

Конечно, его инженерная команда тоже очень хороша: команда программного обеспечения, сетевая команда, команда инфраструктуры — все великолепны. Илон это глубоко понимает. С того момента, как мы решили запустить проект, наша инженерная команда, сетевая команда, команда инфраструктурных вычислений и команда программного обеспечения были полностью готовы.

Затем вся инфраструктура, логистика, объем данных и оборудования, поступивших в тот день, а также инфраструктура и вычислительные технологии Nvidia — все было обучено за 19 дней.

Знаете ли вы, что это значит? Кто-нибудь спит? Работаем 24 часа в сутки, никто не спит, сомнений нет. Во-первых, 19 дней — это невероятно, но если оглянуться назад и подумать, это всего лишь вопрос недель. Количество технического оборудования, которое вы увидите, просто невероятно.

Все кабели и сети, работа в сети с использованием оборудования Nvidia полностью отличается от сети в гипермасштабном центре обработки данных. Количество проводов на узле, задняя часть компьютера — все провода. Просто объединить эту вершину технологии вместе со всем программным обеспечением — это просто невероятно.

Поэтому я считаю, что то, что сделали Илон и его команда, потрясающе, и я благодарен, что он высоко оценил нашу с ними работу в области проектирования и планирования. Но то, чего они достигли, было уникальным и беспрецедентным.

Чтобы дать вам лучшее представление: это, без сомнения, самый быстрый суперкомпьютер на планете со 100 000 графических процессоров. Это всего лишь кластер. Обычно планирование суперкомпьютера занимает три года, верно? Затем доставьте оборудование и потратьте год на его запуск. И мы говорим о 19 днях.

▲Пробуждение ИИ, вызванное ChatGPT, невероятно (Источник: artnet)

Рассуждение вот-вот взорвется

Кларк Танг: Каковы преимущества платформы NVIDIA? Весь процесс ужесточен, верно?

Дженсен Хуанг: Да, все уже работает. Конечно, существует множество X-алгоритмов, X-фреймворков и X-стеков, и нам еще предстоит провести большую интеграцию. Но предварительное планирование было настолько хорошим, что одно только предварительное планирование производило впечатление.

Брэд Герстнер: Илон уникален, но когда вы только что ответили, вы упомянули, что уже существует от 200 000 до 300 000 кластеров графических процессоров, верно? Можно ли масштабировать его до 500 000? Можно ли масштабировать его до 1 миллиона? Зависит ли спрос на ваш продукт от того, смогут ли эти кластеры масштабироваться до миллионов?

Дженсен Хуанг: Ответ на последний вопрос – нет. Я считаю , что распределенное обучение должно работать, и я думаю, что будут изобретены распределенные вычисления и будет открыта некая форма федеративного обучения и распределенных асинхронных вычислений. Я очень уверен в этом и очень оптимистичен.

Конечно, важно понимать, что законы масштабирования в прошлом касались прежде всего предварительного обучения. Теперь, когда мы вошли в мультимодальность, мы начинаем генерировать синтетические данные. Фаза после обучения масштабируется очень быстро: генерация синтетических данных, системы вознаграждения и обучение на основе подкрепления — все это быстро развивается. Теперь расширение стадии вывода также достигло своего предела.

Идея состоит в том, что прежде чем модель ответит на вопрос, она проделала внутренние рассуждения 10 000 раз, что, вероятно, не является преувеличением. Возможно, он выполнил поиск по дереву, возможно, он провел обучение с подкреплением на основе проблемы, он мог выполнить какое-то моделирование, он, должно быть, провел много размышлений, он мог просмотреть некоторые данные и информацию, верно? Таким образом, его контекст может быть довольно огромным.

Я думаю, что разведка – это то, чем мы занимаемся, не так ли? Это то, что мы делаем. Итак, если вы посчитаете это масштабирование, увеличив размер модели и масштаб вычислений в 4 раза в год в сочетании с растущим спросом на использование…

Думаем ли мы, что нам нужны миллионы графических процессоров? Без сомнения, да. В настоящее время это детерминированный вопрос. Итак, вопрос в том, как нам это спроектировать с точки зрения центра обработки данных? Многое зависит от того, будет ли дата-центр получать гигаватты сразу или 250 мегаватт за раз? Мое мнение таково, что имеют место оба сценария.

Кларк Танг: Я думаю, что аналитики всегда сосредоточены на текущих архитектурных решениях, но я думаю, что один из самых важных выводов из этого разговора заключается в том, что вы думаете обо всей экосистеме и о том, что произойдет через много лет в будущем.

Таким образом, Nvidia масштабируется, будь то вертикально или горизонтально, чтобы подготовиться к будущему, а не просто полагаться на мир из 500 000 или 1 миллиона кластеров графических процессоров. К моменту появления распределенного обучения вы уже написали программное обеспечение для его поддержки.

Джен -Хсун Хуан: Да, помните Мегатрона, который мы и наши партнеры разработали около семи лет назад. Без этого масштабирование этих масштабных учебных задач было бы невозможно. Мы изобрели Megatron, мы изобрели Nickel, GPU Direct и всю работу, которую мы проделали с RDMA, что значительно упростило конвейерную параллельную обработку.

Вся параллельная обработка моделей, вся декомпозиция распределенного обучения, пакетная обработка и все эти технологии созданы потому, что мы проделали первоначальную работу, а теперь мы также готовимся к следующему поколению технологий в будущем.

Брэд Герстнер: Итак, давайте поговорим о Strawberry и o1.

Во-первых, я думаю, это круто, что они назвали визу О1, правда? Виза o1 предназначена для привлечения в Соединенные Штаты лучших и самых ярких талантов со всего мира, и я знаю, что мы все глубоко увлечены этим.

Мне очень нравится идея создания модели, которая думает и подталкивает нас к новым высотам интеллектуального масштабирования, отдавая дань уважения гениям, которые приехали в Америку через иммиграцию и сделали нас такими, какие мы есть сегодня.

Джен -Сюнь Хуан: Должно быть, это инопланетный разум.

Брэд Герстнер: Конечно, этот проект возглавляет наш друг Ноа Браун, который работал над Pluribus и Cicero, оба мета-проектами. Насколько важно то, что вывод во время вывода является совершенно новым масштабным измерением интеллекта, а не просто построением более крупных моделей?

Дженсен Хуан: Это очень важно, чрезвычайно важно. Знаете, большую часть разведывательной информации невозможно провести заранее? Даже многие вычисления невозможно заранее переупорядочить. Выполнение вне очереди можно выполнить заранее, но многие вещи можно выполнить только во время выполнения.

Так что, будь то с точки зрения информатики или с точки зрения разведки, многие вещи требуют контекста и контекста, а тип ответов, которые вы ищете, иногда достаточно простого быстрого ответа, и последствия этого ответа зависят от что вы используете характер этого ответа.

Итак, на обдумывание некоторых ответов может уйти вечер, а на некоторые ответы может уйти неделя, верно? Я вполне могу себе представить, как отправлю быстрое слово своему ИИ и сообщу его, подумаю об этом за ночь и не скажу мне сразу, верно? Я хочу, чтобы ты думал об этом всю ночь, а завтра утром сказал мне лучший ответ и обосновал его.

Итак , я думаю, что с точки зрения продукта, умное многоуровневое наложение будет иметь одноразовые версии, а некоторые будут делаться за пять минут.

Брэд Герстнер: Этот интеллектуальный уровень способен сопоставить эти проблемы с соответствующими моделями и сценариями использования. Вчера вечером мы использовали расширенный режим речи и предварительный просмотр o1, и я готовил своего сына к экзамену по истории AP, и мне казалось, что лучший учитель истории AP в мире сидел рядом с вами и вместе думал над этими вопросами. Это был такой необыкновенный опыт.

Дженсен Хуан: Моим наставником теперь является AI.

Брэд Герстнер: Конечно, они существуют и сегодня. Это также возвращает нас к теме: вы знаете, что более 40% вашего дохода сегодня поступает от умозаключений. Но рассуждения взорвутся из-за «цепочек рассуждений», верно?

Дженсен Хуан: Рост рассуждений будет в миллиард раз.

Брэд Герстнер: Удвойте это, удвоьте в миллиард раз.

Дженсен Хуан: Да. Это та часть, которую большинство людей еще не до конца понимают. Это именно то изменение отрасли, о котором мы говорили ранее, это промышленная революция.

Брэд Герстнер: Это умное производство, верно?

Дженсен Хуанг: Он вырастет в миллиард раз.

Брэд Герстнер: Все обращают пристальное внимание на NVIDIA, думая, что она в основном используется для обучения более крупных моделей. Не правда ли, если 50% вашего дохода сегодня поступает от обучения, то в будущем масштабы этого вывода значительно превзойдут обучение. Обучение важно, но мы надеемся, что рост умозаключений будет намного опережать рост обучения, и поступить иначе практически невозможно.

Дженсен Хуанг: Мы на это надеемся, да, ходить в школу – это хорошо, но конечная цель состоит в том, чтобы вы могли внести свой вклад в жизнь общества. Итак, обучение этих моделей — это хорошо, но конечная цель — сделать их эффективными.

Брэд Герстнер: Вы уже используете Inference Chain и такие инструменты, как o1, для улучшения своего бизнеса?

Дженсен Хуан: Наши системы сетевой безопасности сегодня неотделимы от нашего собственного интеллекта. У нас есть агенты, которые помогают разрабатывать чипы, и без этих агентов чип Хоппера был бы невозможен, как и Блэквелл, не говоря уже о Рубине.

У нас есть разработчики чипов ИИ, инженеры-программисты ИИ и инженеры по проверке ИИ, и все мы разрабатываем их внутри компании. Поскольку у нас есть такие возможности, мы предпочитаем использовать эту возможность для изучения этой технологии самостоятельно.

▲Рост вывода составит миллиард раз (Источник: NVIDIA)

Нам нужен более эффективный и безопасный ИИ

Брэд Герстнер: Знаете, когда я сегодня вошел в здание, кто-то подошел ко мне и сказал: ну, спроси Дженсена о культуре, это все о культуре. Я смотрю на ваш бизнес, и мы много говорим об адаптивности и эффективности, плоских организационных структурах, обеспечивающих быстрое выполнение задач, о работе небольших команд.

Вы знаете, NVIDIA уникальна в этой области: она генерирует около 4 миллионов долларов дохода на одного сотрудника и около 2 миллионов долларов прибыли или свободного денежного потока на одного сотрудника. Вы создали культуру эффективности, которая действительно раскрывает творческий потенциал, инновации, ответственность и ответственность, и вы сломали традиционную модель функционального управления. Всем нравится говорить о том, как много у вас прямых подчиненных.

Является ли использование ИИ ключом к тому, чтобы вы могли оставаться творческими и при этом оставаться эффективными?

Дженсен Хуан: Без сомнения. Я надеюсь, что однажды в Nvidia сегодня будет работать 32 000 сотрудников, а в Израиле будет 4 000 семей, я надеюсь, что у них все хорошо. Я надеюсь, что однажды Nvidia станет компанией с 50 000 сотрудников и 100 миллионами ИИ-помощников.

В каждой команде у нас будет каталог ИИ с группой ИИ, которые умеют делать разные вещи. У нас также будет почтовый ящик, заполненный каталогом ИИ, с которыми мы работали и знаем, что они хороши в наших областях навыков. Поэтому ИИ привлекает других ИИ для решения проблем. ИИ также будут общаться друг с другом по каналам Slack.

Брэд Герстнер: И работа с людьми.

Джен-Сун Хуан: Работа с людьми. Таким образом, мы будем большой группой сотрудников, часть из которых будет работать с цифровыми технологиями и искусственным интеллектом, часть из которых будут биологическими людьми, и я надеюсь, что в будущем появятся сотрудники, занимающиеся мехатроникой.

Брэд Герстнер: Я думаю, что с точки зрения бизнеса это часто понимают неправильно. Вы только что описали компанию, у которой есть производительность компании со 150 000 сотрудников, но на самом деле вы использовали только 50 000 сотрудников. Вы не говорите, что собираетесь уволить всех своих сотрудников, вы все равно увеличиваете численность персонала, но объем производства этой компании значительно увеличится, не так ли?

Дженсен Хуан: Это часто понимают неправильно. ИИ не заменит рабочие места, он изменит каждую работу. ИИ окажет глубокое влияние на то, как люди думают о работе, мы должны это признать, верно?

ИИ способен принести как огромную пользу, так и вред, и мы должны создать безопасный ИИ, да, это должно быть основой. Но упускается из виду то, что когда компании используют ИИ для повышения производительности, это, скорее всего, приведет к увеличению доходов или росту, или к тому и другому. И когда это произойдет, маловероятно, что следующее электронное письмо генерального директора будет уведомлением об увольнении.

Брэд Герстнер: Абсолютно, потому что компания растет.

Дженсен Хуанг: Да, причина в том, что у нас больше идей, чем мы можем изучить, и нам нужны люди, которые помогут нам обдумать их, а затем автоматизировать эти идеи. Что касается автоматизации, то ИИ может помочь нам в этом.

Очевидно, это также поможет нам думать, но нам все равно нужно выяснить, какую проблему мы хотим решить. Мы можем решить бесчисленное множество проблем, но компании должны выбрать те, которые требуют решения больше всего, а затем найти способ их автоматизировать и масштабировать.

По мере того, как мы становимся более эффективными, мы будем нанимать больше людей. Люди часто об этом забывают. Если оглянуться на историю, станет ясно, что сегодня у нас больше идей, чем 200 лет назад. Вот почему ВВП и рабочие места растут, хотя мы автоматизируем как сумасшедшие.

Брэд Герстнер: Это важный момент, поскольку мы вступаем в период, когда почти вся человеческая производительность и процветание являются побочным продуктом технологий и автоматизации за последние 200 лет. Вы можете оглянуться на график роста ВВП на душу населения за последние 200 лет, от Адама Смита до творческого разрушения Шумпетера, и он продолжает ускоряться. Это подводит меня к вопросу.

Если вы посмотрите на 1990-е годы, рост производительности в США составлял от 2,5% до 3% в год. Затем, в 2000-х годах, он замедлился примерно до 1,8%. Прошедшее десятилетие было самым медленным ростом производительности за всю историю. Это относится к росту нашего производства при фиксированных затратах труда и капитала и является самым медленным за всю историю.

Многие люди обсуждали это. Но если мир такой, как вы описываете, и мы собираемся использовать и производить интеллект, стоим ли мы на пороге масштабного роста человеческой производительности?

Дженсен Хуан: Это наша надежда. Это наша надежда, и, конечно, вы знаете, мы живем в этом мире, поэтому у нас есть прямые доказательства, верно? У нас есть прямые доказательства того, что отдельные исследователи, использующие ИИ, теперь могут исследовать науку в беспрецедентных масштабах, что является отражением производительности.

Или мы проектируем такой сложный чип и делаем это так быстро, а численность персонала компании не растет такими же темпами, что тоже является отражением производительности, не так ли? Программное обеспечение, которое мы разрабатываем, также становится все лучше и лучше, потому что мы используем искусственный интеллект и суперкомпьютеры, чтобы помочь нам, а количество сотрудников растет почти линейно.

Это еще одно доказательство продуктивности. Поэтому в какую бы отрасль я ни погружался, я могу себя проверить, могу лично убедиться в распространенности этих проявлений. Нет сомнений в том, что интеллект — самый ценный ресурс в мире, и теперь мы собираемся производить его в больших масштабах.

Нам всем придется научиться жить в среде, где нас окружает искусственный интеллект, который может делать все очень хорошо или даже лучше, чем мы. Когда я размышляю об этом, я вижу, что это моя жизнь.

У меня 60 прямых подчиненных, верно? Все они люди мирового уровня в своих областях и добиваются большего, чем я. У меня нет проблем с работой с ними, и у меня нет проблем с их обучением и общением с ними. Поэтому я думаю, что люди узнают, что все они станут руководителями агентов ИИ.

Им необходимо обладать творческим подходом, решимостью и некоторыми знаниями о том, как решать проблемы, чтобы иметь возможность запрограммировать эти ИИ, чтобы помочь им достичь своих целей, точно так же, как я управляю своей компанией.

Брэд Герстнер: Вы упомянули вопрос, который касается обсуждения согласованности и безопасного ИИ. Вы также упомянули о трагедии, которая происходит на Ближнем Востоке. Вы знаете, сейчас в разных частях мира существует множество применений автономии и ИИ.

Итак, давайте поговорим о злоумышленниках, искусственном интеллекте безопасности и координации с Вашингтоном. Как ты себя чувствуешь сейчас? Мы на правильном пути? Достаточно ли мы координируем свои действия? Я помню, Марк Цукерберг однажды сказал, что способ победить плохой ИИ — сделать хороший ИИ лучше. Как бы вы описали, как мы обеспечиваем, чтобы ИИ приносил положительную чистую выгоду человечеству, а не заманивал нас в ловушку бессмысленного антиутопического мира?

Дженсен Хуан: Дискуссия о безопасности очень важна и содержательна. Абстрактная точка зрения, то есть рассмотрение ИИ как большой нейронной сети, не является хорошей точкой зрения. Причина в том, что мы знаем, что искусственный интеллект и большие языковые модели хоть и связаны, но не одно и то же.

Сейчас ведется большая работа, которую я считаю блестящей. Во-первых, модель с открытым исходным кодом позволяет каждой отрасли, каждой компании и всему исследовательскому сообществу иметь доступ к ИИ и учиться использовать эти возможности в своих областях. очень хороший.

Во-вторых, силы, занимающиеся разработкой технологий ИИ, сосредоточены на том, как сделать ИИ более безопасным. ИИ используется для просеивания данных, фильтрации информации, обучения других ИИ, создания согласованных ИИ, генерации синтетических данных, расширения знаний ИИ, уменьшения галлюцинаций и всего ИИ, созданного для векторных изображений, графики и т. д., для информирования и мониторинга других систем ИИ, которые еще не получили достаточного признания для создания безопасного ИИ.

Брэд Герстнер: Эти системы уже создаются.

Дженсен Хуанг: Да, мы создаем эти системы, и все в отрасли этим занимаются. Включая тестирование красной командой, управление процессами, карты моделей, системы оценки, системы тестирования и т. д., все эти механизмы безопасности создаются с угрожающей скоростью. Знаете, эти усилия не получили должного признания.

Брэд Герстнер: Да, в настоящее время нет никаких правительственных постановлений, требующих этого. Сейчас настало время, когда игроки отрасли серьезно относятся к этим важнейшим проблемам и координируют свои действия вокруг лучших практик.

Дженсен Хуанг: Именно, эти усилия недостаточно признаны и не до конца поняты. Людям пора начать говорить об ИИ как о системе, состоящей из множества ИИ, и о его природе как о хорошо спроектированной системе.

Что касается регулирования, нам нужно помнить , что ИИ — это возможность, которую можно применять во многих областях. Нет необходимости в отдельном законодательстве для каждой важной технологии, но нельзя допускать, чтобы регулирование распространялось на ненужные области.

Большая часть регулирования должна осуществляться для конкретных приложений. Например, такие агентства, как FAA (Федеральное управление гражданской авиации), NIH (Национальные институты здравоохранения), FDA (Управление по контролю за продуктами и лекарствами США) уже регулируют применение технологий и теперь. Существует необходимость начать управлять технологическими приложениями, включающими ИИ.

Так что не поймите это неправильно и не игнорируйте огромное количество существующих систем регулирования, которые нам придется активировать. Не полагайтесь исключительно на одну глобальную комиссию по искусственному интеллекту, поскольку каждый регулирующий орган создается по определенной причине. Причина существования этих различных регулирующих органов заключается в решении различных проблем. Давайте снова вернемся к основным принципам.

▲Кларк Тан в интервью

Открытый исходный код искусственного интеллекта стимулирует активизацию отрасли

Брэд Герстнер: Мой партнер Билл Герли (примечание редактора: Билл отсутствовал в этом интервью), вероятно, обвинил бы меня, если бы я не вернулся к вопросу открытого исходного кода. Недавно вы выпустили очень важную и очень мощную модель с открытым исходным кодом. Очевидно, что Meta также вносит значительный вклад в открытый исходный код.

Когда я читал Twitter, я заметил, что было много дискуссий о открытом и закрытом. Что вы думаете об открытом исходном коде, и, в частности, способность вашей собственной модели с открытым исходным кодом идти в ногу с передовыми технологиями? Это первый вопрос.

Второй вопрос заключается в том, что ваше видение на будущее, наличие модели с открытым исходным кодом, а также закрытая модель, которая поддерживает коммерческие операции? Могут ли эти два создать здоровое напряжение для безопасности ИИ?

Джен-Хсун Хуанг: Обсуждение открытого исходного кода и закрытого исходного кода связано с безопасностью, но речь идет не только о безопасности. Например, наличие модели с замкнутым исходным кодом в качестве двигателя экономической модели для поддержания инноваций совершенно нормально, и я искренне поддерживаю это.

Я думаю, что определение проблемы просто как закрытый исходный код и открытый исходный код – это неправильный образ мышления. Это должен быть закрытый исходный код и открытый исходный код, верно? Потому что открытый исходный код необходим для активации многих отраслей.

Если сейчас нет открытого исходного кода, как могут быть активированы все эти различные научные области на ИИ? Потому что они должны разработать свой собственный ИИ, специфичный для домена, и им необходимо использовать модели с открытым исходным кодом для создания ИИ, специфичного для домена. Эти два связаны, но не одинаковы.

То, что у вас есть модель с открытым исходным кодом, не означает, что у вас есть ИИ. Поэтому у вас должны быть модели с открытым исходным кодом, чтобы управлять созданием ИИ. Таким образом, финансовые услуги, здравоохранение, транспорт и многие другие области науки и промышленности активируются открытым исходным кодом.

Брэд Герстнер: Невероятно, что ваша модель с открытым исходным кодом пользуется высоким спросом, не так ли?

Дженсен Хуанг: Наша модель с открытым исходным кодом? Конечно, лама загружает, верно? Очевидно, что работа, которую Марк (Цукерберг) и его команда выполняют, невероятна, по огромному спросу и полностью заряжает каждую отрасль и каждую область науки.

Причина, по которой мы создали Nemotron, была для генерации синтетических данных. Интуитивно, это звучит ненадежно думать, что ИИ будет постоянно генерировать данные в цикле, чтобы учиться. Сомнительно, сколько раз вы можете ходить в этой бесконечной петле. Тем не менее, у меня есть изображение в моей голове, которое похоже на то, что он зафиксировал супер умного человека в мягкой комнате.

Однако, если два или три человека обсуждают вместе, у нас есть разные модели ИИ, иметь разные распределения знаний, мы можем подвергать сомнению и отвечать друг другу и общаться взад -вперед, тогда все трое из нас станут умнее. Таким образом, идея обмена, взаимодействия, дискуссий в обратном и образовании, дебатов, обучения подкреплении и генерации синтетических данных между моделями ИИ имеет интуитивно понятный смысл.

Таким образом, наши Nemotron 350b, 340b являются лучшими моделями системы вознаграждений в мире. Это лучшая критическая модель и действительно превосходна. Таким образом, это фантастический инструмент для улучшения всех других моделей, независимо от того, насколько хороши другие модели, я рекомендую использовать Nemotron 340b, чтобы улучшить их и сделать их еще лучше. И мы видели, как Лама поправилась, и все остальные модели извлекли выгоду из этого.

▲ Мета вносит значительный вклад в открытый исходный код (Источник: LinkedIn)

ИИ – полная революция

Брэд Герстнер: Как человек, который доставил первый DGX-1 в 2016 году, это было невероятное путешествие. Ваше путешествие необычное и удивительное. Тот факт, что вам удалось пройти через эти начальные трудные времена, само по себе необычайно.

Вы доставили первый DGX-1 в 2016 году, и мы открыли этот «кембрийский момент» в 2022 году. Поэтому я хочу задать вопрос, который меня часто задают, что, как вы думаете, как долго ваш текущий статус работы может длиться?

С 60 прямыми отчетами, вы везде ездите на этой революции. Вам нравится процесс? Есть ли что -нибудь еще, что вы бы предпочли сделать?

Джен-Хсун Хуан: Вы спрашиваете о своих чувствах в последние полтора часа? Ответ: отличный. Я прекрасно провел время и не мог представить себе что -то более стоящее.

Позвольте мне подумать об этом, я не думаю, что наша работа всегда должна чувствовать, что это весело. Моя работа не всегда весела, и я не ожидаю, что это будет. Должен ли работать всегда быть веселым? Я думаю, что важно то, что работа всегда важна. Я не относитесь к себе слишком серьезно, но я очень серьезно относимся к своей работе. Я принимаю наши обязанности, наш вклад в общество и времена, когда мы живем очень серьезно.

Это всегда весело? Нет, но всегда мне это нравится? Да, как и все, будь то семья, друзья, дети, всегда весело? Нет, но всегда любим ли мы их глубоко? Абсолютно.

Как долго я могу это сделать? Реальный вопрос в том, как долго я могу оставаться актуальным? На ответ на этот вопрос отвечает только другой вопрос: как я буду продолжать учиться? Сегодня я более оптимистичен, и я не говорю это из -за того, о чем мы говорим сегодня. Из -за появления ИИ я более оптимистичен в отношении своей способности оставаться актуальной и продолжать учиться. Я использую его каждый день. Я не знаю, используете ли вы вы, ребята, это тоже, но я использую его каждый день.

Нет никакого исследования, которое не связано с ИИ, и даже если я знаю ответ, я буду использовать ИИ, чтобы проверить его. Удивительно, но следующие два или три вопроса, которые я задаю, часто раскрывают то, чего я не знал.

Вы можете выбрать тему, которая вас интересует, я считаю ИИ как наставника, ИИ как помощника, ИИ как партнера для мозгового штурма, чтобы проверить мою работу. Ребята, это действительно полная революция. И я информационный работник, и мой вывод – информация.

Поэтому я думаю, что вклад ИИ в общество необычен. Если я могу оставаться актуальным таким и продолжать вносить свой вклад, я знаю, что эта работа достаточно важна для меня, чтобы продолжать преследовать. И мое качество жизни невероятно.

Брэд Герстнер: Я не могу себе представить, что пропустил этот момент. Мы с вами десятилетиями были в этой отрасли, и это наш самый большой момент за тридцать лет. Мы глубоко благодарны за это сотрудничество.

Дженсен Хуан: Не пропустите следующие десять лет.

Брэд Герстнер: Большое спасибо за обмен идей, вы делаете нас всех мудрее. Спасибо, я думаю, вы играете очень важную роль в качестве лидера в навигации по будущему с оптимизмом и безопасностью.

Дженсен Хуан: Спасибо, что были с нами. Мне это очень понравилось, я очень ценю это, спасибо, Брэд, спасибо, Кларк.

# Добро пожаловать на официальную общедоступную учетную запись WeChat Aifaner: Aifaner (идентификатор WeChat: ifanr). Более интересный контент будет предоставлен вам как можно скорее.

Ай Фанер | Исходная ссылка · Посмотреть комментарии · Sina Weibo