Созданные искусственным интеллектом лица захватывают интернет

В марте Times представила 18-летнюю украинку по имени Люба Довженко, чтобы проиллюстрировать жизнь в осаде. Она, как утверждалось в статье, изучала журналистику, говорила на «плохом английском» и начала носить оружие после российского вторжения.

Проблема, однако, заключалась в том, что Довченко не существует в реальной жизни, и вскоре после публикации история была удалена.

Люба Довченко была фальшивой онлайн-персоной, созданной, чтобы извлечь выгоду из растущего интереса к историям о войне между Украиной и Россией в Твиттере и получить большое количество подписчиков. Учетная запись не только никогда не писала в Твиттере до марта, но у нее также было другое имя пользователя, а обновления, которые она публиковала в Твиттере, что, возможно, и привлекло внимание The Times, были скопированы с других подлинных профилей. Однако самые убедительные доказательства ее мошенничества были прямо на ее лице.

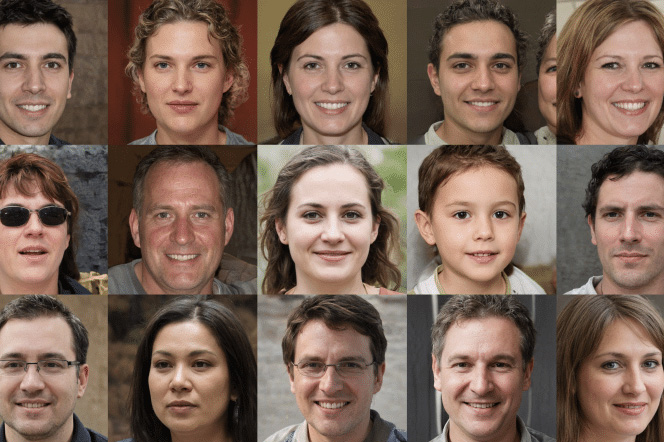

На аватарке Довченко некоторые пряди волос были отделены от остальной части головы, не хватало нескольких ресниц, а самое главное, ее глаза были поразительно сосредоточены. Все они были явными признаками искусственного лица, созданного алгоритмом ИИ.

Позиционирование черт лица — не единственная аномалия на аватарке @lubadovzhenko1 ; не отдельные волосы в нижней правой части изображения и частично отсутствующие ресницы (среди прочего). pic.twitter.com/UPuvAQh4LZ

– Conspirador Norteño (@conspirator0) 31 марта 2022 г.

Лицо Довхенко было сфабриковано с помощью технологии дипфейков , все более популярной техники, которая позволяет любому наложить лицо на лицо другого человека в видео и используется для всего: от порномести до манипулирования речами мировых лидеров. А загрузив такие алгоритмы миллионами фотографий реальных людей, их можно перепрофилировать для создания из воздуха реалистичных лиц, таких как у Довченко. Это растущая проблема, которая еще больше усложняет борьбу с дезинформацией.

Армия фальшивых лиц, созданных искусственным интеллектом

За последние несколько лет, когда социальные сети борются с безликими анонимными троллями, ИИ вооружил злоумышленников и ботов бесценным оружием: способностью казаться пугающе аутентичными. В отличие от того, что было раньше, когда тролли просто вырывали настоящие лица из Интернета, и любой мог разоблачить их, перевернув изображение своего профиля, для кого-то практически невозможно сделать то же самое с фотографиями, созданными искусственным интеллектом, потому что они свежие и уникальные. И даже при ближайшем рассмотрении большинство людей не видят разницы.

Доктор Софи Найтингейл, профессор психологии Ланкастерского университета в Великобритании, обнаружила, что люди имеют всего 50% шансов заметить лицо, синтезированное искусственным интеллектом, и многие даже считают их более надежными, чем настоящие. Средства для любого, кто может получить доступ к «синтетическому контенту без специальных знаний Photoshop или CGI», — сказала она Digital Trends, — «создают значительно большую угрозу для гнусного использования, чем предыдущие технологии».

Что делает эти лица такими неуловимыми и очень реалистичными, говорит Яссин Мекдад, исследователь кибербезопасности из Университета Флориды, чья модель обнаружения изображений, сгенерированных ИИ, имеет точность 95,2%, так это то, что их программирование (известное как генеративно-состязательная сеть) использует две противоположные нейронные сети, которые работают друг против друга, чтобы улучшить изображение. Одному (G, генератору) поручено генерировать поддельные изображения и вводить в заблуждение другого, в то время как второй (D, дискриминатор) учится отличать результаты первого от реальных лиц. Эта «игра с нулевой суммой» между ними позволяет генератору создавать «неотличимые изображения».

И лица, созданные искусственным интеллектом, действительно захватили Интернет с головокружительной скоростью. Помимо учетных записей, подобных аккаунту Довхенко, которые используют синтезированные персонажи для привлечения подписчиков, эта технология в последнее время стала основой для гораздо более тревожных кампаний.

Когда в 2020 году Google уволила Тимнита Гебру, исследователя этики ИИ, за публикацию статьи, в которой подчеркивалась предвзятость алгоритмов компании, сеть ботов с лицами, сгенерированными ИИ , которые утверждали, что раньше работали в исследовательском подразделении ИИ Google, социальных сетях и подстерегала любого, кто высказывался в пользу Гебру. Аналогичные действия таких стран, как Китай , были обнаружены в продвижении правительственных нарративов.

При беглом обзоре в Твиттере мне не потребовалось много времени, чтобы найти нескольких противников вакцинации , пророссийских и других — все они прячутся за сгенерированным компьютером лицом, чтобы продвигать свои планы и атаковать любого, кто стоит у них на пути. Хотя Twitter и Facebook регулярно уничтожают такие ботнеты, у них нет механизма для борьбы с отдельными троллями с искусственным лицом, даже несмотря на то, что политика первого в отношении вводящей в заблуждение и вводящей в заблуждение идентичности «запрещает выдавать себя за отдельных лиц, группы или организации, чтобы вводить в заблуждение, сбивать с толку или обманывать других и не использовать фальшивую личность таким образом, чтобы мешать опыту других». Вот почему, когда я сообщил о профилях, с которыми столкнулся, мне сообщили, что они не нарушают никаких правил.

По оценкам Sensity, компании, занимающейся решениями для мошенничества на основе искусственного интеллекта, от 0,2% до 0,7% людей в популярных социальных сетях используют фотографии, созданные компьютером. Само по себе это не так уж много, но для Facebook (2,9 миллиарда пользователей), Instagram (1,4 миллиарда пользователей) и Twitter (300 миллионов пользователей) это означает миллионы ботов и актеров, которые потенциально могут быть частью кампаний по дезинформации. .

Процент совпадения расширения Chrome для детектора лиц, сгенерированного искусственным интеллектом, от V7 Labs подтвердил цифры Sensity. Его генеральный директор Альберто Риццоли утверждает, что в среднем 1% фотографий, которые люди загружают, помечаются как фальшивые.

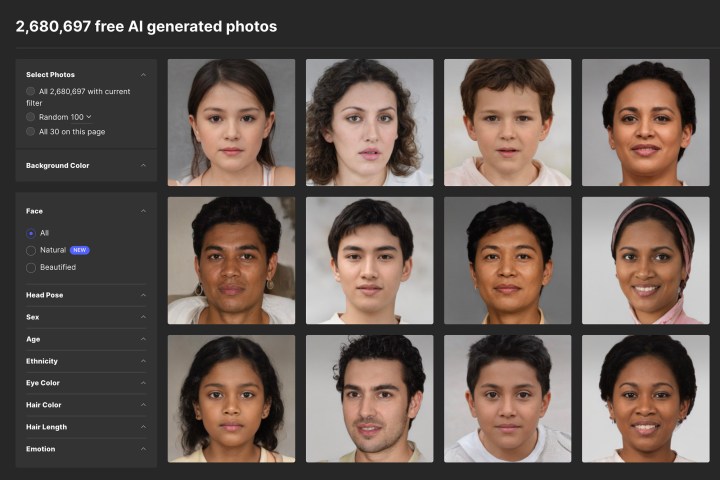

Рынок поддельных лиц

Одна из причин, почему фотографии, созданные искусственным интеллектом, так быстро распространились, заключается в том, насколько легко их получить. На таких платформах, как Generated Photos , каждый может приобрести сотни тысяч фальшивых лиц в высоком разрешении за пару долларов, а те, кому нужно несколько для разовых целей, таких как личные клеветнические кампании, могут загрузить их с таких веб-сайтов, как thispersondoesnotexist. .com , который автоматически создает новое синтетическое лицо каждый раз, когда вы перезагружаете его.

Эти веб-сайты сделали жизнь особенно сложной для таких людей, как Бенджамин Стрик, руководитель отдела расследований британского Центра информационной устойчивости, чья команда ежедневно часами отслеживает и анализирует вводящий в заблуждение онлайн-контент.

«Если вы добавите [автогенеративные технологии] в пакет профилей с фальшивыми лицами, работающих в фальшивом стартапе (через thisstartupdoesnotexist.com)», — сказал Стрик Digital Trends, — «есть рецепт социальной инженерии и база для очень обманчивых практики, которые можно настроить за считанные минуты».

Иван Браун, основатель Generated Photos, утверждает, что не все так плохо. Он утверждает, что у фотографий GAN есть много положительных вариантов использования — например, анонимизация лиц в режиме просмотра улиц Google Maps и имитация виртуальных миров в играх — и это то, что продвигает платформа. Если кто-то занимается введением людей в заблуждение, Браун надеется, что средства защиты его платформы от мошенничества смогут обнаружить вредоносные действия, и что со временем социальные сети смогут отфильтровывать сгенерированные фотографии от подлинных.

Но регулирование генеративных технологий на основе ИИ тоже сложно, поскольку они также обеспечивают бесчисленное количество ценных сервисов, включая последний фильтр в Snapchat и функции интеллектуального освещения Zoom. Генеральный директор Sensity Джорджио Патрини согласен с тем, что запрет таких сервисов, как Generated Photos, нецелесообразен, чтобы остановить рост лиц, созданных искусственным интеллектом. Вместо этого существует острая необходимость в более активных подходах платформ.

Пока этого не произойдет, внедрение синтетических медиа будет продолжать подрывать доверие к государственным институтам, таким как правительства и журналистика, говорит Тайлер Уильямс, директор по расследованиям Graphika, фирмы, занимающейся анализом социальных сетей, которая раскрыла некоторые из самых масштабных кампаний с участием поддельных персонажей. . И решающим элементом в борьбе с неправомерным использованием таких технологий, добавляет Уильямс, является «учебная программа по медиаграмотности, начинающаяся с раннего возраста, и обучение проверке источников».

Как определить лицо, сгенерированное ИИ?

К счастью для вас, есть несколько верных способов определить, создано ли лицо искусственно. Здесь следует помнить, что эти лица создаются простым смешиванием тонн фотографий. Таким образом, хотя настоящее лицо будет выглядеть настоящим, вы найдете множество подсказок по краям: формы ушей или серьги могут не совпадать, пряди волос могут развеваться повсюду, а окантовка очков может быть странной — список. продолжается. Самая распространенная раздача заключается в том, что когда вы переключаетесь между несколькими фальшивыми лицами, все их глаза будут в одном и том же положении: в центре экрана. И вы можете проверить это с помощью хака « сложенный билет на поезд », как это продемонстрировал здесь Стрик.

Найтингейл считает, что самая серьезная угроза, которую представляют фотографии, созданные искусственным интеллектом, — это подпитка «дивидендов лжеца» — само их существование позволяет отвергать любые средства массовой информации как фальшивые. «Если мы не можем рассуждать об основных фактах окружающего нас мира, — утверждает она, — то это подвергает наши общества и демократии существенному риску».