Nvidia создала массивный двойной графический процессор для таких моделей, как ChatGPT.

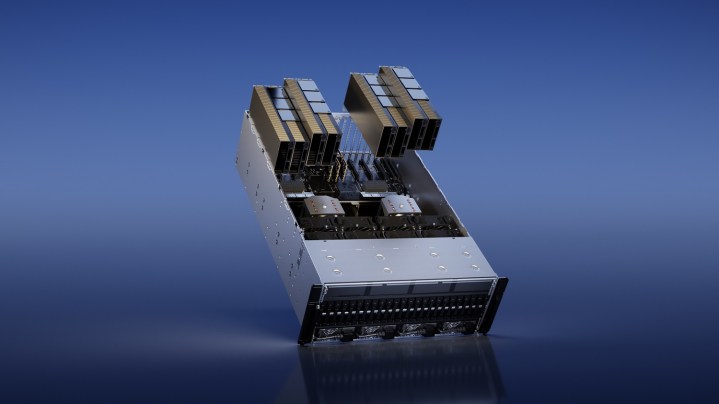

Полугодовая конференция Nvidia по технологиям графических процессоров (GTC) обычно посвящена достижениям в области искусственного интеллекта, но в этом году Nvidia отреагировала на массовый рост ChatGPT выпуском новых графических процессоров. Главным среди них является H100 NVL, который объединяет два графических процессора Nvidia H100 для развертывания моделей больших языков (LLM), таких как ChatGPT.

H100 не новый графический процессор. Nvidia объявила об этом год назад на GTC, демонстрируя свою архитектуру Hopper и обещая ускорить вывод ИИ в различных задачах. Говорят, что новая модель NVL с огромным объемом памяти 94 ГБ лучше всего работает при крупномасштабном развертывании LLM, обеспечивая до 12 раз более быстрое получение логических выводов по сравнению с A100 последнего поколения.

Эти графические процессоры лежат в основе таких моделей, как ChatGPT. Nvidia и Microsoft недавно сообщили, что тысячи графических процессоров A100 использовались для обучения ChatGPT — проекта, который разрабатывался более пяти лет.

H100 NVL работает путем объединения двух графических процессоров H100 через межсоединение Nvidia с высокой пропускной способностью NVLink. Это уже возможно с текущими графическими процессорами H100 — на самом деле вы можете подключить до 256 H100 вместе через NVLink — но этот выделенный блок создан для небольших развертываний.

Это продукт, созданный в первую очередь для бизнеса, поэтому не ожидайте, что H100 NVL появится на полке в вашем местном микроцентре. Тем не менее, Nvidia говорит, что корпоративные клиенты могут ожидать его появления примерно во второй половине года.

В дополнение к H100 NVL, Nvidia также анонсировала графический процессор L4, специально созданный для поддержки видео, созданного искусственным интеллектом. Nvidia заявляет, что она в 120 раз мощнее для видео, созданных искусственным интеллектом, чем ЦП, и предлагает на 99% лучшую энергоэффективность. По словам Nvidia, в дополнение к генеративному AI-видео, графический процессор поддерживает возможности декодирования и транскодирования видео и может использоваться для дополненной реальности.

Nvidia заявляет, что Google Cloud одним из первых интегрировал L4. Google планирует предложить клиентам инстансы L4 через свою платформу Vertex AI позже сегодня. Nvidia заявила, что позже графический процессор будет доступен у партнеров, включая Lenovo, Dell, Asus, HP, Gigabyte и HP, среди прочих.