Microsoft отключает распознавание лиц, ИИ может не думать о том, что вы выражаете

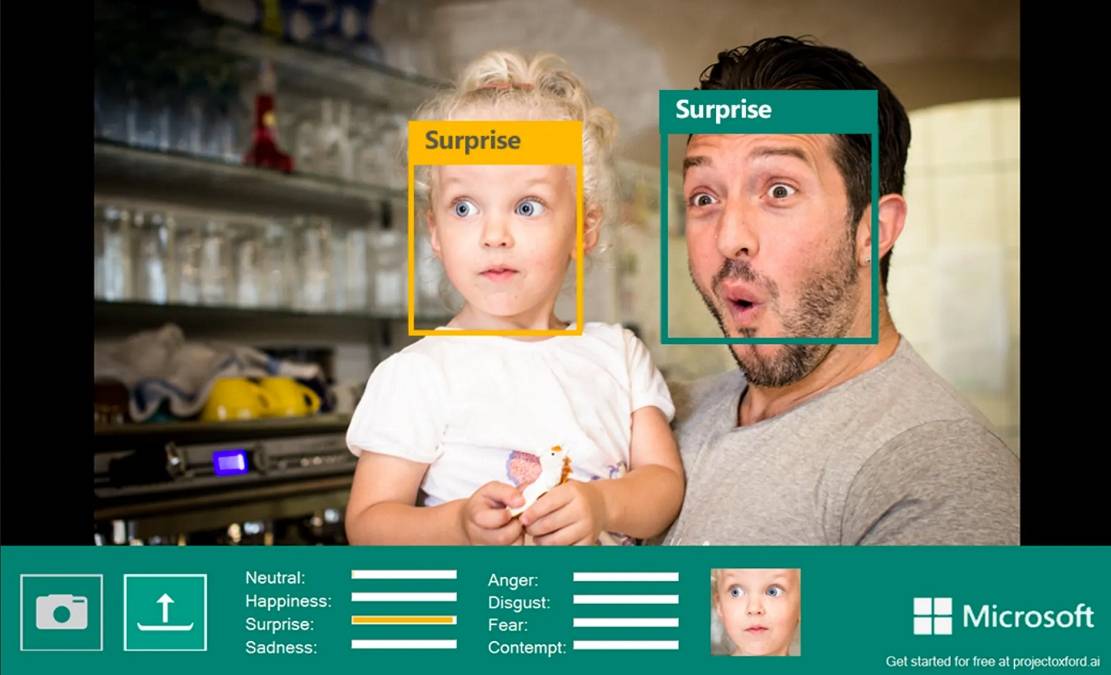

Выражение эмоций с помощью мимики является почти врожденной способностью каждого. Люди также привыкли к выражениям лица, чтобы угадывать эмоции других людей. Однако с быстрым развитием технологий ИИ (искусственный интеллект) также может распознавать состояние лица и эмоции людей. .

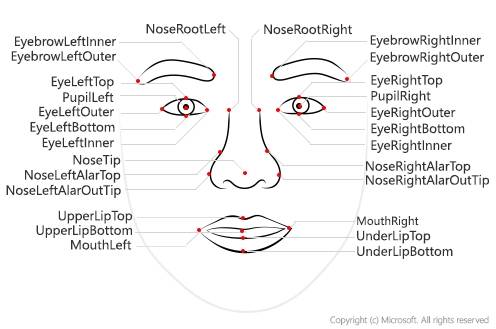

▲ Изображение взято с сайта ResearchGate.

Не так давно Microsoft, занимающаяся разработкой технологии распознавания лиц, выпустила руководство на тему «Основы ответственного построения систем искусственного интеллекта». Открыто делится стандартами Microsoft Responsible AI Standards, основой, которая определяет, как Microsoft создает системы искусственного интеллекта.

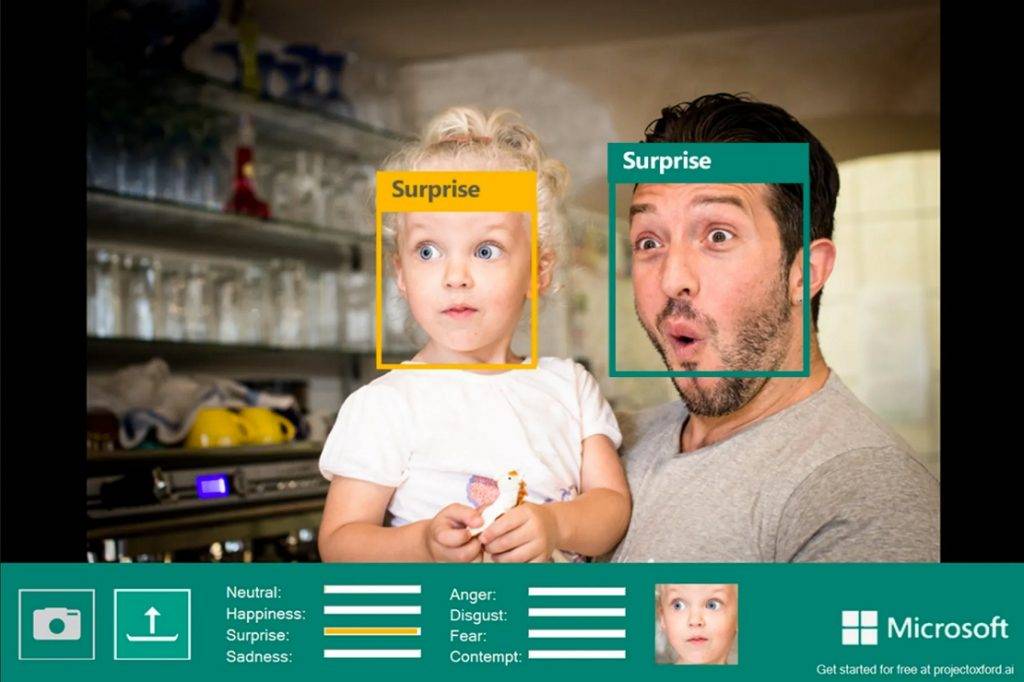

▲ Изображение из: Майкрософт

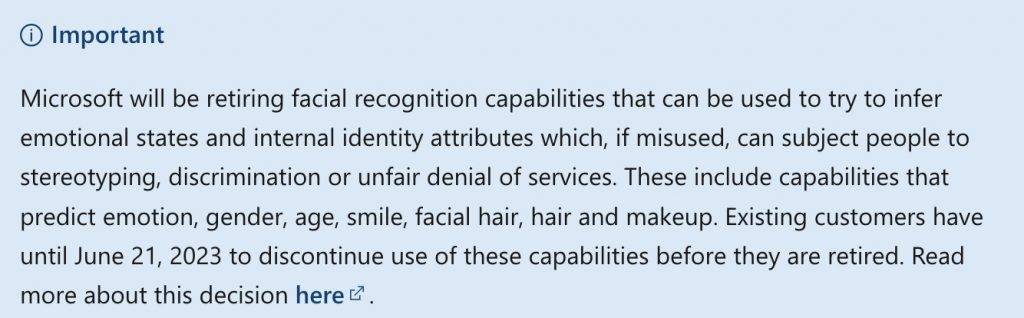

В статье упоминается, что Microsoft решила отказаться от функций распознавания лиц, Azure Face Services, поскольку эти функции можно использовать для попытки сделать вывод об эмоциональных состояниях и внутренних атрибутах личности, которые в случае злоупотребления могут подвергнуть людей стереотипам, дискриминации или несправедливому отрицанию. обслуживания.

В настоящее время служба распознавания лиц доступна только для клиентов и партнеров Microsoft, у существующих клиентов будет год для перехода, но они должны прекратить использовать эти функции до 21 июня 2023 г. Новые пользователи могут использовать форму запроса на распознавание лиц Запросить доступ.

▲ Изображение из: Майкрософт

На самом деле Microsoft не отключает эту функцию полностью, а интегрирует технологию в «контролируемые» инструменты доступности, такие как «Видящий ИИ» для людей с нарушениями зрения. Он может описывать объекты и текст для слабовидящих, читать знаки, расшифровывать чье-то выражение лица, обеспечивать навигацию и т. д. В настоящее время он поддерживает английский, голландский, французский, немецкий, японский и испанский языки.

▲ Изображение из: Майкрософт

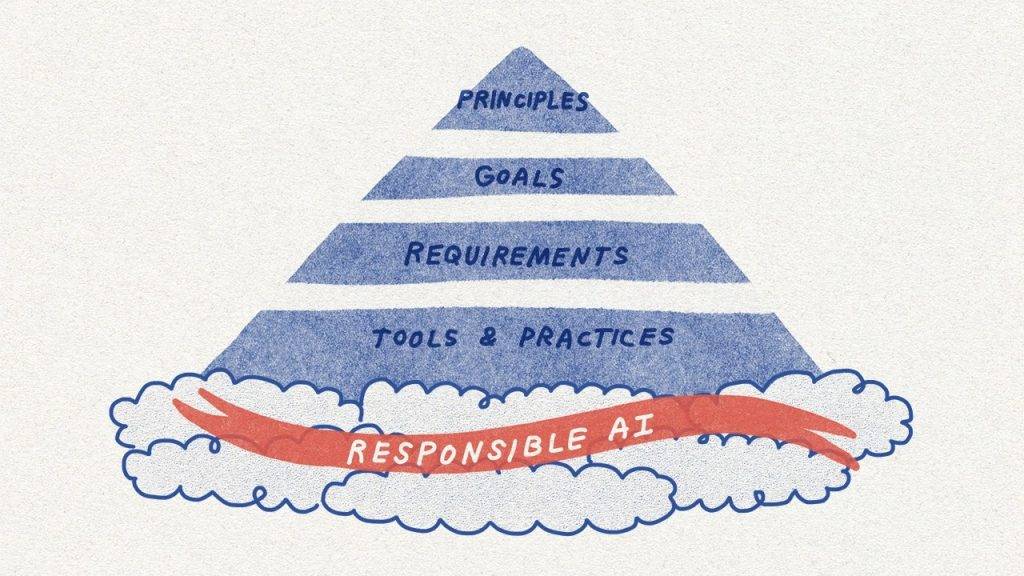

Руководство, выпущенное Microsoft, объясняет процесс принятия решений технологической компанией, в том числе акцентирует внимание на таких принципах, как инклюзивность, конфиденциальность и прозрачность, и является первым крупным обновлением стандарта с момента его запуска в конце 2019 года.

Microsoft заявила, что внесла такое большое изменение в распознавание лиц, потому что осознала, что для того, чтобы системы ИИ заслуживали доверия, они должны правильно решать проблемы, для решения которых они были созданы.

▲ Изображение из: Майкрософт

В рамках усилий по приведению службы Azure Face в соответствие с требованиями ответственных стандартов искусственного интеллекта Microsoft также не рекомендует делать вывод об эмоциональных состояниях (счастливом, грустном, нейтральном, злом и т. д.) и атрибутах личности (таких как пол, возраст, улыбка, растительность на лице и т. д.). прическа и макияж).

Что касается эмоциональных состояний, Microsoft решила не предоставлять открытый API-доступ к технологиям, которые сканируют лица людей и утверждают, что могут делать выводы об их эмоциональном состоянии на основе их выражений лица или движений.

▲ Изображение из: Майкрософт

На странице Microsoft показано, что его можно идентифицировать по 27 признакам лица людей, и существуют различные черты лица, по которым можно судить, например, размыто ли данное лицо, есть ли у него аксессуары, предполагаемый пол и возраст, носит ли оно очки и т. д. и тип волос. , носишь ли ты очки, улыбаешься ли ты…

Эксперты внутри и за пределами Microsoft подчеркивают отсутствие научного консенсуса в отношении определения «эмоций» и высокий уровень опасений относительно конфиденциальности, связанных с этой способностью. Поэтому Microsoft также решила, что ей необходимо тщательно проанализировать все системы искусственного интеллекта, предназначенные для определения эмоционального состояния людей, независимо от того, использовали ли они анализ лица или любую другую технологию искусственного интеллекта.

▲ Изображение из: Майкрософт

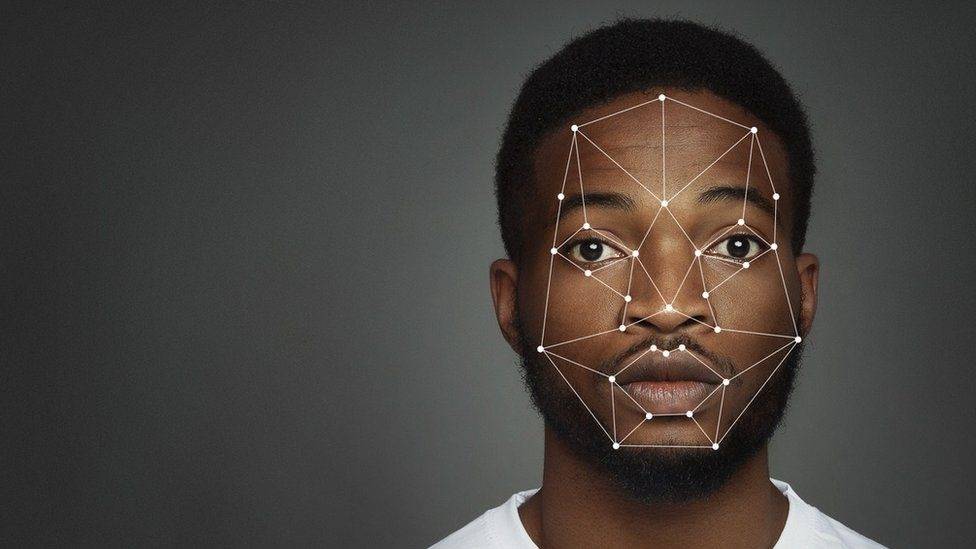

Стоит отметить, что Microsoft — не единственная компания, которая серьезно занялась распознаванием лиц.Генеральный директор IBM Арвинд Кришна также написал в Конгресс США письмо, в котором сообщил, что компания вышла из бизнеса по распознаванию лиц. Причина решения двух компаний неотделима от «Смерти Флойда», которая ранее произвела фурор.

▲ Изображение взято с BBC.

Из-за опасения, что эта технология может предоставить инструменты мониторинга для правоохранительных органов, что приведет к некоторым нарушениям прав человека, а также из-за опасения, что конфиденциальность граждан будет просочиться, а действующее законодательство США в этом отношении не очень совершенно.

Поэтому эти компании с технологиями решили начать с сдерживания себя, чтобы технологиями не злоупотребляли, а конфиденциальность и права граждан были более защищены. Когда использование технологии не ограничено идеальными спецификациями, может быть лучшим выбором ограничить развитие самой технологии.

#Добро пожаловать на официальный аккаунт Айфанер в WeChat: Айфанер (WeChat: ifanr), в ближайшее время вам будет представлен более интересный контент.

Love Faner | Исходная ссылка · Просмотреть комментарии · Sina Weibo