Диалог с Цзян Дасинем, основателем Step Star: Мультимодальные модели еще не достигли момента GPT-4, и мы настаиваем на достижении «верхнего предела интеллекта»

Вопрос о том, дойдет ли ИИ до второй половины, может быть спорным, но можно с уверенностью сказать, что крупные модели выйдут в плей-офф.

После появления DeepSeek R1 тенденция усилилась. Только в этом году OpenAI, Anthropic, Google, Meta и Grok выпустили как минимум 8 новых моделей. Некоторые из отечественных «тигров» ИИ также начали отказываться от предварительной подготовки и отложили идеализм ИИ.

Среди них Step Star — особая компания. До конца прошлого года новостей о финансировании было мало, но он стал «королем объемов» в мультимодальных моделях. За 2 года своего существования она выпустила 22 базовые модели собственной разработки, став самым сдержанным и загадочным ИИ-единорогом.

Цзян Даксин, основатель и генеральный директор Step Star, ведет себя так же сдержанно, как и компания, и редко появляется в оживленном общественном поле индустрии искусственного интеллекта.

Вчера Цзян Дасинь провел углубленную коммуникационную встречу с APPSO и другими средствами массовой информации. Он поделился с нами своими взглядами на пути AGI, мультимодальные модели и другие технологии, а также планы на будущее Step Star.

Мультимодальные модели еще не появились в GPT-4, преследуя «верхний предел интеллекта».

Нынешней инволюции в области больших моделей ИИ нет конца, и среди ведущих компаний постоянно разыгрываются жестокие драмы «близких релизов».

Однако Цзян Даксин по-прежнему считает, что « погоня за верхним пределом интеллекта по-прежнему находится в центре внимания индустрии искусственного интеллекта на данном этапе». Другими словами, хотя сейчас на рынке представлено множество моделей, и все они кажутся вполне способными, они все еще далеки от того, чтобы быть по-настоящему «умными».

Все спешат выпускать новые модели, и это выглядит живо, но если просто повозиться с текущим уровнем, то это будет просто «инволюция» стояния на месте.

Цзян Дасинь считает, что самое важное сейчас — найти способ повысить «IQ» ИИ, иначе он все равно будет далек от того AGI (искусственного интеллекта), о котором все думают.

После запуска DeepSeek R1 и громкого выхода крупных производителей многие начинающие компании стали отказываться от разработки базовых моделей. Однако Цзян Дасинь сказал в интервью APPSO:

Технологии в отрасли искусственного интеллекта развиваются очень быстро и все еще находятся в очень крутом диапазоне. Мы не хотим отказываться от основного роста или передовой тенденции в этом процессе, поэтому мы по-прежнему будем придерживаться исследований и разработок базовых моделей.

В то же время Цзян Дасинь заявил, что приложения и модели дополняют друг друга. Модель может определять верхний предел приложения, а приложение предоставляет модели конкретные сценарии применения и данные.

Так как же мы можем сделать ИИ умнее? Ключевой путь, предложенный Цзян Дасинем, таков: « Мультимодальность — единственный способ достичь ОИИ».

Многие говорят, что этот год — первый год Агента. Цзян Дасинь считает, что для появления агента необходимы два необходимых условия: одно — мультимодальная способность, а другое — способность думать медленно .

Мультимодальность, если говорить прямо, означает, что ИИ может не только понимать текст, но и видеть картинки, слушать звуки и понимать видео.

Если задуматься, людям нужны только глаза, уши, рот и нос, чтобы полностью понять мир. ИИ тоже должен быть таким, став «универсалом», способным слушать, видеть и говорить.

Step Star можно назвать «королем объемов» мультимодальных моделей. Практически каждый месяц выпускает базовую большую модель, включая 16 мультимодальных моделей. Он охватывает понимание и создание изображений, видео, речи и музыки. По словам Цзян Дасиня, он придерживается «естественной мультимодальной концепции».

Однако Цзян Дасинь также весьма честен. Он откровенно заявил, что « момента GPT-4 в сфере мультимодальных моделей пока не наступило».

Хотя мультимодальность сейчас очень популярна, и все ее продвигают, в области текста еще не было такого эталонного продукта, как GPT-4. Когда он выйдет, он скажет «Вау» и заставит всех подумать: «Вот оно». Есть еще много твердых костей, над которыми нужно работать технически.

Модернизированная ИИ трилогия о боях с монстрами

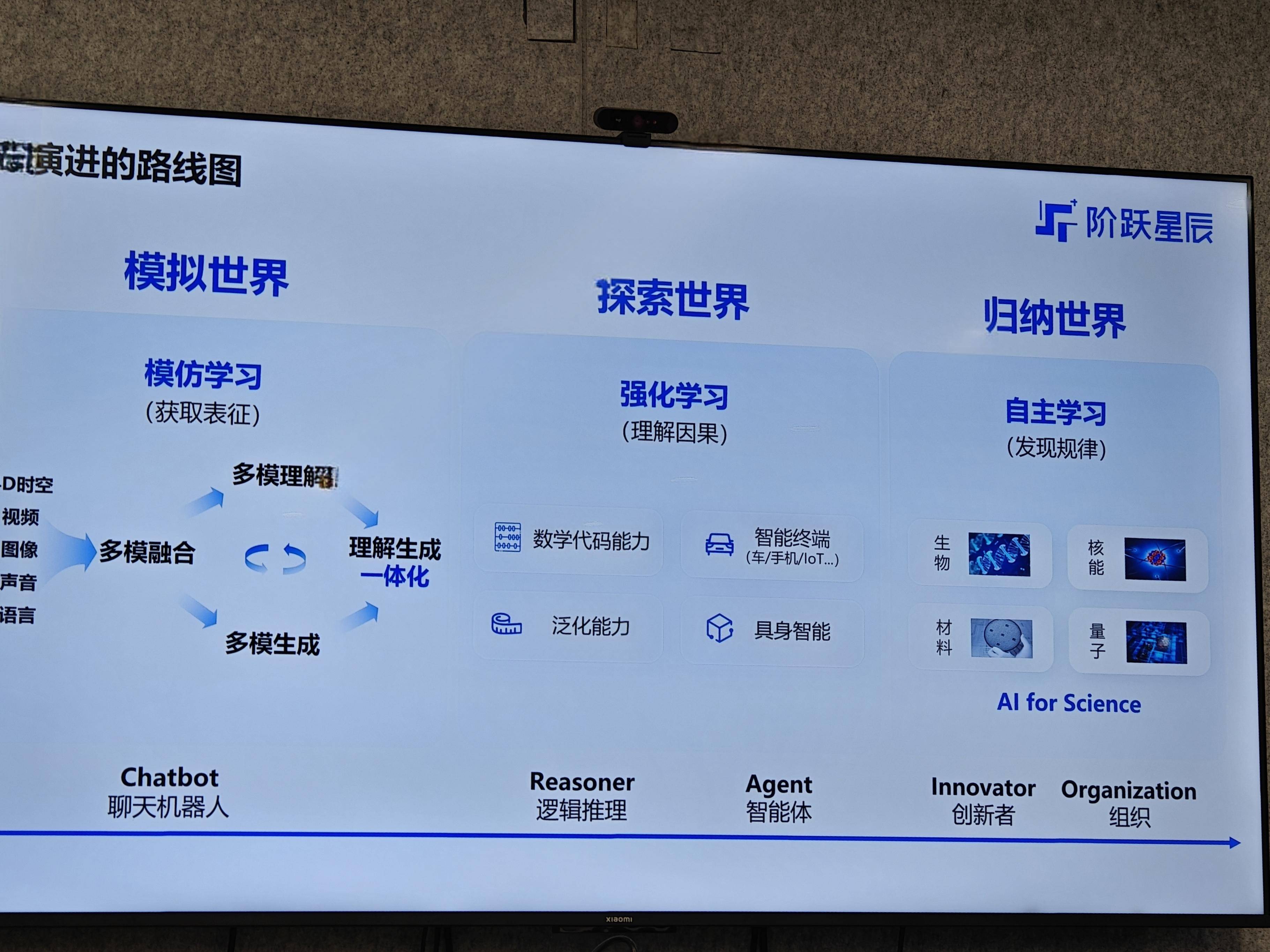

Что касается того, как модель шаг за шагом приближается к верхнему пределу интеллекта, Цзян Дасинь нарисовал четкую дорожную карту эволюции «трилогии». Можно также сказать, что это направление эволюции AGI, понятное Step Star.

Имитируемый мир (этап обучения имитации) : ИИ на этом этапе подобен ребенку, который только что научился говорить. Скормите ему большой объем данных, и он научится. Основная задача — «предсказать следующий токен» (предсказать следующее слово) или «предсказать следующий кадр» (предсказать следующий кадр). Цель состоит в том, чтобы позволить ИИ сначала узнать, как выглядит мир и какие характеристики имеют различные вещи.

Исследование мира (этап обучения с подкреплением) . Просто уметь подражать недостаточно, необходимо также развивать способность решать сложные проблемы. Например, решение задачи математической олимпиады или написание сложного фрагмента кода требует «медленного мышления». В настоящее время необходимо обучение с подкреплением, чтобы ИИ мог научиться решать проблему шаг за шагом путем непрерывных проб и ошибок.

Индуктивный мир (этап машинного автономного обучения) : это высшее состояние. ИИ может не только решать известные проблемы, но и самостоятельно открывать новые законы и создавать инновации, о которых человек и не догадывался. Например, в сфере научных исследований мы помогаем ученым открывать новые материалы, новые лекарства и так далее.

Эти три этапа совпадают с основными концепциями пяти уровней AGI, предложенными OpenAI. Текущее развитие всей индустрии искусственного интеллекта в основном происходит по этому сценарию.

Почему «понимание интеграции поколений» так важно?

Что касается мультимодальности, особенно изображений и видео, Цзян Дасинь много раз подчеркивал на коммуникационной встрече одно слово: интеграция понимания и порождения.

Понимание генеративной интеграции является ключевым вопросом в области компьютерного зрения и имеет решающее значение для реализации AGI.

Грубо говоря, это означает, что модель может не только понять, что означает изображение или видео, но и на основе этого понимания создавать новые и актуальные изображения и видео. В настоящее время зачастую это «используйте модель А, чтобы видеть картинки, и используйте модель Б, чтобы рисовать картинки», что похоже на два отдела, которые не могут сотрудничать.

Он привел пример, например, как учитель пишет на доске. Теперь Сора может подражать письменным движениям учителя, но то, о чем думает учитель и что он собирается писать дальше, зависит от «понимания». Если понимание и генерация — это две системы, то модели будет сложно по-настоящему «понять» вас, а сгенерированные данные также могут оказаться нерелевантными.

Языковые модели вроде ChatGPT хорошо справились с этой задачей, но в визуальном поле данные слишком сложны, поэтому этот вопрос еще не решен до конца. Step Star продолжает инвестировать в это и хочет преодолеть это техническое препятствие.

В конечном итоге для воплощения ценности необходимо применять мощные возможности модели. Step Star придерживается стратегии «супермодель и суперприложение с полным приводом».

На уровне приложений Step Star считает «интеллектуальный терминальный агент» своим ключевым направлением развития. Цзян Даксин считает, что интеллектуальные терминалы, будь то мобильные телефоны в наших карманах, автомобили, которыми мы ездим ежедневно, или роботы, которые могут стать популярными в будущем, — это не просто холодное оборудование, но также «расширение пользовательского восприятия и опыта».

Это означает, что если ИИ удастся глубоко интегрировать с этими терминалами, он сможет лучше «понимать потребности пользователей и контекст задач».

Например, флагманская модель Find X8 Ultra от OPPO официально представила свою первую функцию «флэш-памяти одним щелчком мыши». ИИ может разумно идентифицировать контент на экране телефона, генерировать сводки для пользователей и классифицировать фрагментированную информацию по различным коллекциям памяти.

За этим на самом деле стоит мультимодальная модель Step Star, которая может понимать контент, отображаемый на экране, будь то изображения или текст, и пользователи могут задавать вопросы по этому поводу. ИИ может не только отвечать, но и выполнять обработку изображений и даже помогать пользователям выполнять некоторые операции в приложении, например переход непосредственно на страницу бронирования авиабилетов и заполнение информации.

Этот вид сотрудничества более глубоко интегрирует возможности крупных моделей и систем и встраивает их в наиболее частые сценарии использования мобильных телефонов пользователями. Ценность выбора мобильных телефонов в качестве отправной точки заключается в естественных свойствах мультимодального взаимодействия мобильных телефонов и огромной базе пользователей, которая обеспечивает богатые реальные данные и мгновенную обратную связь для итерации модели.

В целом идея Step Star довольно ясна: технически нацельтесь на AGI и сосредоточьтесь на таких сложных проблемах, как мультимодальность и интеграция понимания и генерации. Что касается применения, нам необходимо определить точку прорыва в интеллектуальных терминалах и работать с производителями оборудования, чтобы полностью понять сценарий.

Идти по этой дороге непросто, но Цзян Дасинь и его команда кажутся весьма решительными. В конце концов, чтобы использовать ИИ для решения реальных проблем, вы должны сначала получить признание пользователей на рынке, прежде чем у вас появится возможность изучить потолок ИИ. Посмотрим, что нового сможет придумать мультимодальный король Step Stars.

# Добро пожаловать на официальную общедоступную учетную запись WeChat Айфанера: Aifaner (идентификатор WeChat: ifanr). Более интересный контент будет предоставлен вам как можно скорее.

Ай Фанер | Исходная ссылка · Посмотреть комментарии · Sina Weibo